8. Transactions

Một số tác giả cho rằng two-phase commit (cam kết hai giai đoạn) tổng quát quá tốn kém để hỗ trợ, vì những vấn đề về hiệu năng hoặc tính khả dụng mà nó mang lại. Chúng tôi cho rằng tốt hơn là để các lập trình viên ứng dụng tự xử lý các vấn đề hiệu năng do sử dụng quá nhiều transaction khi xuất hiện điểm nghẽn, thay vì luôn phải lập trình vòng quanh sự thiếu vắng của transaction.

James Corbett et al., Spanner: Google’s Globally-Distributed Database (2012)

Trong thực tế khắc nghiệt của các hệ thống dữ liệu, nhiều điều có thể xảy ra sai:

- Phần mềm hoặc phần cứng cơ sở dữ liệu có thể gặp sự cố bất cứ lúc nào (kể cả giữa chừng một thao tác ghi).

- Ứng dụng có thể bị treo bất cứ lúc nào (kể cả giữa chừng một chuỗi thao tác).

- Gián đoạn mạng có thể đột ngột ngắt kết nối ứng dụng khỏi cơ sở dữ liệu, hoặc ngắt kết nối giữa các node cơ sở dữ liệu với nhau.

- Nhiều client có thể ghi vào cơ sở dữ liệu cùng lúc, ghi đè lên thay đổi của nhau.

- Một client có thể đọc dữ liệu không hợp lệ vì dữ liệu đó mới chỉ được cập nhật một phần.

- Race condition (điều kiện tranh chấp) giữa các client có thể gây ra những lỗi bất ngờ.

Để đảm bảo độ tin cậy, một hệ thống phải xử lý được các lỗi này và đảm bảo chúng không gây ra sự cố nghiêm trọng cho toàn bộ hệ thống. Tuy nhiên, việc triển khai cơ chế chịu lỗi là rất nhiều công sức. Cần phải suy nghĩ cẩn thận về tất cả những gì có thể xảy ra sai, và kiểm thử nhiều để đảm bảo giải pháp thực sự hoạt động.

Hàng thập kỷ qua, transaction (giao dịch) là cơ chế được ưu tiên để đơn giản hóa những vấn đề này. Transaction là cách để một ứng dụng nhóm nhiều thao tác đọc và ghi lại thành một đơn vị logic. Về mặt khái niệm, tất cả các thao tác đọc và ghi trong một transaction được thực thi như một thao tác duy nhất: hoặc toàn bộ transaction thành công (commit, cam kết) hoặc thất bại (abort, hủy bỏ, hay rollback, khôi phục). Nếu thất bại, ứng dụng có thể thử lại một cách an toàn. Với transaction, việc xử lý lỗi trở nên đơn giản hơn nhiều cho ứng dụng, vì nó không cần lo lắng về lỗi từng phần, tức là trường hợp một số thao tác thành công và một số thất bại (vì bất kỳ lý do gì).

Nếu bạn đã làm việc với transaction nhiều năm, chúng có vẻ hiển nhiên, nhưng chúng ta không nên coi chúng là điều đương nhiên. Transaction không phải là quy luật tự nhiên; chúng được tạo ra với một mục đích cụ thể, đó là đơn giản hóa mô hình lập trình cho các ứng dụng truy cập cơ sở dữ liệu. Bằng cách sử dụng transaction, ứng dụng có thể bỏ qua một số kịch bản lỗi tiềm ẩn và các vấn đề đồng thời, vì cơ sở dữ liệu tự xử lý thay (chúng ta gọi đây là safety guarantees, đảm bảo an toàn).

Không phải mọi ứng dụng đều cần transaction, và đôi khi có lợi thế khi yếu hóa các đảm bảo của transaction hoặc từ bỏ chúng hoàn toàn (ví dụ, để đạt hiệu năng cao hơn hoặc tính khả dụng cao hơn). Một số tính chất an toàn có thể đạt được mà không cần transaction. Mặt khác, transaction có thể ngăn chặn nhiều rắc rối: ví dụ, nguyên nhân kỹ thuật đằng sau vụ bê bối Post Office Horizon (xem “How Important Is Reliability?”) có lẽ là do thiếu ACID transaction trong hệ thống kế toán cơ bản 1.

Làm thế nào để biết mình có cần transaction không? Để trả lời câu hỏi đó, trước tiên chúng ta cần hiểu chính xác những đảm bảo an toàn mà transaction có thể cung cấp, và những chi phí liên quan đến chúng. Mặc dù transaction trông có vẻ đơn giản ngay từ cái nhìn đầu tiên, thực tế có rất nhiều chi tiết tinh tế nhưng quan trọng.

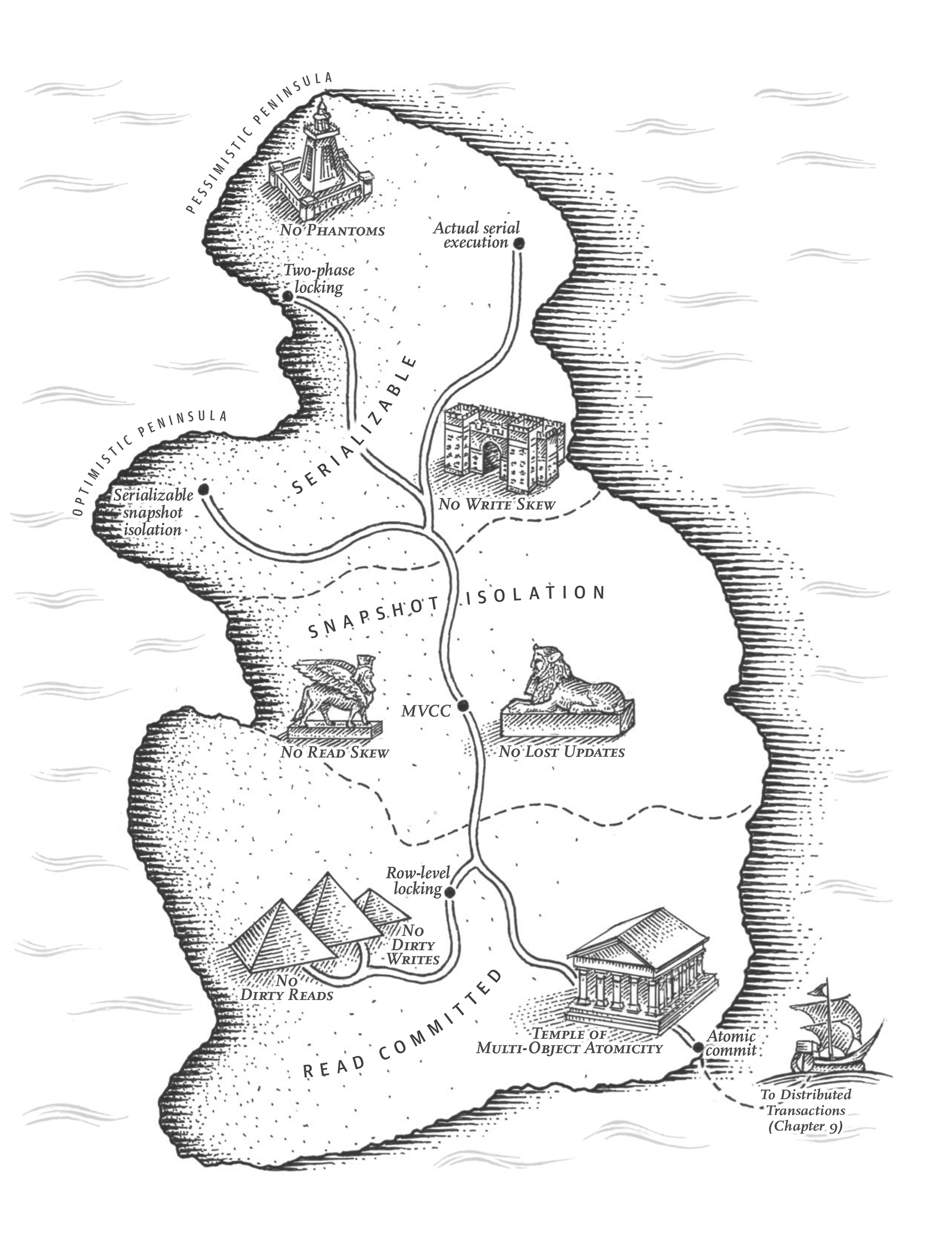

Trong chương này, chúng ta sẽ xem xét nhiều ví dụ về những điều có thể xảy ra sai, và khám phá các thuật toán mà cơ sở dữ liệu sử dụng để bảo vệ khỏi những vấn đề đó. Chúng ta sẽ đi sâu đặc biệt vào lĩnh vực kiểm soát đồng thời (concurrency control), thảo luận về các loại race condition có thể xảy ra và cách cơ sở dữ liệu triển khai các mức độ isolation (cô lập) như read committed, snapshot isolation, và serializability.

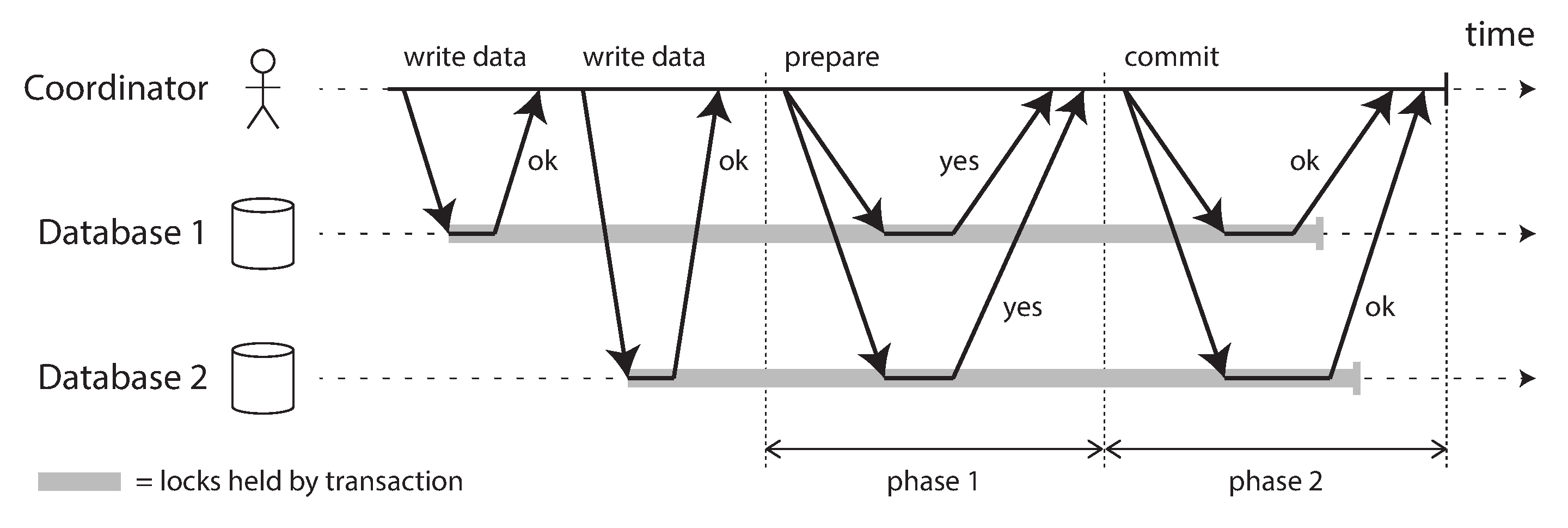

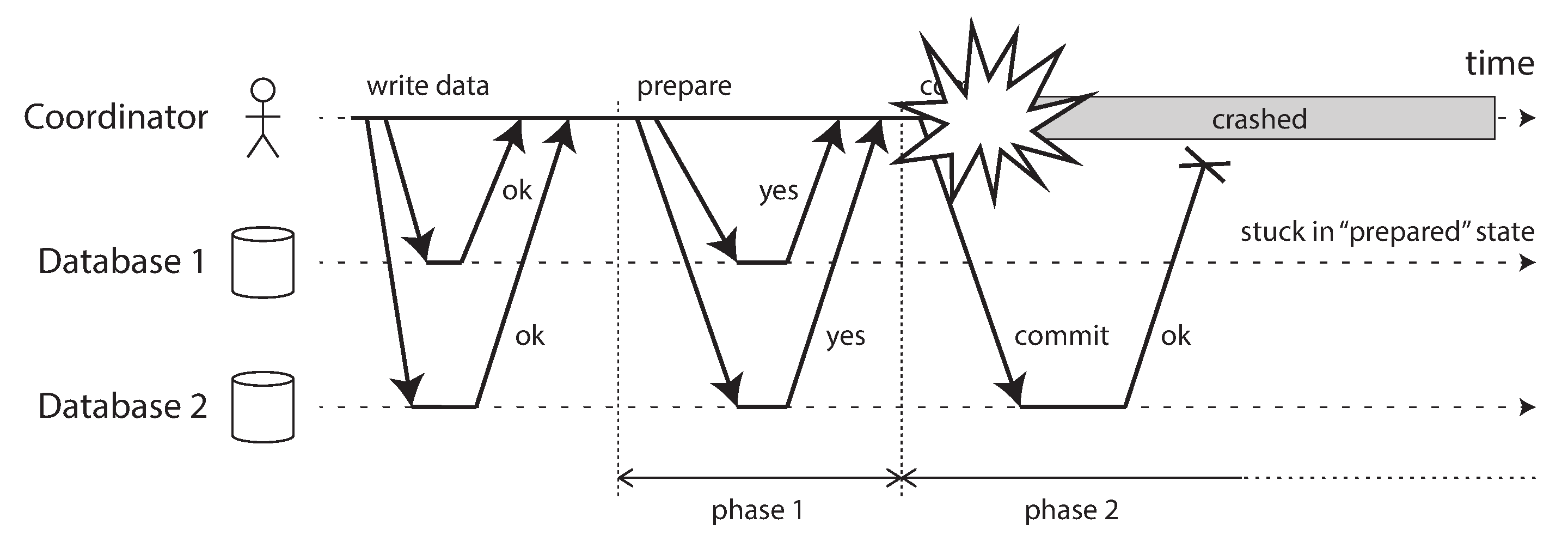

Kiểm soát đồng thời có liên quan đến cả cơ sở dữ liệu đơn node lẫn phân tán. Ở phần sau trong chương này, trong “Distributed Transactions”, chúng ta sẽ xem xét giao thức two-phase commit (cam kết hai giai đoạn) và thách thức của việc đảm bảo tính nguyên tử trong một distributed transaction (giao dịch phân tán).

What Exactly Is a Transaction?

Hầu hết tất cả các cơ sở dữ liệu quan hệ hiện nay, và một số cơ sở dữ liệu phi quan hệ, đều hỗ trợ transaction. Phần lớn trong số chúng tuân theo phong cách được giới thiệu vào năm 1975 bởi IBM System R, cơ sở dữ liệu SQL đầu tiên 2 3 4. Mặc dù một số chi tiết triển khai đã thay đổi, ý tưởng chung hầu như vẫn giữ nguyên trong 50 năm qua: hỗ trợ transaction trong MySQL, PostgreSQL, Oracle, SQL Server, v.v. có sự tương đồng đáng kinh ngạc với System R.

Vào cuối những năm 2000, các cơ sở dữ liệu phi quan hệ (NoSQL) bắt đầu được ưa chuộng. Chúng nhắm đến việc cải thiện hiện trạng của cơ sở dữ liệu quan hệ bằng cách cung cấp nhiều mô hình dữ liệu mới (xem Chương 3), và tích hợp sẵn replication (sao chép) (Chương 6) và sharding (phân mảnh) (Chương 7) theo mặc định. Transaction là nạn nhân chính của phong trào này: nhiều cơ sở dữ liệu thế hệ này đã từ bỏ transaction hoàn toàn, hoặc định nghĩa lại từ này để mô tả một tập đảm bảo yếu hơn nhiều so với trước đây.

Sự cường điệu xung quanh các cơ sở dữ liệu NoSQL phân tán đã dẫn đến niềm tin phổ biến rằng transaction về cơ bản không thể mở rộng được, và bất kỳ hệ thống quy mô lớn nào cũng phải từ bỏ transaction để duy trì hiệu năng tốt và tính khả dụng cao. Gần đây hơn, niềm tin đó đã được chứng minh là sai. Các cơ sở dữ liệu “NewSQL” như CockroachDB 5, TiDB 6, Spanner 7, FoundationDB 8, và Yugabyte đã chứng minh rằng các hệ thống transactional có thể mở rộng quy mô với lượng dữ liệu lớn và thông lượng cao. Các hệ thống này kết hợp sharding với consensus protocol (giao thức đồng thuận) (Chương 10) để cung cấp đảm bảo ACID mạnh ở quy mô lớn.

Tuy nhiên, điều đó không có nghĩa là mọi hệ thống đều phải có transaction: giống như mọi lựa chọn thiết kế kỹ thuật khác, transaction có ưu điểm và hạn chế. Để hiểu những đánh đổi đó, hãy đi sâu vào chi tiết các đảm bảo mà transaction có thể cung cấp, cả trong hoạt động bình thường lẫn trong các hoàn cảnh cực đoan (nhưng thực tế).

The Meaning of ACID

Các đảm bảo an toàn do transaction cung cấp thường được mô tả bằng từ viết tắt nổi tiếng ACID, viết tắt của Atomicity (tính nguyên tử), Consistency (tính nhất quán), Isolation (tính cô lập) và Durability (tính bền vững). Nó được đặt ra vào năm 1983 bởi Theo Härder và Andreas Reuter 9 trong nỗ lực thiết lập thuật ngữ chính xác cho các cơ chế chịu lỗi trong cơ sở dữ liệu.

Tuy nhiên, trong thực tế, triển khai ACID của cơ sở dữ liệu này không bằng triển khai của cơ sở dữ liệu khác. Ví dụ, như chúng ta sẽ thấy, có rất nhiều sự mơ hồ xung quanh ý nghĩa của isolation 10. Ý tưởng tổng quát là đúng, nhưng chi tiết mới là điều quan trọng. Ngày nay, khi một hệ thống tuyên bố “tuân thủ ACID,” không rõ ràng những đảm bảo nào bạn thực sự có thể mong đợi. ACID đáng tiếc đã trở thành một thuật ngữ marketing.

(Các hệ thống không đáp ứng tiêu chí ACID đôi khi được gọi là BASE, viết tắt của Basically Available (cơ bản khả dụng), Soft state (trạng thái mềm) và Eventual consistency (nhất quán sau cùng) 11. Điều này còn mơ hồ hơn cả định nghĩa của ACID. Có vẻ như định nghĩa hợp lý duy nhất của BASE là “không phải ACID,” tức là nó có thể có nghĩa là hầu hết bất cứ điều gì bạn muốn.)

Hãy đi sâu vào các định nghĩa của atomicity, consistency, isolation và durability, vì điều này sẽ giúp chúng ta tinh chỉnh khái niệm về transaction.

Atomicity

Nói chung, atomic (nguyên tử) đề cập đến thứ gì đó không thể chia nhỏ thành các phần nhỏ hơn. Từ này có ý nghĩa tương tự nhưng tinh tế khác nhau trong các lĩnh vực khác nhau của điện toán. Ví dụ, trong lập trình đa luồng, nếu một thread thực thi một thao tác atomic, điều đó có nghĩa là không có cách nào để một thread khác nhìn thấy kết quả chưa hoàn chỉnh của thao tác đó. Hệ thống chỉ có thể ở trạng thái trước thao tác hoặc sau thao tác, không ở giữa chừng.

Ngược lại, trong ngữ cảnh ACID, atomicity không liên quan đến đồng thời. Nó không mô tả điều gì xảy ra nếu nhiều tiến trình cố gắng truy cập cùng một dữ liệu cùng lúc, vì điều đó được bao gồm trong chữ I, cho isolation (xem “Isolation”).

Thay vào đó, ACID atomicity mô tả điều gì xảy ra nếu một client muốn thực hiện nhiều thao tác ghi, nhưng một lỗi xảy ra sau khi một số thao tác ghi đã được xử lý, chẳng hạn như một tiến trình bị crash, một kết nối mạng bị gián đoạn, một đĩa bị đầy, hoặc một ràng buộc toàn vẹn bị vi phạm. Nếu các thao tác ghi được nhóm lại thành một atomic transaction, và transaction không thể hoàn thành (committed, cam kết) do lỗi, thì transaction sẽ bị aborted (hủy bỏ) và cơ sở dữ liệu phải hủy hoặc hoàn tác bất kỳ thao tác ghi nào nó đã thực hiện cho đến nay trong transaction đó.

Nếu không có atomicity, khi xảy ra lỗi giữa chừng khi thực hiện nhiều thay đổi, rất khó để biết thay đổi nào đã có hiệu lực và thay đổi nào chưa. Ứng dụng có thể thử lại, nhưng điều đó có nguy cơ thực hiện cùng một thay đổi hai lần, dẫn đến dữ liệu trùng lặp hoặc sai. Atomicity đơn giản hóa vấn đề này: nếu một transaction bị abort, ứng dụng có thể chắc chắn rằng nó không thay đổi gì cả, vì vậy có thể thử lại một cách an toàn.

Khả năng abort một transaction khi có lỗi và hủy bỏ tất cả các thao tác ghi từ transaction đó là đặc điểm xác định của ACID atomicity. Có lẽ abortability (khả năng hủy bỏ) sẽ là thuật ngữ tốt hơn so với atomicity, nhưng chúng ta sẽ tiếp tục dùng atomicity vì đó là từ thông dụng.

Consistency

Từ consistency (nhất quán) bị dùng quá nhiều nghĩa:

- Trong Chương 6 chúng ta đã thảo luận về replica consistency (nhất quán bản sao) và vấn đề eventual consistency (nhất quán sau cùng) xuất hiện trong các hệ thống replicated bất đồng bộ (xem “Problems with Replication Lag”).

- Một consistent snapshot (ảnh chụp nhất quán) của cơ sở dữ liệu, ví dụ để sao lưu, là một ảnh chụp của toàn bộ cơ sở dữ liệu như nó tồn tại tại một thời điểm. Chính xác hơn, nó nhất quán với quan hệ happens-before (xem “The “happens-before” relation and concurrency”): tức là, nếu ảnh chụp chứa một giá trị được ghi tại một thời điểm cụ thể, thì nó cũng phản ánh tất cả các thao tác ghi xảy ra trước giá trị đó.

- Consistent hashing (băm nhất quán) là cách tiếp cận sharding mà một số hệ thống sử dụng để tái cân bằng (xem “Consistent hashing”).

- Trong định lý CAP (xem Chương 10), từ consistency được dùng để có nghĩa là linearizability (xem “Linearizability”).

- Trong ngữ cảnh ACID, consistency đề cập đến khái niệm dành riêng cho ứng dụng về cơ sở dữ liệu đang ở “trạng thái tốt.”

Thật không may khi cùng một từ được dùng với ít nhất năm nghĩa khác nhau.

Ý tưởng của ACID consistency là bạn có những phát biểu nhất định về dữ liệu của mình (invariants, bất biến) phải luôn đúng, ví dụ, trong một hệ thống kế toán, các khoản ghi có và ghi nợ trên tất cả các tài khoản phải luôn cân bằng. Nếu một transaction bắt đầu với một cơ sở dữ liệu hợp lệ theo các bất biến này, và bất kỳ thao tác ghi nào trong transaction đều bảo toàn tính hợp lệ đó, thì bạn có thể chắc chắn rằng các bất biến luôn được thỏa mãn. (Một bất biến có thể bị vi phạm tạm thời trong quá trình thực thi transaction, nhưng phải được thỏa mãn lại khi transaction commit.)

Nếu bạn muốn cơ sở dữ liệu thực thi các bất biến của mình, bạn cần khai báo chúng là constraints (ràng buộc) như một phần của schema. Ví dụ, foreign key constraint (ràng buộc khóa ngoại), uniqueness constraint (ràng buộc duy nhất), hoặc check constraint (ràng buộc kiểm tra, hạn chế các giá trị có thể xuất hiện trong một hàng riêng lẻ) thường được sử dụng để mô hình hóa các loại bất biến cụ thể. Các yêu cầu nhất quán phức tạp hơn đôi khi có thể được mô hình hóa bằng trigger hoặc materialized view 12.

Tuy nhiên, các bất biến phức tạp có thể khó hoặc không thể mô hình hóa bằng các ràng buộc mà cơ sở dữ liệu thường cung cấp. Trong trường hợp đó, trách nhiệm của ứng dụng là định nghĩa các transaction của mình đúng cách để chúng bảo toàn nhất quán. Nếu bạn ghi dữ liệu xấu vi phạm các bất biến của mình, nhưng bạn chưa khai báo các bất biến đó, cơ sở dữ liệu không thể ngăn bạn. Do đó, chữ C trong ACID thường phụ thuộc vào cách ứng dụng sử dụng cơ sở dữ liệu, và nó không phải là thuộc tính của cơ sở dữ liệu đơn thuần.

Isolation

Hầu hết các cơ sở dữ liệu được truy cập bởi nhiều client cùng một lúc. Điều đó không phải là vấn đề nếu chúng đọc và ghi các phần khác nhau của cơ sở dữ liệu, nhưng nếu chúng truy cập cùng các bản ghi cơ sở dữ liệu, bạn có thể gặp phải vấn đề đồng thời (race condition).

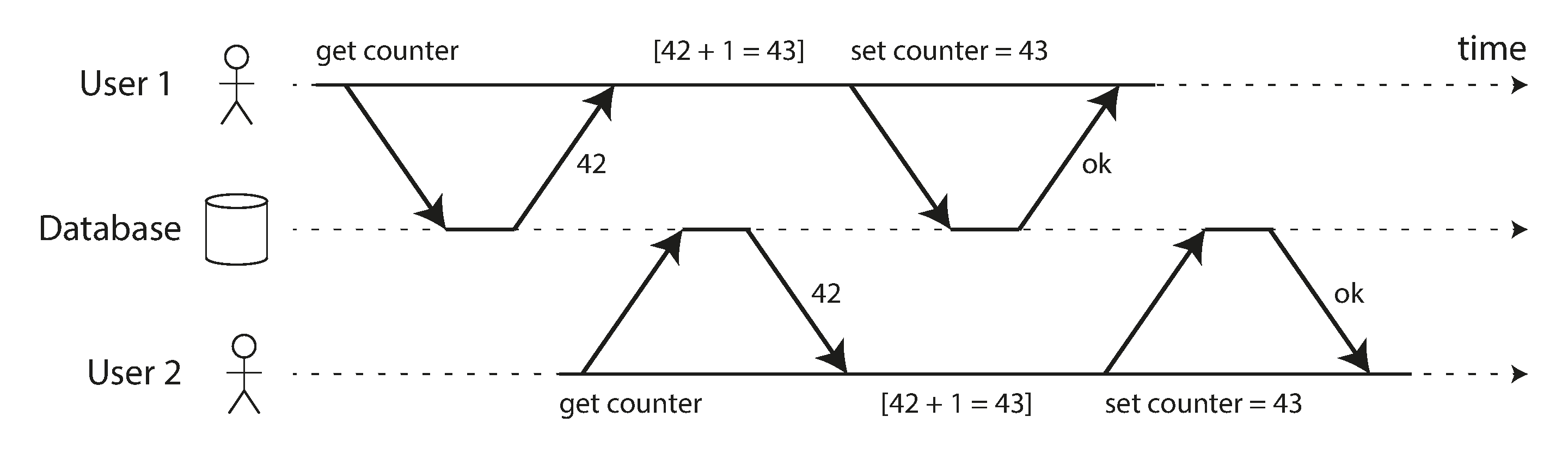

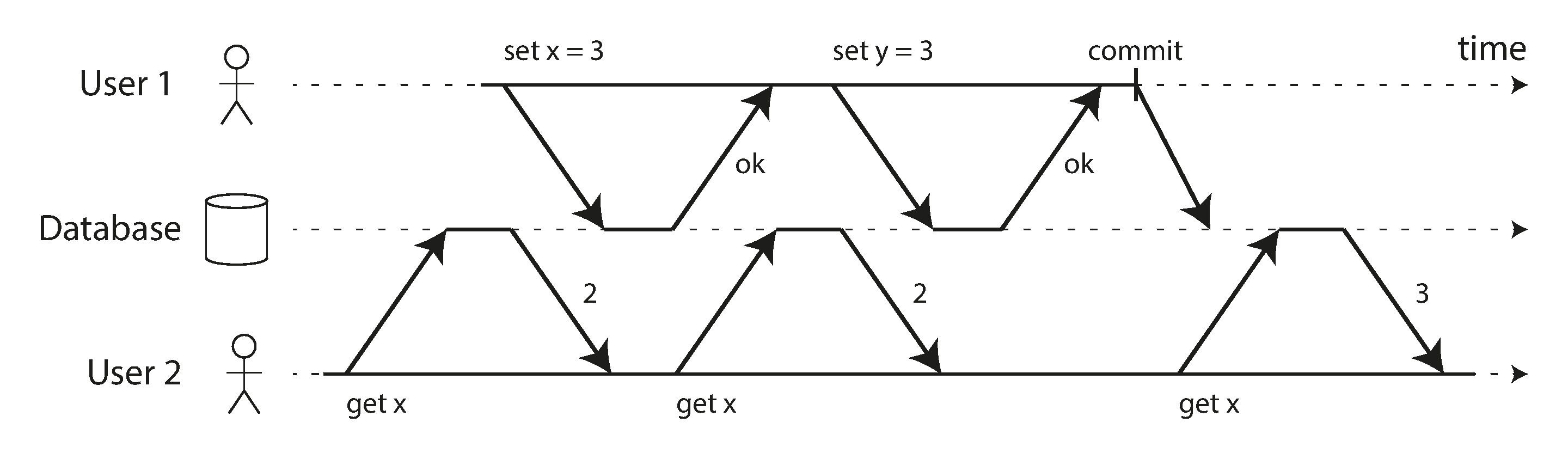

Hình 8-1 là một ví dụ đơn giản về loại vấn đề này. Giả sử bạn có hai client đồng thời tăng một bộ đếm được lưu trữ trong cơ sở dữ liệu. Mỗi client cần đọc giá trị hiện tại, cộng thêm 1, và ghi giá trị mới trở lại (giả sử không có thao tác increment tích hợp trong cơ sở dữ liệu). Trong Hình 8-1 bộ đếm lẽ ra phải tăng từ 42 lên 44, vì hai thao tác increment đã xảy ra, nhưng thực tế chỉ tăng lên 43 do race condition.

Isolation (cô lập) theo nghĩa ACID có nghĩa là các transaction thực thi đồng thời được cô lập với nhau: chúng không thể giẫm lên chân nhau. Các sách giáo khoa cơ sở dữ liệu cổ điển hình thức hóa isolation là serializability (khả năng tuần tự hóa), có nghĩa là mỗi transaction có thể giả vờ rằng nó là transaction duy nhất đang chạy trên toàn bộ cơ sở dữ liệu. Cơ sở dữ liệu đảm bảo rằng khi các transaction đã commit, kết quả giống như thể chúng đã chạy serially (tuần tự, lần lượt từng cái), mặc dù trên thực tế chúng có thể đã chạy đồng thời 13.

Tuy nhiên, serializability có chi phí hiệu năng. Trong thực tế, nhiều cơ sở dữ liệu sử dụng các dạng isolation yếu hơn serializability: tức là, chúng cho phép các transaction đồng thời can thiệp vào nhau theo những cách hạn chế. Một số cơ sở dữ liệu phổ biến, chẳng hạn như Oracle, thậm chí không triển khai nó (Oracle có mức isolation được gọi là “serializable,” nhưng thực tế nó triển khai snapshot isolation, một đảm bảo yếu hơn serializability 10 14). Điều này có nghĩa là một số loại race condition vẫn có thể xảy ra. Chúng ta sẽ khám phá snapshot isolation và các dạng isolation khác trong “Weak Isolation Levels”.

Durability

Mục đích của một hệ thống cơ sở dữ liệu là cung cấp nơi lưu trữ dữ liệu an toàn mà không lo mất mát. Durability (bền vững) là cam kết rằng một khi transaction đã commit thành công, bất kỳ dữ liệu nào nó đã ghi sẽ không bị mất, kể cả khi có lỗi phần cứng hoặc cơ sở dữ liệu bị crash.

Trong cơ sở dữ liệu đơn node, durability thường có nghĩa là dữ liệu đã được ghi vào bộ nhớ không bay hơi (nonvolatile storage) như ổ cứng hoặc SSD. Các thao tác ghi file thông thường thường được đệm trong bộ nhớ trước khi được gửi lên đĩa sau đó, nghĩa là chúng sẽ bị mất nếu có mất điện đột ngột; do đó nhiều cơ sở dữ liệu sử dụng lệnh gọi hệ thống fsync() để đảm bảo dữ liệu thực sự đã được ghi vào đĩa. Cơ sở dữ liệu thường cũng có write-ahead log hoặc tương tự (xem “Making B-trees reliable”), cho phép chúng phục hồi trong trường hợp crash xảy ra giữa chừng một thao tác ghi.

Trong cơ sở dữ liệu replicated, durability có thể có nghĩa là dữ liệu đã được sao chép thành công đến một số node nhất định. Để cung cấp đảm bảo durability, cơ sở dữ liệu phải đợi cho đến khi các thao tác ghi hoặc sao chép này hoàn thành trước khi báo cáo một transaction đã commit thành công. Tuy nhiên, như đã thảo luận trong “Reliability and Fault Tolerance”, durability hoàn hảo không tồn tại: nếu tất cả ổ cứng và tất cả các bản sao lưu của bạn bị phá hủy cùng một lúc, rõ ràng cơ sở dữ liệu không thể làm gì để cứu bạn.

REPLICATION AND DURABILITY

Trong lịch sử, durability có nghĩa là ghi vào băng lưu trữ. Sau đó nó được hiểu là ghi vào đĩa hoặc SSD. Gần đây hơn, nó được điều chỉnh để có nghĩa là replication. Triển khai nào tốt hơn?

Sự thật là, không có gì hoàn hảo:

- Nếu bạn ghi vào đĩa và máy bị hỏng, mặc dù dữ liệu không bị mất, nó không thể truy cập cho đến khi bạn sửa máy hoặc chuyển đĩa sang máy khác. Các hệ thống replicated có thể duy trì tính khả dụng.

- Một correlated fault (lỗi tương quan), ví dụ mất điện hoặc một bug làm crash mọi node trên một đầu vào cụ thể, có thể làm tắt tất cả các replica cùng lúc (xem “Reliability and Fault Tolerance”), mất bất kỳ dữ liệu nào chỉ có trong bộ nhớ. Do đó, ghi vào đĩa vẫn có liên quan đối với các cơ sở dữ liệu replicated.

- Trong một hệ thống replicated bất đồng bộ, các thao tác ghi gần đây có thể bị mất khi leader (nút chính) không khả dụng (xem “Handling Node Outages”).

- Khi điện bị cắt đột ngột, SSD đặc biệt đã được chứng minh là đôi khi vi phạm các đảm bảo mà chúng được cho là cung cấp: ngay cả

fsynccũng không được đảm bảo hoạt động đúng 15. Firmware ổ đĩa có thể có lỗi, giống như bất kỳ phần mềm nào khác 16 17, ví dụ gây ra ổ đĩa bị lỗi chính xác sau 32.768 giờ hoạt động 18. Vàfsynckhó sử dụng đúng cách; ngay cả PostgreSQL cũng sử dụng nó không đúng trong hơn 20 năm 19 20 21. - Các tương tác tinh tế giữa storage engine (bộ máy lưu trữ) và triển khai filesystem có thể dẫn đến các lỗi khó theo dõi, và có thể gây ra các file trên đĩa bị hỏng sau khi crash 22 23. Lỗi filesystem trên một replica đôi khi có thể lan sang các replica khác 24.

- Dữ liệu trên đĩa có thể dần bị hỏng mà không bị phát hiện 25. Nếu dữ liệu đã bị hỏng một thời gian, các replica và các bản sao lưu gần đây cũng có thể bị hỏng. Trong trường hợp này, bạn sẽ cần cố gắng khôi phục dữ liệu từ một bản sao lưu lịch sử.

- Một nghiên cứu về SSD cho thấy giữa 30% và 80% ổ đĩa phát triển ít nhất một bad block trong bốn năm đầu hoạt động, và chỉ một số trong số đó có thể được sửa chữa bởi firmware 26. Ổ cứng từ tính có tỷ lệ bad sector thấp hơn, nhưng tỷ lệ hỏng hoàn toàn cao hơn so với SSD.

- Khi một SSD đã qua sử dụng nhiều (đã trải qua nhiều chu kỳ ghi/xóa) bị ngắt điện, nó có thể bắt đầu mất dữ liệu trong khoảng thời gian từ vài tuần đến vài tháng, tùy thuộc vào nhiệt độ 27. Điều này ít là vấn đề hơn đối với các ổ đĩa có mức mòn thấp hơn 28.

Trong thực tế, không có một kỹ thuật nào có thể cung cấp đảm bảo tuyệt đối. Chỉ có các kỹ thuật giảm thiểu rủi ro khác nhau, bao gồm ghi vào đĩa, sao chép đến các máy từ xa, và sao lưu, và chúng có thể và nên được sử dụng kết hợp với nhau. Như thường lệ, sáng suốt là đón nhận bất kỳ “đảm bảo” lý thuyết nào với một chút hoài nghi.

Single-Object and Multi-Object Operations

Tóm lại, trong ACID, atomicity và isolation mô tả những gì cơ sở dữ liệu nên làm nếu một client thực hiện nhiều thao tác ghi trong cùng một transaction:

- Atomicity

- Nếu xảy ra lỗi giữa chừng một chuỗi thao tác ghi, transaction phải bị abort, và các thao tác ghi đã thực hiện cho đến thời điểm đó phải bị hủy bỏ. Nói cách khác, cơ sở dữ liệu giải phóng bạn khỏi việc lo lắng về lỗi từng phần, bằng cách đưa ra đảm bảo tất cả hoặc không gì cả (all-or-nothing).

- Isolation

- Các transaction chạy đồng thời không nên can thiệp vào nhau. Ví dụ, nếu một transaction thực hiện nhiều thao tác ghi, thì một transaction khác sẽ thấy hoặc tất cả hoặc không có thao tác ghi nào, nhưng không phải một tập con.

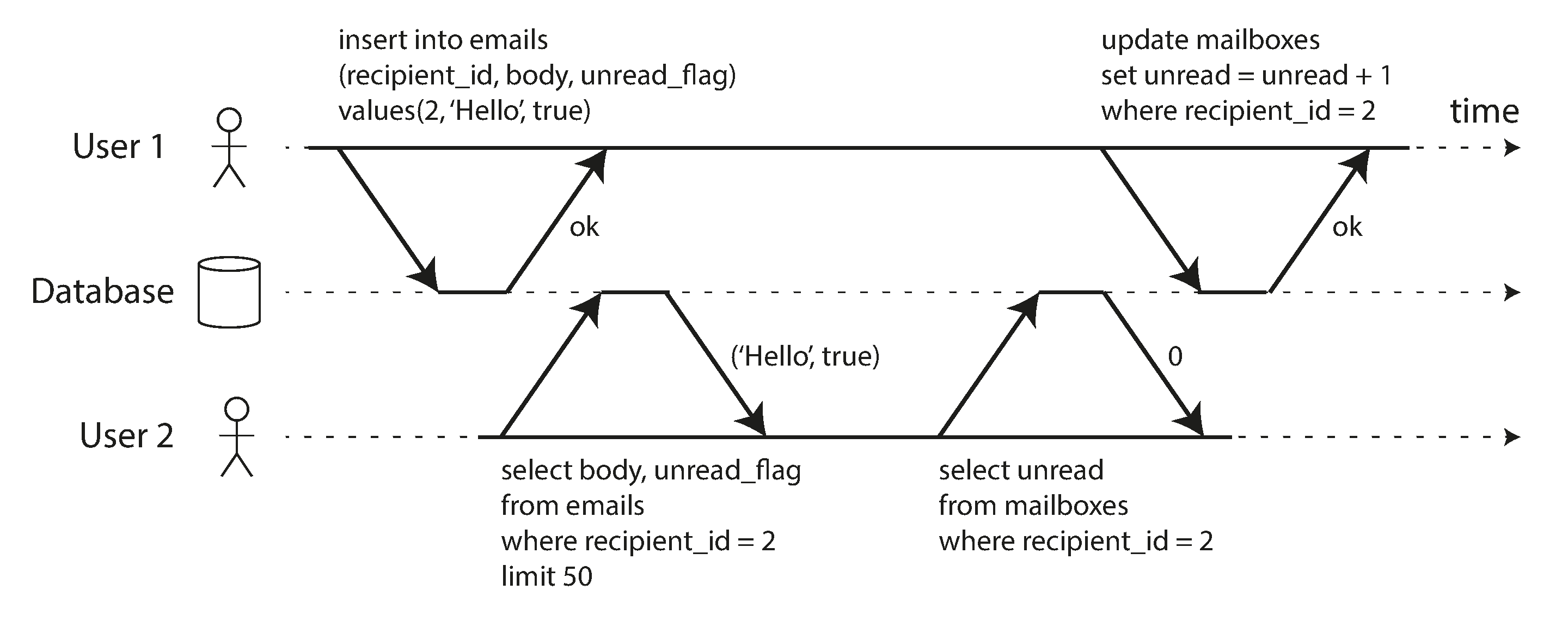

Những định nghĩa này giả định rằng bạn muốn sửa đổi nhiều đối tượng (hàng, tài liệu, bản ghi) cùng một lúc. Các multi-object transaction (giao dịch đa đối tượng) như vậy thường cần thiết nếu nhiều phần dữ liệu cần được giữ đồng bộ. Hình 8-2 cho thấy một ví dụ từ ứng dụng email. Để hiển thị số lượng tin nhắn chưa đọc cho một người dùng, bạn có thể truy vấn như sau:

SELECT COUNT(*) FROM emails WHERE recipient_id = 2 AND unread_flag = true

Tuy nhiên, bạn có thể thấy truy vấn này quá chậm nếu có nhiều email, và quyết định lưu trữ số lượng tin nhắn chưa đọc trong một trường riêng biệt (một dạng denormalization, được chúng ta thảo luận trong “Normalization, Denormalization, and Joins”). Bây giờ, mỗi khi có tin nhắn mới đến, bạn phải tăng bộ đếm chưa đọc, và mỗi khi một tin nhắn được đánh dấu là đã đọc, bạn cũng phải giảm bộ đếm chưa đọc.

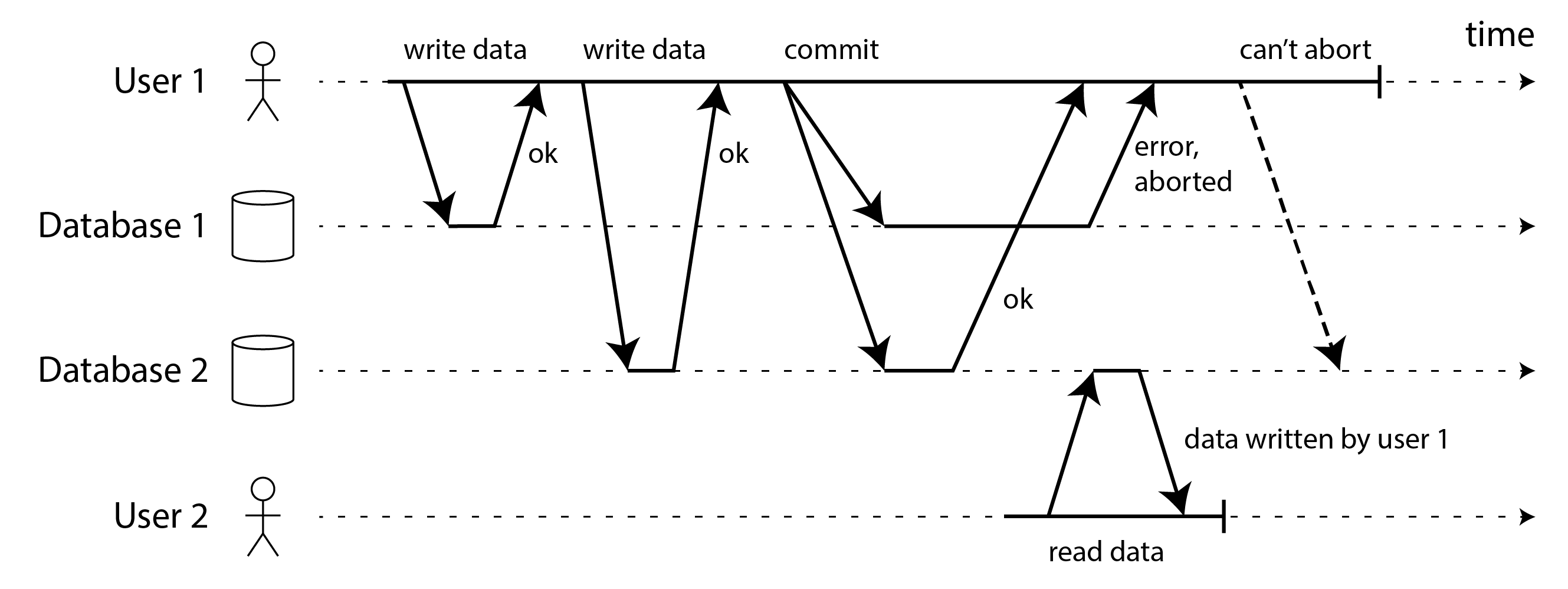

Trong Hình 8-2, người dùng 2 gặp phải bất thường: danh sách hộp thư hiển thị có tin nhắn chưa đọc, nhưng bộ đếm hiển thị không có tin nhắn chưa đọc vì việc tăng bộ đếm chưa xảy ra. (Nếu bộ đếm không chính xác trong ứng dụng email có vẻ quá nhỏ nhặt, hãy nghĩ đến số dư tài khoản khách hàng thay vì bộ đếm chưa đọc, và một giao dịch thanh toán thay vì email.) Isolation sẽ ngăn chặn vấn đề này bằng cách đảm bảo người dùng 2 thấy cả email đã chèn và bộ đếm đã cập nhật, hoặc không thấy gì cả, nhưng không phải một điểm giữa chừng không nhất quán.

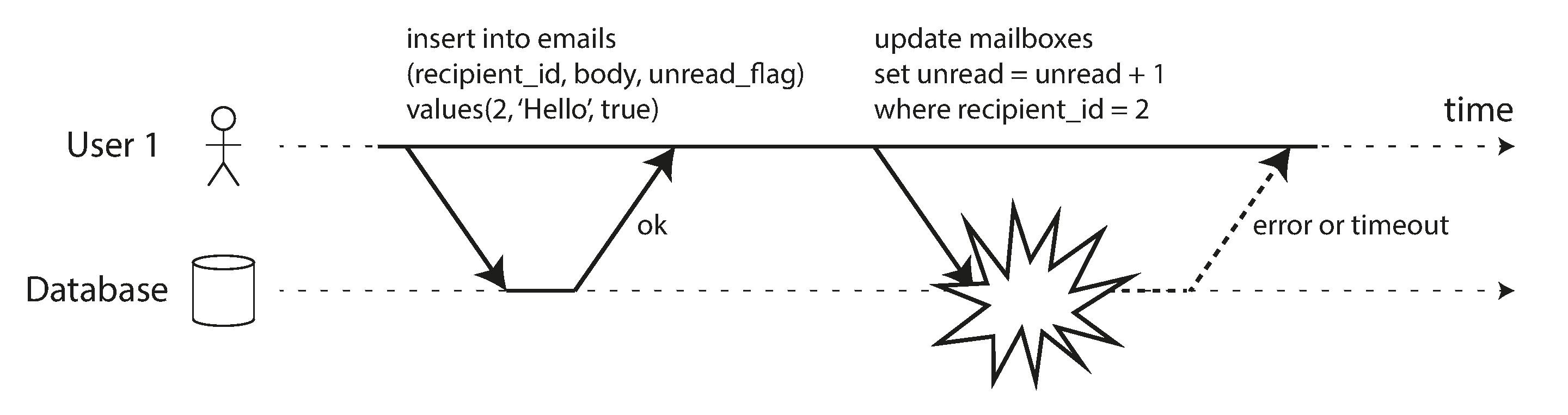

Hình 8-3 minh họa sự cần thiết của atomicity: nếu xảy ra lỗi trong quá trình transaction, nội dung hộp thư và bộ đếm chưa đọc có thể không đồng bộ. Trong một atomic transaction, nếu việc cập nhật bộ đếm thất bại, transaction bị abort và email đã chèn được rollback.

Multi-object transaction yêu cầu có cách xác định các thao tác đọc và ghi nào thuộc về cùng một transaction. Trong cơ sở dữ liệu quan hệ, điều đó thường được thực hiện dựa trên kết nối TCP của client đến máy chủ cơ sở dữ liệu: trên bất kỳ kết nối cụ thể nào, mọi thứ giữa câu lệnh BEGIN TRANSACTION và COMMIT được coi là thuộc cùng một transaction. Nếu kết nối TCP bị gián đoạn, transaction phải bị abort.

Mặt khác, nhiều cơ sở dữ liệu phi quan hệ không có cách nhóm các thao tác lại với nhau như vậy. Ngay cả khi có API đa đối tượng (ví dụ, một key-value store có thể có thao tác multi-put cập nhật nhiều khóa trong một thao tác), điều đó không nhất thiết có nghĩa là nó có ngữ nghĩa transaction: lệnh có thể thành công với một số khóa và thất bại với các khóa khác, để lại cơ sở dữ liệu ở trạng thái được cập nhật một phần.

Single-object writes

Atomicity và isolation cũng áp dụng khi một đối tượng đơn đang được thay đổi. Ví dụ, hãy tưởng tượng bạn đang ghi một tài liệu JSON 20 KB vào cơ sở dữ liệu:

- Nếu kết nối mạng bị gián đoạn sau khi 10 KB đầu tiên đã được gửi, liệu cơ sở dữ liệu có lưu đoạn 10 KB JSON không thể parse đó không?

- Nếu điện bị cắt trong khi cơ sở dữ liệu đang ghi đè giá trị cũ trên đĩa, bạn có kết thúc với giá trị cũ và mới bị ghép lẫn không?

- Nếu một client khác đọc tài liệu đó trong khi thao tác ghi đang diễn ra, nó có thấy một giá trị được cập nhật một phần không?

Những vấn đề đó sẽ cực kỳ khó hiểu, vì vậy các storage engine gần như phổ biến nhằm cung cấp atomicity và isolation ở cấp độ một đối tượng đơn (như một cặp key-value) trên một node. Atomicity có thể được triển khai bằng cách sử dụng log để khôi phục sau crash (xem “Making B-trees reliable”), và isolation có thể được triển khai bằng cách sử dụng lock trên mỗi đối tượng (chỉ cho phép một thread truy cập một đối tượng tại một thời điểm).

Một số cơ sở dữ liệu cũng cung cấp các thao tác atomic phức tạp hơn, chẳng hạn như thao tác increment, loại bỏ sự cần thiết của chu kỳ read-modify-write như trong Hình 8-1. Cũng phổ biến không kém là thao tác conditional write (ghi có điều kiện), cho phép một thao tác ghi chỉ xảy ra nếu giá trị chưa bị thay đổi đồng thời bởi ai đó khác (xem “Conditional writes (compare-and-set)”), tương tự như thao tác compare-and-set hoặc compare-and-swap (CAS) trong đồng thời bộ nhớ dùng chung.

Note

Nói chính xác, thuật ngữ atomic increment sử dụng từ atomic theo nghĩa của lập trình đa luồng. Trong ngữ cảnh ACID, nó thực ra nên được gọi là isolated hoặc serializable increment, nhưng đó không phải là thuật ngữ thông thường.

Các thao tác single-object này rất hữu ích, vì chúng có thể ngăn chặn lost update (mất cập nhật) khi nhiều client cố gắng ghi vào cùng một đối tượng đồng thời (xem “Preventing Lost Updates”). Tuy nhiên, chúng không phải là transaction theo nghĩa thông thường. Ví dụ, tính năng “lightweight transactions” của Cassandra và ScyllaDB, và chế độ “strong consistency” của Aerospike cung cấp các thao tác đọc linearizable (xem “Linearizability”) và ghi có điều kiện trên một đối tượng đơn, nhưng không có đảm bảo nào trên nhiều đối tượng.

The need for multi-object transactions

Chúng ta có thực sự cần multi-object transaction không? Có thể triển khai bất kỳ ứng dụng nào chỉ với mô hình dữ liệu key-value và các thao tác single-object không?

Có một số trường hợp sử dụng trong đó các thao tác chèn, cập nhật và xóa single-object là đủ. Tuy nhiên, trong nhiều trường hợp khác, các thao tác ghi vào nhiều đối tượng khác nhau cần được phối hợp:

- Trong mô hình dữ liệu quan hệ, một hàng trong một bảng thường có tham chiếu khóa ngoại đến một hàng trong bảng khác. Tương tự, trong mô hình dữ liệu dạng đồ thị, một đỉnh có các cạnh đến các đỉnh khác. Multi-object transaction cho phép bạn đảm bảo rằng các tham chiếu này vẫn hợp lệ: khi chèn nhiều bản ghi tham chiếu đến nhau, các khóa ngoại phải chính xác và cập nhật, nếu không dữ liệu trở nên vô nghĩa.

- Trong mô hình dữ liệu tài liệu, các trường cần được cập nhật cùng nhau thường nằm trong cùng một tài liệu, được coi là một đối tượng đơn, không cần multi-object transaction khi cập nhật một tài liệu đơn. Tuy nhiên, các cơ sở dữ liệu tài liệu thiếu chức năng join cũng khuyến khích denormalization (xem “When to Use Which Model”). Khi thông tin được denormalize cần được cập nhật, như trong ví dụ của Hình 8-2, bạn cần cập nhật nhiều tài liệu cùng một lúc. Transaction rất hữu ích trong tình huống này để ngăn dữ liệu denormalize bị mất đồng bộ. dữ liệu phi chuẩn hóa (denormalized data) khỏi bị mất đồng bộ.

- Trong các cơ sở dữ liệu có secondary index (chỉ mục phụ) (gần như tất cả ngoại trừ các kho lưu trữ key-value thuần túy), các chỉ mục này cũng cần được cập nhật mỗi khi bạn thay đổi một giá trị. Các chỉ mục này là các đối tượng cơ sở dữ liệu khác nhau từ góc độ giao dịch: ví dụ, nếu không có transaction isolation (cách ly giao dịch), một bản ghi có thể xuất hiện trong chỉ mục này nhưng không xuất hiện trong chỉ mục kia, vì việc cập nhật chỉ mục thứ hai chưa xảy ra (xem “Sharding and Secondary Indexes”).

Các ứng dụng như vậy vẫn có thể được triển khai mà không cần giao dịch. Tuy nhiên, việc xử lý lỗi trở nên phức tạp hơn nhiều khi không có atomicity (tính nguyên tử), và thiếu isolation (cách ly) có thể gây ra các vấn đề về đồng thời (concurrency). Chúng ta sẽ thảo luận về những vấn đề đó trong “Weak Isolation Levels”, và khám phá các cách tiếp cận thay thế trong “Derived data versus distributed transactions”.

Xử lý lỗi và hủy bỏ

Một tính năng quan trọng của giao dịch là nó có thể bị hủy bỏ và thử lại một cách an toàn nếu xảy ra lỗi. Các cơ sở dữ liệu ACID được xây dựng dựa trên triết lý này: nếu cơ sở dữ liệu có nguy cơ vi phạm đảm bảo về atomicity, isolation, hoặc durability (tính bền vững), nó sẽ từ bỏ hoàn toàn giao dịch thay vì để nó ở trạng thái hoàn thành một nửa.

Tuy nhiên, không phải tất cả các hệ thống đều tuân theo triết lý đó. Đặc biệt, các kho dữ liệu với leaderless replication (sao chép không có leader) (xem “Leaderless Replication”) hoạt động nhiều hơn theo cơ chế “nỗ lực tối đa” (best effort), có thể được tóm tắt là “cơ sở dữ liệu sẽ làm hết sức có thể, và nếu gặp lỗi, nó sẽ không hoàn tác những gì đã làm”, vì vậy ứng dụng có trách nhiệm khôi phục sau lỗi.

Lỗi chắc chắn sẽ xảy ra, nhưng nhiều nhà phát triển phần mềm thích chỉ nghĩ đến trường hợp thành công (happy path) hơn là những phức tạp trong việc xử lý lỗi. Ví dụ, các framework ORM (object-relational mapping, ánh xạ đối tượng quan hệ) phổ biến như ActiveRecord của Rails và Django không thử lại các giao dịch bị hủy bỏ. Lỗi thường dẫn đến một exception nổi lên theo stack, vì vậy mọi đầu vào của người dùng đều bị loại bỏ và người dùng nhận được thông báo lỗi. Điều này thật đáng tiếc, vì toàn bộ mục đích của việc hủy bỏ là để có thể thử lại một cách an toàn.

Mặc dù việc thử lại một giao dịch bị hủy bỏ là cơ chế xử lý lỗi đơn giản và hiệu quả, nhưng nó không hoàn hảo:

- Nếu giao dịch thực sự thành công, nhưng mạng bị gián đoạn trong khi máy chủ cố gắng xác nhận việc commit thành công với client (và client bị timeout), thì việc thử lại giao dịch sẽ khiến nó được thực hiện hai lần, trừ khi bạn có cơ chế deduplication (loại bỏ trùng lặp) ở tầng ứng dụng.

- Nếu lỗi xảy ra do quá tải hoặc tranh chấp cao giữa các giao dịch đồng thời, việc thử lại giao dịch sẽ làm cho vấn đề tệ hơn, không phải tốt hơn. Để tránh các vòng phản hồi như vậy, bạn có thể giới hạn số lần thử lại, sử dụng exponential backoff (giãn cách mũ), và xử lý các lỗi liên quan đến quá tải khác với các lỗi khác (xem “When an overloaded system won’t recover”).

- Chỉ đáng thử lại sau các lỗi tạm thời (ví dụ do deadlock, vi phạm isolation, gián đoạn mạng tạm thời, và failover); sau một lỗi vĩnh viễn (ví dụ: vi phạm ràng buộc) thì việc thử lại là vô nghĩa.

- Nếu giao dịch cũng có các tác dụng phụ ngoài cơ sở dữ liệu, những tác dụng phụ đó có thể xảy ra ngay cả khi giao dịch bị hủy bỏ. Ví dụ, nếu bạn đang gửi email, bạn không muốn gửi email lại mỗi lần thử lại giao dịch. Nếu bạn muốn đảm bảo rằng một số hệ thống khác nhau cùng commit hoặc cùng hủy bỏ, two-phase commit (cam kết hai giai đoạn) có thể giúp ích (chúng ta sẽ thảo luận về điều này trong “Two-Phase Commit (2PC)”).

- Nếu tiến trình client gặp sự cố trong khi thử lại, mọi dữ liệu mà nó đang cố gắng ghi vào cơ sở dữ liệu đều bị mất.

Các Mức Cách Ly Yếu

Nếu hai giao dịch không truy cập cùng một dữ liệu, hoặc nếu cả hai đều chỉ đọc, chúng có thể được chạy song song một cách an toàn, vì không giao dịch nào phụ thuộc vào giao dịch kia. Các vấn đề đồng thời (race condition) chỉ xuất hiện khi một giao dịch đọc dữ liệu đang được giao dịch khác sửa đổi đồng thời, hoặc khi hai giao dịch cố gắng sửa đổi cùng một dữ liệu.

Lỗi đồng thời rất khó phát hiện bằng kiểm thử, vì những lỗi như vậy chỉ xảy ra khi bạn gặp đúng thời điểm không may mắn. Những vấn đề thời điểm như vậy có thể xảy ra rất hiếm, và thường khó tái hiện. Đồng thời cũng rất khó lý luận, đặc biệt trong một ứng dụng lớn nơi bạn không nhất thiết biết những phần code nào khác đang truy cập cơ sở dữ liệu. Phát triển ứng dụng đã đủ khó nếu bạn chỉ có một người dùng tại một thời điểm; có nhiều người dùng đồng thời làm cho nó khó hơn nhiều, vì bất kỳ dữ liệu nào cũng có thể thay đổi bất ngờ bất kỳ lúc nào.

Vì lý do đó, các cơ sở dữ liệu đã cố gắng che giấu các vấn đề đồng thời khỏi các nhà phát triển ứng dụng bằng cách cung cấp transaction isolation (cách ly giao dịch). Về lý thuyết, isolation sẽ giúp cuộc sống của bạn dễ dàng hơn bằng cách cho phép bạn giả vờ rằng không có đồng thời nào xảy ra: serializable isolation (cách ly tuần tự) có nghĩa là cơ sở dữ liệu đảm bảo rằng các giao dịch có cùng hiệu quả như thể chúng chạy serially (tuần tự, tức là từng giao dịch một, không có đồng thời).

Trong thực tế, isolation không may là không đơn giản như vậy. Serializable isolation có chi phí hiệu năng, và nhiều cơ sở dữ liệu không muốn trả giá đó 10. Do đó, các hệ thống thường sử dụng các mức isolation yếu hơn, bảo vệ chống lại một số vấn đề đồng thời, nhưng không phải tất cả. Những mức isolation đó khó hiểu hơn nhiều và có thể dẫn đến các lỗi tinh vi, nhưng chúng vẫn được sử dụng trong thực tế 29.

Các lỗi đồng thời gây ra bởi transaction isolation yếu không chỉ là vấn đề lý thuyết. Chúng đã gây ra thiệt hại tài chính đáng kể 30 31 32, dẫn đến điều tra bởi các kiểm toán viên tài chính 33, và làm hỏng dữ liệu khách hàng 34. Một bình luận phổ biến về những tiết lộ về các vấn đề như vậy là “Hãy dùng cơ sở dữ liệu ACID nếu bạn xử lý dữ liệu tài chính!”, nhưng điều đó bỏ qua vấn đề cốt lõi. Ngay cả nhiều hệ thống cơ sở dữ liệu quan hệ phổ biến (thường được coi là “ACID”) cũng sử dụng isolation yếu, vì vậy chúng không nhất thiết ngăn được những lỗi này.

Note

Tình cờ là, phần lớn hệ thống ngân hàng dựa vào các tệp văn bản được trao đổi qua FTP an toàn 35. Trong bối cảnh này, có audit trail (vết kiểm toán) và một số biện pháp phòng chống gian lận ở cấp độ con người thực sự quan trọng hơn các thuộc tính ACID.

Những ví dụ đó cũng làm nổi bật một điểm quan trọng: ngay cả khi các vấn đề đồng thời hiếm xảy ra trong hoạt động bình thường, bạn phải xem xét khả năng kẻ tấn công cố tình gửi một lượng lớn các yêu cầu đồng thời đến API của bạn nhằm khai thác các lỗi đồng thời 30. Do đó, để xây dựng các ứng dụng đáng tin cậy và bảo mật, bạn phải đảm bảo rằng các lỗi như vậy được ngăn chặn một cách có hệ thống.

Trong phần này, chúng ta sẽ xem xét một số mức isolation yếu (không tuần tự hóa) được sử dụng trong thực tế, và thảo luận chi tiết về các loại race condition có thể và không thể xảy ra, để bạn có thể quyết định mức nào phù hợp với ứng dụng của mình. Sau khi hoàn thành điều đó, chúng ta sẽ thảo luận chi tiết về serializability (xem “Serializability”). Thảo luận của chúng ta về các mức isolation sẽ không chính thức, sử dụng các ví dụ. Nếu bạn muốn các định nghĩa và phân tích chặt chẽ về các thuộc tính của chúng, bạn có thể tìm thấy trong tài liệu học thuật 36 37 38 39.

Read Committed

Mức cơ bản nhất của transaction isolation là read committed (đọc đã cam kết). Nó đưa ra hai đảm bảo:

- Khi đọc từ cơ sở dữ liệu, bạn chỉ thấy dữ liệu đã được commit (không có dirty reads, đọc bẩn).

- Khi ghi vào cơ sở dữ liệu, bạn chỉ ghi đè dữ liệu đã được commit (không có dirty writes, ghi bẩn).

Một số cơ sở dữ liệu hỗ trợ mức isolation yếu hơn nữa gọi là read uncommitted (đọc chưa cam kết). Nó ngăn dirty writes, nhưng không ngăn dirty reads. Hãy thảo luận chi tiết hơn về hai đảm bảo này.

Không có dirty reads

Hãy tưởng tượng một giao dịch đã ghi một số dữ liệu vào cơ sở dữ liệu, nhưng giao dịch đó chưa commit hoặc hủy bỏ. Liệu giao dịch khác có thể thấy dữ liệu chưa commit đó không? Nếu có, điều đó được gọi là dirty read (đọc bẩn) 3.

Các giao dịch chạy ở mức cách ly read committed phải ngăn dirty reads. Điều này có nghĩa là mọi thao tác ghi của một giao dịch chỉ trở nên hiển thị với các giao dịch khác khi giao dịch đó commit (và sau đó tất cả các thao tác ghi của nó trở nên hiển thị cùng lúc). Điều này được minh họa trong Hình 8-4, nơi người dùng 1 đã đặt x = 3, nhưng lệnh get x của người dùng 2 vẫn trả về giá trị cũ là 2, trong khi người dùng 1 chưa commit.

Có một vài lý do tại sao việc ngăn dirty reads là hữu ích:

- Nếu một giao dịch cần cập nhật nhiều hàng, dirty read có nghĩa là giao dịch khác có thể thấy một số cập nhật nhưng không thấy tất cả. Ví dụ, trong Hình 8-2, người dùng thấy email chưa đọc mới nhưng không thấy bộ đếm đã cập nhật. Đây là dirty read của email. Thấy cơ sở dữ liệu ở trạng thái được cập nhật một phần gây nhầm lẫn cho người dùng và có thể khiến các giao dịch khác đưa ra quyết định không chính xác.

- Nếu một giao dịch hủy bỏ, mọi thao tác ghi mà nó đã thực hiện cần được rollback (hoàn tác) (như trong Hình 8-3). Nếu cơ sở dữ liệu cho phép dirty reads, điều đó có nghĩa là một giao dịch có thể thấy dữ liệu sau này bị rollback, tức là dữ liệu không bao giờ thực sự được commit vào cơ sở dữ liệu. Bất kỳ giao dịch nào đọc dữ liệu chưa commit cũng cần bị hủy bỏ, dẫn đến vấn đề gọi là cascading aborts (hủy bỏ dây chuyền).

Không có dirty writes

Điều gì xảy ra nếu hai giao dịch đồng thời cố gắng cập nhật cùng một hàng trong cơ sở dữ liệu? Chúng ta không biết thứ tự các thao tác ghi sẽ xảy ra theo thứ tự nào, nhưng thông thường chúng ta giả định rằng thao tác ghi sau sẽ ghi đè thao tác ghi trước.

Tuy nhiên, điều gì xảy ra nếu thao tác ghi trước là một phần của giao dịch chưa commit, vì vậy thao tác ghi sau sẽ ghi đè một giá trị chưa commit? Điều này được gọi là dirty write (ghi bẩn) 36. Các giao dịch chạy ở mức cách ly read committed phải ngăn dirty writes, thường bằng cách trì hoãn thao tác ghi thứ hai cho đến khi giao dịch của thao tác ghi đầu tiên đã commit hoặc hủy bỏ.

Bằng cách ngăn dirty writes, mức cách ly này tránh được một số loại vấn đề đồng thời:

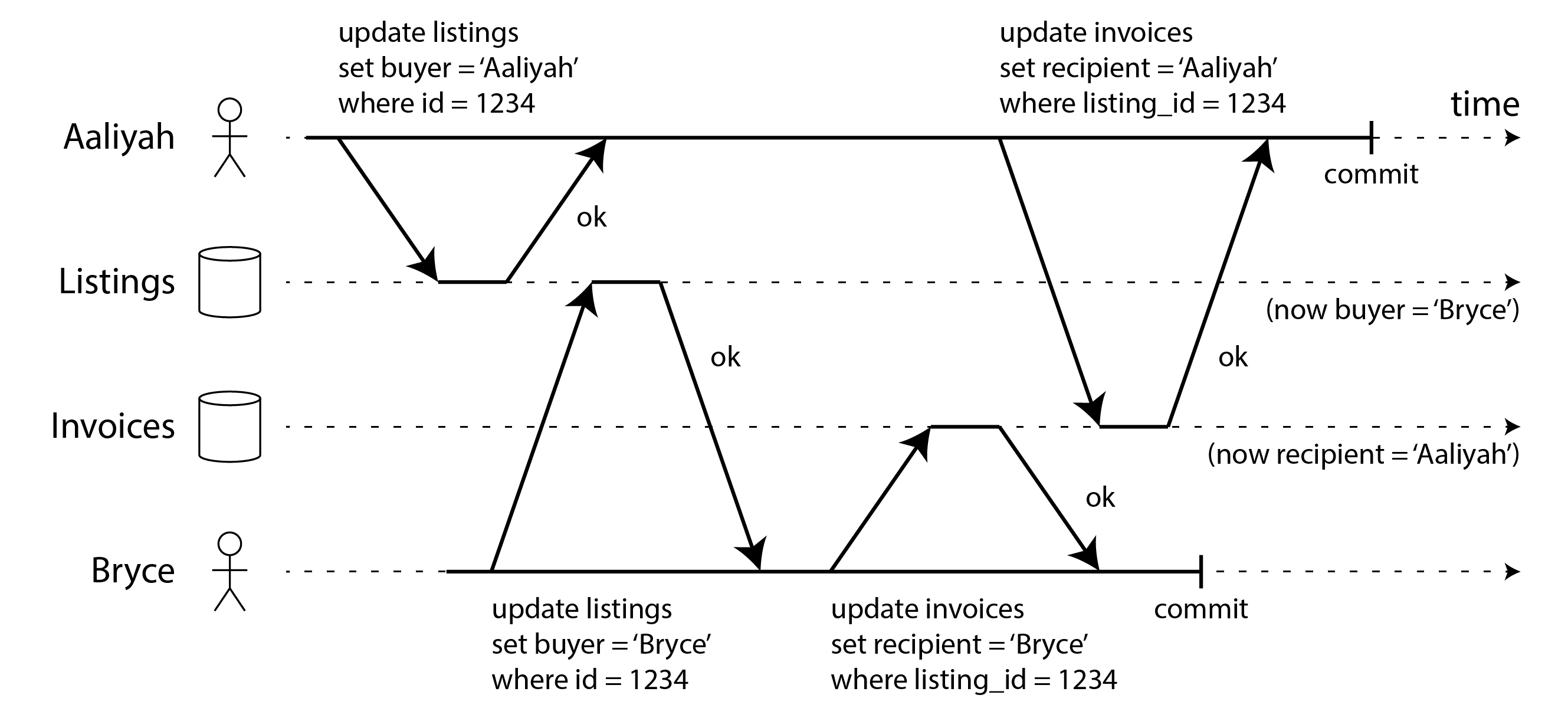

- Nếu các giao dịch cập nhật nhiều hàng, dirty writes có thể dẫn đến kết quả xấu. Ví dụ, hãy xem xét Hình 8-5, minh họa một trang web bán xe đã qua sử dụng nơi hai người, Aaliyah và Bryce, đang đồng thời cố gắng mua cùng một chiếc xe. Mua xe yêu cầu hai thao tác ghi vào cơ sở dữ liệu: danh sách trên trang web cần được cập nhật để phản ánh người mua, và hóa đơn bán hàng cần được gửi đến người mua. Trong trường hợp Hình 8-5, việc bán được trao cho Bryce (vì anh ấy thực hiện thao tác ghi thắng vào bảng

listings), nhưng hóa đơn được gửi cho Aaliyah (vì cô ấy thực hiện thao tác ghi thắng vào bảnginvoices). Read committed ngăn chặn những sự cố như vậy. - Tuy nhiên, read committed không ngăn race condition giữa hai lần tăng bộ đếm trong Hình 8-1. Trong trường hợp này, thao tác ghi thứ hai xảy ra sau khi giao dịch đầu tiên đã commit, vì vậy đây không phải là dirty write. Nó vẫn không chính xác, nhưng vì lý do khác, trong “Preventing Lost Updates” chúng ta sẽ thảo luận về cách làm cho các lần tăng bộ đếm như vậy an toàn.

Triển khai read committed

Read committed là một mức cách ly rất phổ biến. Đây là cài đặt mặc định trong Oracle Database, PostgreSQL, SQL Server và nhiều cơ sở dữ liệu khác 10.

Thông thường nhất, các cơ sở dữ liệu ngăn dirty writes bằng cách sử dụng row-level lock (khóa cấp hàng): khi một giao dịch muốn sửa đổi một hàng cụ thể (hoặc tài liệu hoặc một số đối tượng khác), nó phải trước tiên thu được khóa trên hàng đó. Sau đó nó phải giữ khóa đó cho đến khi giao dịch được commit hoặc hủy bỏ. Chỉ một giao dịch có thể giữ khóa cho bất kỳ hàng nào; nếu giao dịch khác muốn ghi vào cùng một hàng, nó phải đợi cho đến khi giao dịch đầu tiên commit hoặc hủy bỏ trước khi có thể thu được khóa và tiếp tục. Việc khóa này được thực hiện tự động bởi các cơ sở dữ liệu ở chế độ read committed (hoặc các mức cách ly mạnh hơn).

Làm thế nào để chúng ta ngăn dirty reads? Một tùy chọn sẽ là sử dụng cùng một khóa, và yêu cầu bất kỳ giao dịch nào muốn đọc một hàng phải tạm thời thu được khóa và sau đó giải phóng nó ngay lập tức sau khi đọc. Điều này sẽ đảm bảo rằng việc đọc không thể xảy ra trong khi một hàng có giá trị bẩn, chưa commit (vì trong thời gian đó khóa sẽ được giữ bởi giao dịch đã thực hiện thao tác ghi).

Tuy nhiên, cách tiếp cận yêu cầu read lock (khóa đọc) không hoạt động tốt trong thực tế, vì một giao dịch ghi chạy lâu có thể buộc nhiều giao dịch khác phải đợi cho đến khi giao dịch chạy lâu hoàn thành, ngay cả khi các giao dịch khác chỉ đọc và không ghi bất cứ thứ gì vào cơ sở dữ liệu. Điều này làm hại thời gian phản hồi của các giao dịch chỉ đọc và không tốt cho khả năng vận hành: sự chậm lại ở một phần của ứng dụng có thể có tác động dây chuyền ở một phần hoàn toàn khác của ứng dụng do chờ đợi khóa.

Tuy nhiên, các khóa được sử dụng để ngăn dirty reads trong một số cơ sở dữ liệu, chẳng hạn như IBM Db2 và Microsoft SQL Server với cài đặt read_committed_snapshot=off 29.

Một cách tiếp cận được sử dụng phổ biến hơn để ngăn dirty reads là cách được minh họa trong Hình 8-4: đối với mỗi hàng được ghi, cơ sở dữ liệu ghi nhớ cả giá trị cũ đã commit và giá trị mới được đặt bởi giao dịch hiện đang giữ write lock. Trong khi giao dịch đang diễn ra, bất kỳ giao dịch nào khác đọc hàng đó đều chỉ được cung cấp giá trị cũ. Chỉ khi giá trị mới được commit, các giao dịch mới chuyển sang đọc giá trị mới (xem “Multi-version concurrency control (MVCC)” để biết thêm chi tiết).

Snapshot Isolation và Repeatable Read

Nếu bạn nhìn nông cạn vào read committed isolation, bạn có thể được tha thứ khi nghĩ rằng nó làm mọi thứ mà một giao dịch cần làm: nó cho phép hủy bỏ (cần thiết cho atomicity), nó ngăn việc đọc kết quả chưa hoàn chỉnh của các giao dịch, và nó ngăn các thao tác ghi đồng thời bị trộn lẫn. Thực sự, đây là những tính năng hữu ích, và là những đảm bảo mạnh hơn nhiều so với những gì bạn có thể nhận được từ một hệ thống không có giao dịch.

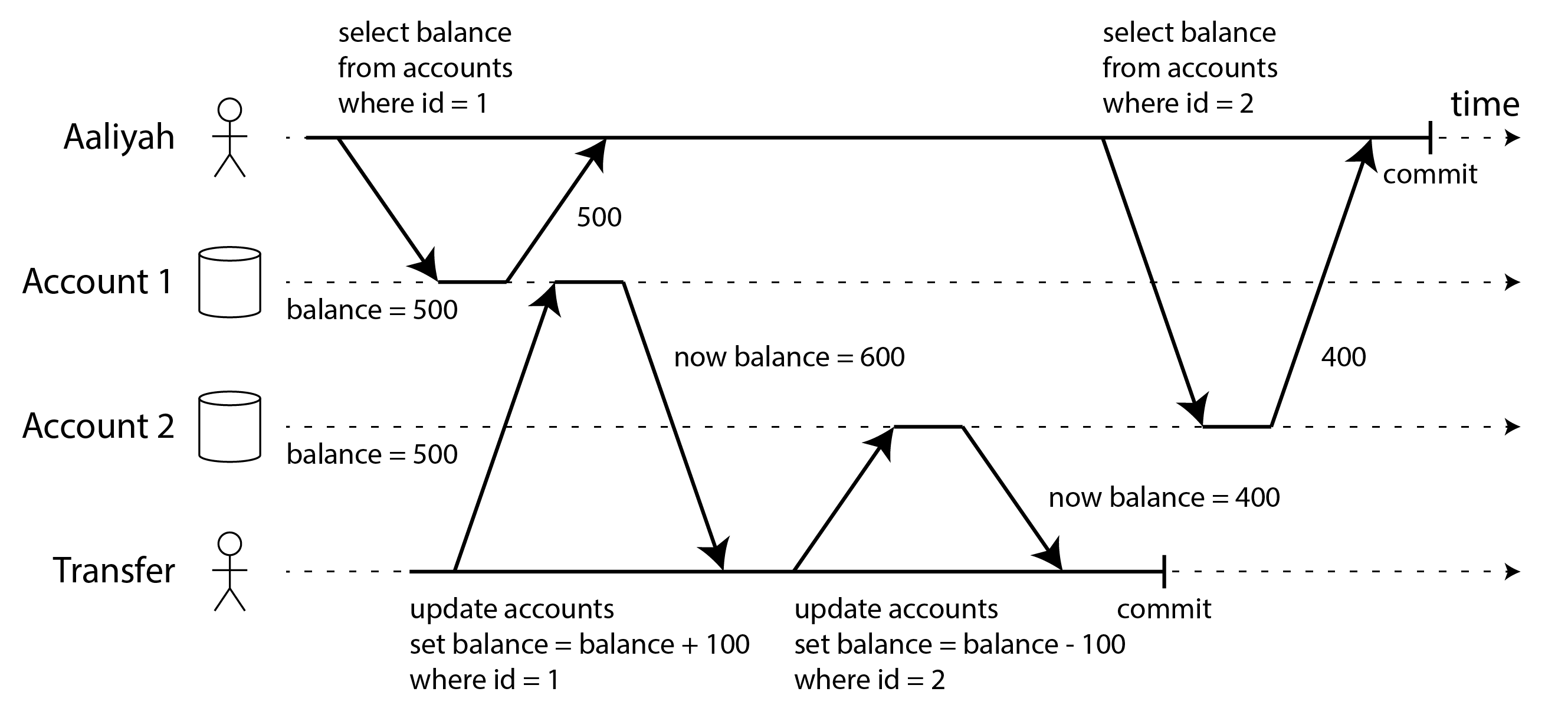

Tuy nhiên, vẫn còn rất nhiều cách bạn có thể gặp lỗi đồng thời khi sử dụng mức cách ly này. Ví dụ, Hình 8-6 minh họa một vấn đề có thể xảy ra với read committed.

Giả sử Aaliyah có 1.000 đô la tiết kiệm tại một ngân hàng, chia thành hai tài khoản mỗi tài khoản 500 đô la. Bây giờ một giao dịch chuyển 100 đô la từ một trong các tài khoản của cô sang tài khoản kia. Nếu cô ấy không may nhìn vào danh sách số dư tài khoản của mình đúng vào thời điểm giao dịch đó đang được xử lý, cô ấy có thể thấy số dư của một tài khoản trước khi khoản tiền đến (với số dư 500 đô la), và tài khoản kia sau khi khoản chuyển ra đã được thực hiện (số dư mới là 400 đô la). Với Aaliyah, bây giờ có vẻ như cô ấy chỉ có tổng cộng 900 đô la trong các tài khoản của mình, dường như 100 đô la đã biến mất vào không khí.

Hiện tượng này được gọi là read skew (lệch đọc), và đây là một ví dụ về nonrepeatable read (đọc không thể lặp lại): nếu Aaliyah đọc lại số dư của tài khoản 1 vào cuối giao dịch, cô ấy sẽ thấy một giá trị khác (600 đô la) so với những gì cô ấy thấy trong truy vấn trước đó. Read skew được coi là chấp nhận được theo read committed isolation: các số dư tài khoản mà Aaliyah thấy thực sự đã được commit tại thời điểm cô ấy đọc chúng.

Note

Thuật ngữ skew (lệch) không may bị quá tải: trước đó chúng ta đã sử dụng nó theo nghĩa khối lượng công việc mất cân bằng với các điểm nóng (xem “Skewed Workloads and Relieving Hot Spots”), trong khi ở đây nó có nghĩa là hiện tượng thời gian bất thường.

Trong trường hợp của Aaliyah, đây không phải là vấn đề lâu dài, vì cô ấy rất có thể sẽ thấy số dư tài khoản nhất quán nếu cô ấy tải lại trang web ngân hàng trực tuyến sau vài giây. Tuy nhiên, một số tình huống không thể chịu đựng sự không nhất quán tạm thời như vậy:

- Sao lưu (Backups)

- Việc sao lưu yêu cầu tạo bản sao của toàn bộ cơ sở dữ liệu, có thể mất nhiều giờ trên một cơ sở dữ liệu lớn. Trong thời gian quá trình sao lưu đang chạy, các thao tác ghi sẽ tiếp tục được thực hiện vào cơ sở dữ liệu. Do đó, bạn có thể kết thúc với một số phần của bản sao lưu chứa phiên bản cũ hơn của dữ liệu, và các phần khác chứa phiên bản mới hơn. Nếu bạn cần khôi phục từ bản sao lưu như vậy, các sự không nhất quán (chẳng hạn như tiền biến mất) trở thành vĩnh viễn.

- Các truy vấn phân tích và kiểm tra tính toàn vẹn

- Đôi khi, bạn có thể muốn chạy một truy vấn quét qua các phần lớn của cơ sở dữ liệu. Các truy vấn như vậy phổ biến trong analytics (phân tích) (xem “Analytical versus Operational Systems”), hoặc có thể là một phần của kiểm tra tính toàn vẹn định kỳ rằng mọi thứ đều theo thứ tự (giám sát để phát hiện hỏng dữ liệu). Các truy vấn này có thể trả về kết quả vô nghĩa nếu chúng quan sát các phần của cơ sở dữ liệu tại các thời điểm khác nhau.

Snapshot isolation (cách ly bản chụp) 36 là giải pháp phổ biến nhất cho vấn đề này. Ý tưởng là mỗi giao dịch đọc từ một consistent snapshot (bản chụp nhất quán) của cơ sở dữ liệu, tức là giao dịch thấy tất cả dữ liệu đã được commit trong cơ sở dữ liệu tại thời điểm bắt đầu giao dịch. Ngay cả khi dữ liệu sau đó được thay đổi bởi giao dịch khác, mỗi giao dịch chỉ thấy dữ liệu cũ từ thời điểm cụ thể đó.

Snapshot isolation là một lợi ích lớn cho các truy vấn chỉ đọc chạy lâu như sao lưu và phân tích. Rất khó để lý luận về ý nghĩa của một truy vấn nếu dữ liệu mà nó hoạt động đang thay đổi đồng thời với khi truy vấn đang thực thi. Khi một giao dịch có thể thấy bản chụp nhất quán của cơ sở dữ liệu, được đóng băng tại một thời điểm cụ thể, điều đó dễ hiểu hơn nhiều.

Snapshot isolation là tính năng phổ biến: các biến thể của nó được hỗ trợ bởi PostgreSQL, MySQL với storage engine InnoDB, Oracle, SQL Server và những cái khác, mặc dù hành vi chi tiết khác nhau từ hệ thống này sang hệ thống khác 29 40 41. Một số cơ sở dữ liệu, chẳng hạn như Oracle, TiDB và Aurora DSQL, thậm chí chọn snapshot isolation làm mức isolation cao nhất của họ.

Multi-version concurrency control (MVCC)

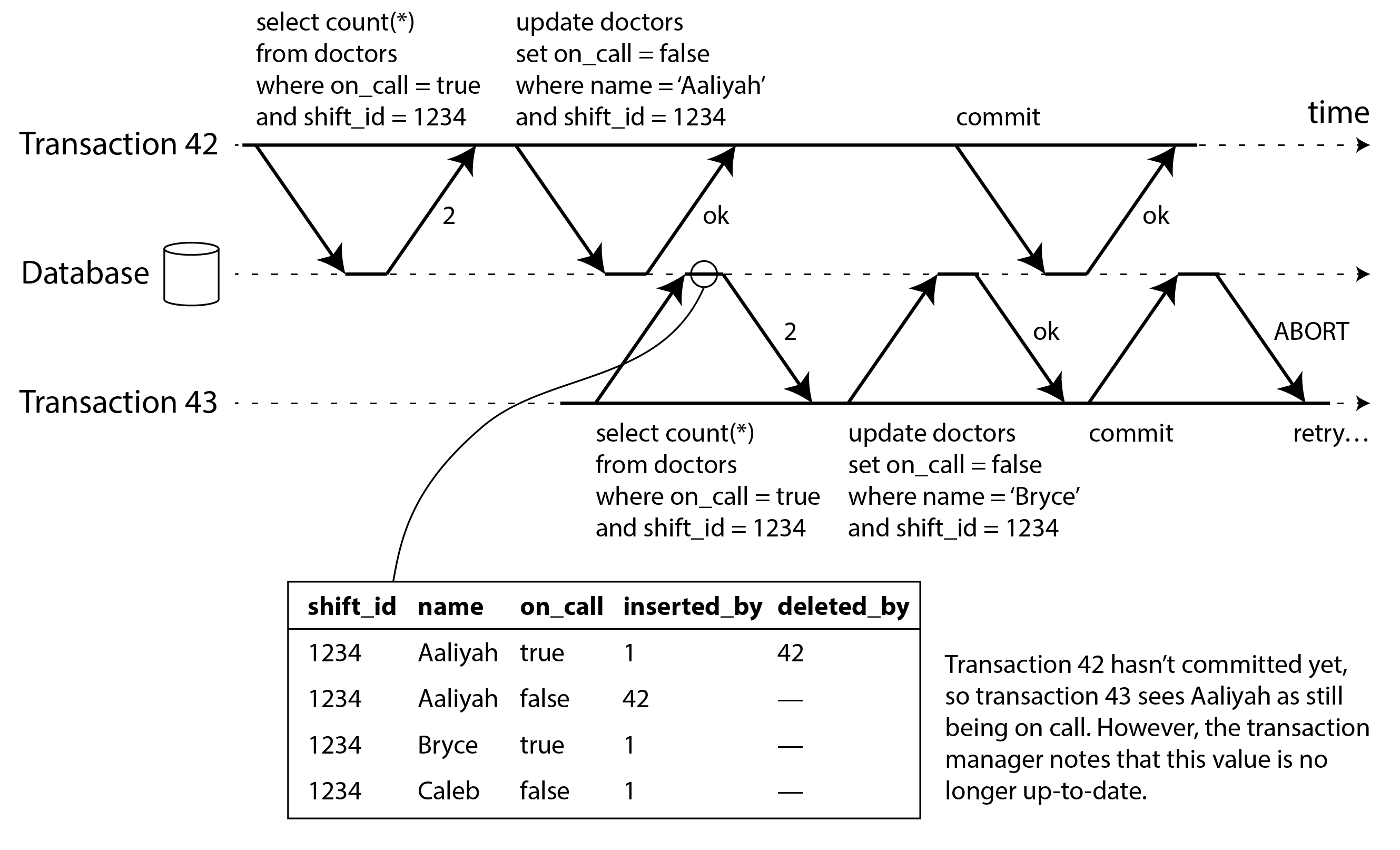

Giống như read committed isolation, các triển khai snapshot isolation thường sử dụng write lock để ngăn dirty writes (xem “Implementing read committed”), có nghĩa là một giao dịch thực hiện thao tác ghi có thể chặn tiến trình của giao dịch khác ghi vào cùng một hàng. Tuy nhiên, việc đọc không yêu cầu bất kỳ khóa nào. Từ góc độ hiệu năng, nguyên tắc chính của snapshot isolation là reader không bao giờ chặn writer, và writer không bao giờ chặn reader. Điều này cho phép cơ sở dữ liệu xử lý các truy vấn đọc chạy lâu trên một bản chụp nhất quán cùng lúc với việc xử lý các thao tác ghi bình thường, mà không có bất kỳ tranh chấp khóa nào giữa hai bên.

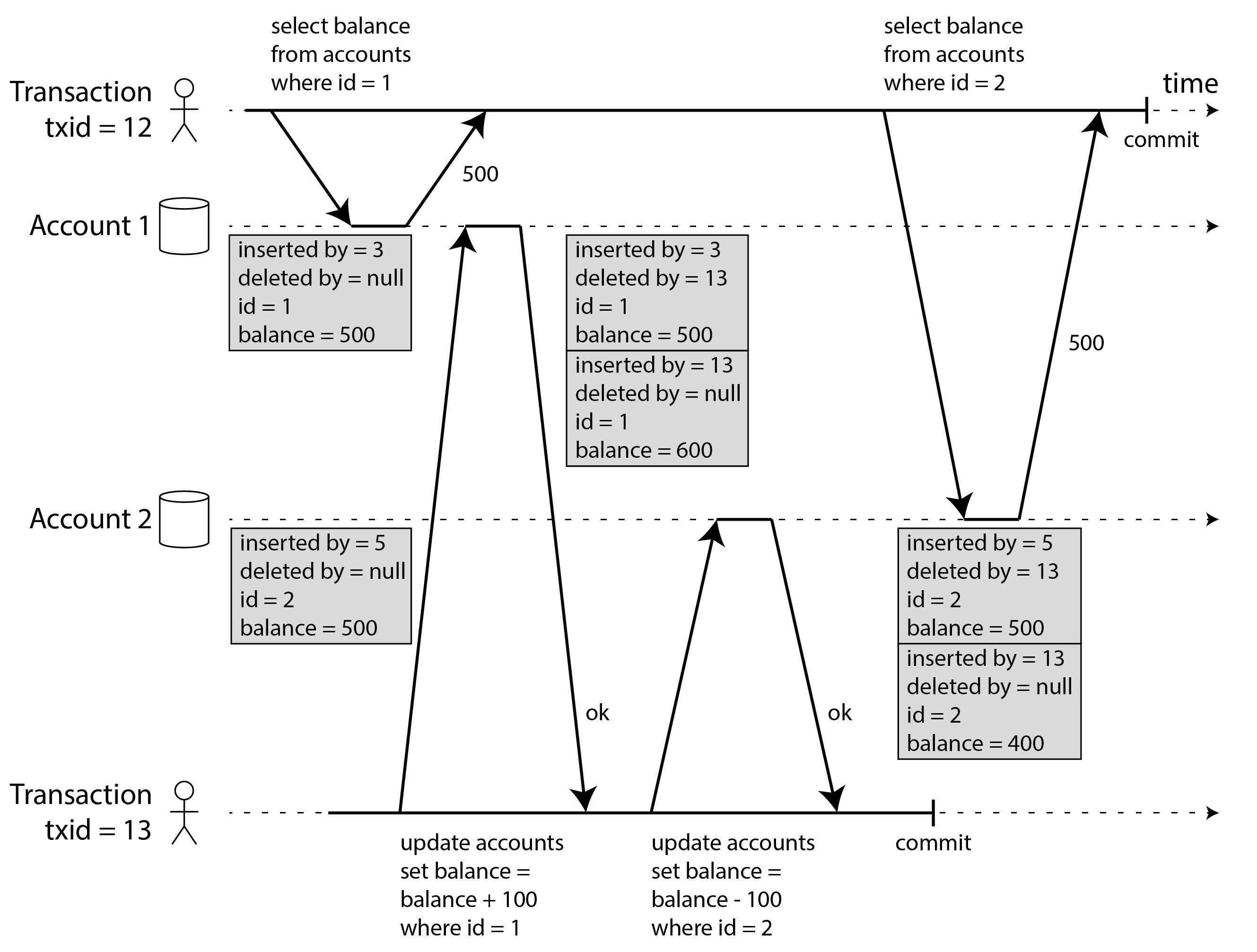

Để triển khai snapshot isolation, các cơ sở dữ liệu sử dụng sự tổng quát hóa của cơ chế chúng ta đã thấy để ngăn dirty reads trong Hình 8-4. Thay vì hai phiên bản của mỗi hàng (phiên bản đã commit và phiên bản đã ghi đè nhưng chưa commit), cơ sở dữ liệu phải có khả năng giữ nhiều phiên bản đã commit khác nhau của một hàng, vì các giao dịch đang trong tiến trình khác nhau có thể cần thấy trạng thái của cơ sở dữ liệu tại các thời điểm khác nhau. Vì nó duy trì nhiều phiên bản của một hàng song song, kỹ thuật này được gọi là multi-version concurrency control (MVCC, kiểm soát đồng thời nhiều phiên bản).

Hình 8-7 minh họa cách triển khai snapshot isolation dựa trên MVCC trong PostgreSQL 40 42 43 (các triển khai khác tương tự). Khi một giao dịch được bắt đầu, nó được cấp một transaction ID (txid) duy nhất, luôn tăng. Bất cứ khi nào một giao dịch ghi bất cứ thứ gì vào cơ sở dữ liệu, dữ liệu nó ghi được gắn thẻ với transaction ID của người ghi. (Để chính xác, transaction ID trong PostgreSQL là số nguyên 32-bit, vì vậy chúng tràn sau khoảng 4 tỷ giao dịch. Quá trình vacuum thực hiện dọn dẹp để đảm bảo rằng sự tràn không ảnh hưởng đến dữ liệu.)

Mỗi hàng trong bảng có trường inserted_by, chứa ID của giao dịch đã chèn hàng này vào bảng. Hơn nữa, mỗi hàng có trường deleted_by, ban đầu trống. Nếu một giao dịch xóa một hàng, hàng đó không thực sự bị xóa khỏi cơ sở dữ liệu, nhưng nó được đánh dấu để xóa bằng cách đặt trường deleted_by thành ID của giao dịch đã yêu cầu xóa. Tại một thời điểm nào đó sau đó, khi chắc chắn rằng không có giao dịch nào có thể truy cập dữ liệu đã xóa nữa, một quá trình garbage collection trong cơ sở dữ liệu sẽ xóa các hàng được đánh dấu để xóa và giải phóng không gian của chúng.

Một thao tác cập nhật được dịch nội bộ thành xóa và chèn 44. Ví dụ, trong Hình 8-7, giao dịch 13 trừ 100 đô la từ tài khoản 2, thay đổi số dư từ 500 đô la thành 400 đô la. Bảng accounts hiện thực sự chứa hai hàng cho tài khoản 2: một hàng có số dư 500 đô la được đánh dấu là đã xóa bởi giao dịch 13, và một hàng có số dư 400 đô la được chèn bởi giao dịch 13.

Tất cả các phiên bản của một hàng được lưu trữ trong cùng một database heap (vùng heap cơ sở dữ liệu) (xem “Storing values within the index”), bất kể liệu các giao dịch đã ghi chúng đã commit hay chưa. Các phiên bản của cùng một hàng tạo thành một danh sách liên kết, đi từ phiên bản mới nhất đến phiên bản cũ nhất hoặc theo chiều ngược lại, để các truy vấn có thể lặp qua nội bộ tất cả các phiên bản của một hàng 45 46.

Quy tắc hiển thị để quan sát bản chụp nhất quán

Khi một giao dịch đọc từ cơ sở dữ liệu, transaction ID được sử dụng để quyết định phiên bản hàng nào nó có thể thấy và phiên bản nào vô hình. Bằng cách định nghĩa cẩn thận các quy tắc hiển thị, cơ sở dữ liệu có thể trình bày một bản chụp nhất quán của cơ sở dữ liệu cho ứng dụng. Điều này hoạt động đại khái như sau 43:

- Tại thời điểm bắt đầu mỗi giao dịch, cơ sở dữ liệu tạo danh sách tất cả các giao dịch khác đang trong tiến trình (chưa commit hoặc hủy bỏ) tại thời điểm đó. Mọi thao tác ghi mà những giao dịch đó đã thực hiện đều bị bỏ qua, ngay cả khi các giao dịch sau đó commit. Điều này đảm bảo rằng chúng ta thấy bản chụp nhất quán không bị ảnh hưởng bởi giao dịch khác commit.

- Mọi thao tác ghi được thực hiện bởi các giao dịch có transaction ID muộn hơn (tức là bắt đầu sau khi giao dịch hiện tại bắt đầu, và do đó không có trong danh sách các giao dịch đang trong tiến trình) đều bị bỏ qua, bất kể liệu những giao dịch đó đã commit hay chưa.

- Mọi thao tác ghi được thực hiện bởi các giao dịch bị hủy bỏ đều bị bỏ qua, bất kể thời điểm hủy bỏ đó xảy ra. Điều này có ưu điểm là khi một giao dịch hủy bỏ, chúng ta không cần ngay lập tức xóa các hàng mà nó đã ghi khỏi bộ lưu trữ, vì quy tắc hiển thị sẽ lọc chúng ra. Quá trình garbage collection có thể xóa chúng sau.

- Tất cả các thao tác ghi khác đều hiển thị với các truy vấn của ứng dụng.

Các quy tắc này áp dụng cho cả chèn và xóa hàng. Trong Hình 8-7, khi giao dịch 12 đọc từ tài khoản 2, nó thấy số dư 500 đô la vì việc xóa số dư 500 đô la được thực hiện bởi giao dịch 13 (theo quy tắc 2, giao dịch 12 không thể thấy việc xóa được thực hiện bởi giao dịch 13), và việc chèn số dư 400 đô la chưa hiển thị (theo cùng quy tắc).

Nói cách khác, một hàng hiển thị nếu cả hai điều kiện sau đây đúng:

- Tại thời điểm giao dịch của người đọc bắt đầu, giao dịch đã chèn hàng đó đã commit.

- Hàng không được đánh dấu để xóa, hoặc nếu có, giao dịch đã yêu cầu xóa chưa commit tại thời điểm giao dịch của người đọc bắt đầu.

Một giao dịch chạy lâu có thể tiếp tục sử dụng một bản chụp trong một thời gian dài, tiếp tục đọc các giá trị mà (từ góc độ của các giao dịch khác) đã bị ghi đè hoặc xóa từ lâu. Bằng cách không bao giờ cập nhật các giá trị tại chỗ mà thay vào đó chèn một phiên bản mới mỗi khi một giá trị được thay đổi, cơ sở dữ liệu có thể cung cấp bản chụp nhất quán trong khi chỉ phát sinh một chi phí nhỏ.

Chỉ mục và snapshot isolation

Các chỉ mục hoạt động như thế nào trong một cơ sở dữ liệu đa phiên bản? Cách tiếp cận phổ biến nhất là mỗi mục nhập chỉ mục trỏ đến một trong các phiên bản của hàng khớp với mục nhập (phiên bản cũ nhất hoặc mới nhất). Mỗi phiên bản hàng có thể chứa tham chiếu đến phiên bản cũ nhất tiếp theo hoặc mới nhất tiếp theo. Một truy vấn sử dụng chỉ mục sau đó phải lặp qua các hàng để tìm hàng hiển thị và giá trị khớp với những gì truy vấn đang tìm kiếm. Khi garbage collection xóa các phiên bản hàng cũ không còn hiển thị với bất kỳ giao dịch nào, các mục nhập chỉ mục tương ứng cũng có thể được xóa.

Nhiều chi tiết triển khai ảnh hưởng đến hiệu năng của multi-version concurrency control 45 46. Ví dụ, PostgreSQL có các tối ưu hóa để tránh cập nhật chỉ mục nếu các phiên bản khác nhau của cùng một hàng có thể vừa trên cùng một trang 40. Một số cơ sở dữ liệu khác tránh lưu trữ bản sao đầy đủ của các hàng được sửa đổi, và chỉ lưu trữ sự khác biệt giữa các phiên bản để tiết kiệm không gian.

Một cách tiếp cận khác được sử dụng trong CouchDB, Datomic và LMDB. Mặc dù chúng cũng sử dụng B-tree (xem “B-Trees”), chúng sử dụng biến thể bất biến (copy-on-write) không ghi đè các trang của cây khi chúng được cập nhật, mà thay vào đó tạo bản sao mới của mỗi trang được sửa đổi. Các trang cha, lên đến gốc của cây, được sao chép và cập nhật để trỏ đến các phiên bản mới của các trang con của chúng. Bất kỳ trang nào không bị ảnh hưởng bởi thao tác ghi không cần được sao chép, và có thể được chia sẻ với cây mới 47.

Với B-tree bất biến, mỗi giao dịch ghi (hoặc lô giao dịch) tạo ra một gốc B-tree mới, và một gốc cụ thể là bản chụp nhất quán của cơ sở dữ liệu tại thời điểm nó được tạo. Không cần lọc các hàng dựa trên transaction ID vì các thao tác ghi tiếp theo không thể sửa đổi B-tree hiện có; chúng chỉ có thể tạo gốc cây mới. Cách tiếp cận này cũng yêu cầu một quá trình nền để compaction (nén) và garbage collection.

Snapshot isolation, repeatable read và sự nhầm lẫn về tên gọi

MVCC là kỹ thuật triển khai thường được sử dụng cho các cơ sở dữ liệu, và thường nó được sử dụng để triển khai snapshot isolation. Tuy nhiên, các cơ sở dữ liệu khác nhau đôi khi sử dụng các thuật ngữ khác nhau để chỉ cùng một thứ: ví dụ, snapshot isolation được gọi là “repeatable read” trong PostgreSQL và “serializable” trong Oracle 29. Đôi khi các hệ thống khác nhau dùng cùng một thuật ngữ để chỉ những thứ khác nhau: chẳng hạn, trong PostgreSQL “repeatable read” có nghĩa là snapshot isolation, còn trong MySQL nó chỉ một cài đặt MVCC có tính nhất quán yếu hơn snapshot isolation 41.

Lý do dẫn đến sự nhầm lẫn về tên gọi này là chuẩn SQL không có khái niệm snapshot isolation, vì chuẩn được xây dựng dựa trên định nghĩa các mức cô lập của System R từ năm 1975 3 và snapshot isolation chưa được phát minh vào thời điểm đó. Thay vào đó, chuẩn định nghĩa repeatable read, trông bề ngoài tương tự với snapshot isolation. PostgreSQL gọi mức snapshot isolation của mình là “repeatable read” vì nó đáp ứng các yêu cầu của chuẩn, và nhờ vậy họ có thể tuyên bố tuân thủ chuẩn.

Đáng tiếc là định nghĩa các mức cô lập trong chuẩn SQL còn nhiều thiếu sót: nó mơ hồ, thiếu chính xác, và không độc lập với cài đặt như một chuẩn nên có 36. Dù nhiều cơ sở dữ liệu cài đặt repeatable read, những đảm bảo thực tế mà chúng cung cấp khác nhau đáng kể, dù về danh nghĩa đã được chuẩn hóa 29. Trong tài liệu nghiên cứu có tồn tại một định nghĩa chính thức về repeatable read 37 38, nhưng hầu hết các cài đặt không thỏa mãn định nghĩa chính thức đó. Thêm vào đó, IBM Db2 dùng “repeatable read” để chỉ serializability 10.

Kết quả là, không ai thực sự biết repeatable read có nghĩa là gì.

Ngăn chặn Lost Update (Cập nhật bị mất)

Các mức cô lập read committed và snapshot isolation mà chúng ta đã thảo luận chủ yếu nói về những đảm bảo về những gì một giao dịch chỉ đọc có thể thấy khi có các ghi đồng thời. Chúng ta hầu như bỏ qua vấn đề về hai giao dịch ghi đồng thời, chỉ thảo luận về dirty write (xem “No dirty writes”), một dạng xung đột ghi-ghi cụ thể có thể xảy ra.

Có nhiều loại xung đột thú vị khác có thể xảy ra giữa các giao dịch ghi đồng thời. Nổi tiếng nhất trong số đó là vấn đề lost update (cập nhật bị mất), được minh họa trong Hình 8-1 với ví dụ về hai lần tăng bộ đếm đồng thời.

Vấn đề lost update có thể xảy ra khi một ứng dụng đọc một giá trị từ cơ sở dữ liệu, sửa đổi nó, và ghi lại giá trị đã sửa (một chu kỳ đọc-sửa-ghi). Nếu hai giao dịch thực hiện điều này đồng thời, một trong những sửa đổi có thể bị mất, vì lần ghi thứ hai không bao gồm sửa đổi đầu tiên. (Đôi khi chúng ta nói rằng lần ghi sau ghi đè lần ghi trước.) Mẫu này xuất hiện trong nhiều tình huống khác nhau:

- Tăng bộ đếm hoặc cập nhật số dư tài khoản (đòi hỏi đọc giá trị hiện tại, tính toán giá trị mới, và ghi lại giá trị đã cập nhật)

- Thực hiện thay đổi cục bộ trong một giá trị phức tạp, ví dụ, thêm một phần tử vào danh sách trong một tài liệu JSON (đòi hỏi phân tích tài liệu, thực hiện thay đổi, và ghi lại tài liệu đã sửa đổi)

- Hai người dùng chỉnh sửa cùng một trang wiki vào cùng thời điểm, mỗi người lưu thay đổi bằng cách gửi toàn bộ nội dung trang lên server, ghi đè bất cứ thứ gì hiện có trong cơ sở dữ liệu

Vì đây là vấn đề rất phổ biến, nhiều giải pháp đã được phát triển 48.

Thao tác ghi nguyên tử (Atomic write operations)

Nhiều cơ sở dữ liệu cung cấp các thao tác cập nhật nguyên tử, giúp loại bỏ nhu cầu cài đặt chu kỳ đọc-sửa-ghi trong code ứng dụng. Đây thường là giải pháp tốt nhất nếu code của bạn có thể được biểu đạt bằng những thao tác đó. Ví dụ, lệnh sau đây an toàn với tính đồng thời trong hầu hết các cơ sở dữ liệu quan hệ:

UPDATE counters SET value = value + 1 WHERE key = 'foo';Tương tự, các cơ sở dữ liệu tài liệu như MongoDB cung cấp các thao tác nguyên tử để thực hiện sửa đổi cục bộ trên một phần của tài liệu JSON, và Redis cung cấp các thao tác nguyên tử để sửa đổi các cấu trúc dữ liệu như hàng ưu tiên (priority queue). Không phải tất cả các lần ghi đều có thể dễ dàng biểu đạt bằng các thao tác nguyên tử, ví dụ, cập nhật trang wiki liên quan đến chỉnh sửa văn bản tùy ý, có thể được xử lý bằng các thuật toán được thảo luận trong “CRDTs and Operational Transformation”, nhưng trong những tình huống mà thao tác nguyên tử có thể được sử dụng, chúng thường là lựa chọn tốt nhất.

Các thao tác nguyên tử thường được cài đặt bằng cách khóa độc quyền (exclusive lock) trên đối tượng khi đọc để không có giao dịch nào khác có thể đọc nó cho đến khi bản cập nhật được áp dụng. Một lựa chọn khác là đơn giản buộc tất cả các thao tác nguyên tử được thực thi trên một luồng đơn.

Đáng tiếc là các framework object-relational mapping (ORM) khiến dễ dàng vô tình viết code thực hiện chu kỳ đọc-sửa-ghi không an toàn thay vì sử dụng các thao tác nguyên tử do cơ sở dữ liệu cung cấp 49 50 51. Đây có thể là nguồn gốc của các lỗi tinh tế khó phát hiện qua kiểm thử.

Khóa tường minh (Explicit locking)

Một lựa chọn khác để ngăn chặn lost update, khi các thao tác nguyên tử tích hợp của cơ sở dữ liệu không cung cấp chức năng cần thiết, là để ứng dụng tường minh khóa các đối tượng sắp được cập nhật. Sau đó ứng dụng có thể thực hiện chu kỳ đọc-sửa-ghi, và nếu bất kỳ giao dịch nào khác cố gắng đồng thời cập nhật hoặc khóa cùng đối tượng đó, nó bị buộc phải chờ cho đến khi chu kỳ đọc-sửa-ghi đầu tiên hoàn thành.

Ví dụ, hãy xét một trò chơi nhiều người trong đó nhiều người chơi có thể di chuyển cùng một quân cờ đồng thời. Trong trường hợp này, một thao tác nguyên tử có thể không đủ, vì ứng dụng còn cần đảm bảo nước đi của người chơi tuân theo luật chơi, điều này liên quan đến một số logic mà bạn không thể cài đặt hợp lý dưới dạng truy vấn cơ sở dữ liệu. Thay vào đó, bạn có thể sử dụng khóa để ngăn hai người chơi di chuyển cùng một quân cờ đồng thời, như được minh họa trong Ví dụ 8-1.

Ví dụ 8-1. Khóa tường minh các hàng để ngăn chặn lost update

BEGIN TRANSACTION;

SELECT * FROM figures

WHERE name = 'robot' AND game_id = 222

FOR UPDATE; ❶

-- Check whether move is valid, then update the position

-- of the piece that was returned by the previous SELECT.

UPDATE figures SET position = 'c4' WHERE id = 1234;

COMMIT;❶: Mệnh đề FOR UPDATE chỉ ra rằng cơ sở dữ liệu nên khóa tất cả các hàng được trả về bởi truy vấn này.

Cách này hoạt động, nhưng để làm đúng, bạn cần suy nghĩ cẩn thận về logic ứng dụng. Rất dễ quên thêm khóa cần thiết ở đâu đó trong code, từ đó tạo ra race condition (điều kiện tranh chấp).

Hơn nữa, nếu bạn khóa nhiều đối tượng, có rủi ro xảy ra deadlock (khóa chết), khi hai hoặc nhiều giao dịch đang chờ nhau giải phóng khóa. Nhiều cơ sở dữ liệu tự động phát hiện deadlock và hủy bỏ một trong các giao dịch liên quan để hệ thống có thể tiếp tục. Bạn có thể xử lý tình huống này ở tầng ứng dụng bằng cách thử lại giao dịch đã bị hủy.

Tự động phát hiện lost update

Thao tác nguyên tử và khóa là các cách ngăn chặn lost update bằng cách buộc các chu kỳ đọc-sửa-ghi thực hiện tuần tự. Một lựa chọn khác là cho phép chúng thực thi song song và, nếu bộ quản lý giao dịch phát hiện một lost update, hủy bỏ giao dịch và buộc nó thử lại chu kỳ đọc-sửa-ghi.

Ưu điểm của cách tiếp cận này là cơ sở dữ liệu có thể thực hiện kiểm tra này hiệu quả kết hợp với snapshot isolation. Thực vậy, repeatable read của PostgreSQL, serializable của Oracle, và snapshot isolation của SQL Server tự động phát hiện khi một lost update đã xảy ra và hủy bỏ giao dịch vi phạm. Tuy nhiên, repeatable read của MySQL/InnoDB không phát hiện lost update 29 41. Một số tác giả 36 38 lập luận rằng cơ sở dữ liệu phải ngăn chặn lost update để đủ tiêu chuẩn cung cấp snapshot isolation, vì vậy MySQL không cung cấp snapshot isolation theo định nghĩa này.

Phát hiện lost update là một tính năng tuyệt vời, vì nó không yêu cầu code ứng dụng sử dụng bất kỳ tính năng cơ sở dữ liệu đặc biệt nào: bạn có thể quên sử dụng khóa hoặc thao tác nguyên tử và từ đó tạo ra lỗi, nhưng phát hiện lost update xảy ra tự động và do đó ít dễ xảy ra lỗi hơn. Tuy nhiên, bạn cũng phải thử lại các giao dịch bị hủy ở tầng ứng dụng.

Ghi có điều kiện (Conditional writes, compare-and-set)

Trong các cơ sở dữ liệu không cung cấp giao dịch, đôi khi bạn tìm thấy một thao tác conditional write (ghi có điều kiện) có thể ngăn chặn lost update bằng cách chỉ cho phép cập nhật xảy ra nếu giá trị chưa thay đổi kể từ lần bạn đọc nó lần cuối (đã đề cập trước đó trong “Single-object writes”). Nếu giá trị hiện tại không khớp với những gì bạn đọc trước đó, bản cập nhật không có tác dụng, và chu kỳ đọc-sửa-ghi phải được thử lại. Đây là tương đương của cơ sở dữ liệu với lệnh nguyên tử compare-and-set hoặc compare-and-swap (CAS) được nhiều CPU hỗ trợ.

Ví dụ, để ngăn hai người dùng đồng thời cập nhật cùng một trang wiki, bạn có thể thử điều gì đó như sau, kỳ vọng rằng bản cập nhật chỉ xảy ra nếu nội dung trang chưa thay đổi kể từ khi người dùng bắt đầu chỉnh sửa:

-- This may or may not be safe, depending on the database implementation

UPDATE wiki_pages SET content = 'new content'

WHERE id = 1234 AND content = 'old content';Nếu nội dung đã thay đổi và không còn khớp với 'old content', bản cập nhật này sẽ không có tác dụng,

vì vậy bạn cần kiểm tra xem bản cập nhật có được thực hiện hay không và thử lại nếu cần. Thay vì so sánh

toàn bộ nội dung, bạn cũng có thể sử dụng một cột số phiên bản mà bạn tăng lên ở mỗi lần cập nhật, và

áp dụng bản cập nhật chỉ khi số phiên bản hiện tại chưa thay đổi. Cách tiếp cận này đôi khi

được gọi là optimistic locking (khóa lạc quan) 52.

Lưu ý rằng nếu một giao dịch khác đã đồng thời sửa đổi content, nội dung mới có thể không

hiển thị theo các quy tắc hiển thị MVCC (xem “Visibility rules for observing a consistent snapshot”). Nhiều

cài đặt MVCC có ngoại lệ đối với các quy tắc hiển thị cho tình huống này, nơi các giá trị

được ghi bởi các giao dịch khác hiển thị khi đánh giá mệnh đề WHERE của các truy vấn UPDATE và

DELETE, ngay cả khi những lần ghi đó không hiển thị trong snapshot theo cách khác.

Giải quyết xung đột và sao chép (Conflict resolution and replication)

Trong các cơ sở dữ liệu được sao chép (xem Chương 6), việc ngăn chặn lost update mang thêm một chiều kích khác: vì chúng có các bản sao dữ liệu trên nhiều nút, và dữ liệu có thể được sửa đổi đồng thời trên các nút khác nhau, cần thực hiện một số bước bổ sung để ngăn chặn lost update.

Khóa và thao tác ghi có điều kiện giả định rằng có một bản sao dữ liệu duy nhất đã được cập nhật. Tuy nhiên, các cơ sở dữ liệu với sao chép multi-leader hoặc leaderless thường cho phép nhiều lần ghi xảy ra đồng thời và sao chép chúng bất đồng bộ, vì vậy chúng không thể đảm bảo rằng có một bản sao dữ liệu duy nhất đã được cập nhật. Do đó, các kỹ thuật dựa trên khóa hoặc ghi có điều kiện không áp dụng trong ngữ cảnh này. (Chúng ta sẽ xem xét lại vấn đề này chi tiết hơn trong “Linearizability”.)

Thay vào đó, như đã thảo luận trong “Dealing with Conflicting Writes”, một cách tiếp cận phổ biến trong các cơ sở dữ liệu được sao chép như vậy là cho phép các lần ghi đồng thời tạo ra nhiều phiên bản xung đột của một giá trị (còn được gọi là siblings, tức các bản sao anh em), và sử dụng code ứng dụng hoặc cấu trúc dữ liệu đặc biệt để giải quyết và hợp nhất các phiên bản này sau đó.

Hợp nhất các giá trị xung đột có thể ngăn chặn lost update nếu các cập nhật có tính giao hoán (tức là bạn có thể áp dụng chúng theo thứ tự khác nhau trên các bản sao khác nhau và vẫn nhận được kết quả giống nhau). Ví dụ, tăng bộ đếm hoặc thêm một phần tử vào tập hợp là các thao tác giao hoán. Đó là ý tưởng đằng sau CRDTs, mà chúng ta đã gặp trong “CRDTs and Operational Transformation”. Tuy nhiên, một số thao tác như ghi có điều kiện không thể được tạo ra có tính giao hoán.

Mặt khác, phương thức giải quyết xung đột last write wins (LWW, thắng theo lần ghi cuối) dễ bị lost update, như đã thảo luận trong “Last write wins (discarding concurrent writes)”. Đáng tiếc là LWW là mặc định trong nhiều cơ sở dữ liệu được sao chép.

Write Skew và Phantom

Trong các phần trước chúng ta đã thấy dirty write và lost update, hai loại race condition có thể xảy ra khi các giao dịch khác nhau đồng thời cố ghi vào cùng các đối tượng. Để tránh hỏng dữ liệu, những race condition đó cần được ngăn chặn, hoặc tự động bởi cơ sở dữ liệu, hoặc bằng các biện pháp thủ công như sử dụng khóa hoặc thao tác ghi nguyên tử.

Tuy nhiên, đó chưa phải là hết các race condition tiềm ẩn có thể xảy ra giữa các lần ghi đồng thời. Trong phần này chúng ta sẽ thấy một số ví dụ tinh tế hơn về xung đột.

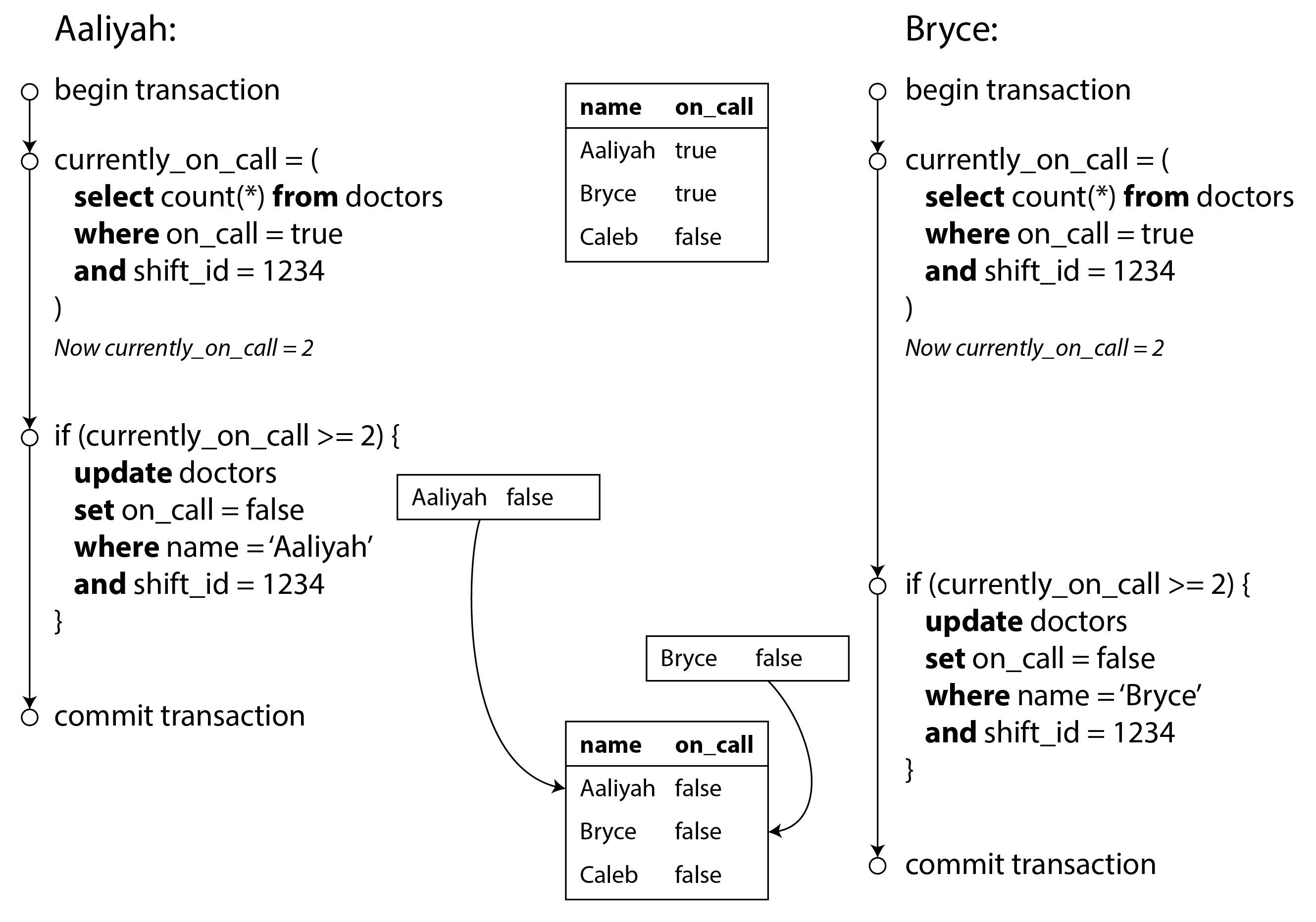

Để bắt đầu, hãy tưởng tượng ví dụ này: bạn đang viết ứng dụng cho các bác sĩ để quản lý ca trực của họ tại bệnh viện. Bệnh viện thường cố gắng có nhiều bác sĩ trực bất kỳ lúc nào, nhưng bắt buộc phải có ít nhất một bác sĩ trực. Các bác sĩ có thể từ bỏ ca trực của mình (ví dụ, nếu chính họ bị ốm), với điều kiện có ít nhất một đồng nghiệp vẫn còn trực trong ca đó 53 54.

Bây giờ hãy tưởng tượng Aaliyah và Bryce là hai bác sĩ trực cho một ca cụ thể. Cả hai cảm thấy không khỏe, vì vậy cả hai quyết định xin nghỉ. Đáng tiếc là họ tình cờ nhấp vào nút để rời ca trực vào khoảng cùng một thời điểm. Những gì xảy ra tiếp theo được minh họa trong Hình 8-8.

Trong mỗi giao dịch, ứng dụng của bạn trước tiên kiểm tra xem có hai bác sĩ trở lên đang trực hay không;

nếu có, nó cho rằng việc một bác sĩ rời ca trực là an toàn. Vì cơ sở dữ liệu đang sử dụng snapshot

isolation, cả hai kiểm tra đều trả về 2, vì vậy cả hai giao dịch tiến đến giai đoạn tiếp theo. Aaliyah cập nhật

bản ghi của mình để rời ca trực, và Bryce cập nhật bản ghi của mình tương tự. Cả hai giao dịch

commit, và bây giờ không có bác sĩ nào trực. Yêu cầu của bạn về việc có ít nhất một bác sĩ trực đã bị vi phạm.

Đặc điểm của write skew

Sự bất thường này được gọi là write skew (lệch ghi) 36. Nó không phải là dirty write cũng không phải lost update, vì hai giao dịch đang cập nhật hai đối tượng khác nhau (lần lượt là bản ghi trực của Aaliyah và Bryce). Ít rõ ràng hơn là một xung đột đã xảy ra ở đây, nhưng rõ ràng đây là một race condition: nếu hai giao dịch đã chạy lần lượt, thì bác sĩ thứ hai đã bị ngăn không cho rời ca trực. Hành vi bất thường chỉ xảy ra được vì các giao dịch chạy đồng thời.

Bạn có thể coi write skew là sự tổng quát hóa của vấn đề lost update. Write skew có thể xảy ra nếu hai giao dịch đọc cùng các đối tượng, và sau đó cập nhật một số đối tượng đó (các giao dịch khác nhau có thể cập nhật các đối tượng khác nhau). Trong trường hợp đặc biệt khi các giao dịch khác nhau cập nhật cùng một đối tượng, bạn sẽ gặp sự bất thường dirty write hoặc lost update (tùy thuộc vào thời điểm).

Chúng ta đã thấy rằng có nhiều cách khác nhau để ngăn chặn lost update. Với write skew, các lựa chọn của chúng ta bị hạn chế hơn:

Thao tác nguyên tử trên đối tượng đơn không giúp ích, vì nhiều đối tượng liên quan.

Tính năng tự động phát hiện lost update mà bạn thấy trong một số cài đặt snapshot isolation đáng tiếc cũng không giúp ích: write skew không được tự động phát hiện trong repeatable read của PostgreSQL, repeatable read của MySQL/InnoDB, serializable của Oracle, hay mức snapshot isolation của SQL Server 29. Tự động ngăn chặn write skew yêu cầu cô lập thực sự serializable (xem “Serializability”).

Một số cơ sở dữ liệu cho phép bạn cấu hình các ràng buộc, sau đó được cơ sở dữ liệu thực thi (ví dụ, tính duy nhất, ràng buộc khóa ngoại, hoặc hạn chế về một giá trị cụ thể). Tuy nhiên, để chỉ định rằng ít nhất một bác sĩ phải trực, bạn sẽ cần một ràng buộc liên quan đến nhiều đối tượng. Hầu hết các cơ sở dữ liệu không có hỗ trợ tích hợp cho các ràng buộc như vậy, nhưng bạn có thể có thể cài đặt chúng với trigger hoặc materialized view, như đã thảo luận trong “Consistency” 12.

Nếu bạn không thể sử dụng mức cô lập serializable, lựa chọn tốt thứ hai trong trường hợp này có lẽ là khóa tường minh các hàng mà giao dịch phụ thuộc vào. Trong ví dụ về bác sĩ, bạn có thể viết gì đó như sau:

BEGIN TRANSACTION; SELECT * FROM doctors WHERE on_call = true AND shift_id = 1234 FOR UPDATE; ❶ UPDATE doctors SET on_call = false WHERE name = 'Aaliyah' AND shift_id = 1234; COMMIT;

❶: Như trước đây, FOR UPDATE yêu cầu cơ sở dữ liệu khóa tất cả các hàng được trả về bởi truy vấn này.

Thêm ví dụ về write skew

Write skew thoạt đầu có vẻ là một vấn đề kỳ lạ, nhưng một khi bạn nhận thức được nó, bạn có thể nhận thấy nhiều tình huống hơn mà nó có thể xảy ra. Dưới đây là một số ví dụ khác:

- Hệ thống đặt phòng họp

- Giả sử bạn muốn đảm bảo rằng không thể có hai lần đặt chỗ cho cùng một phòng họp vào cùng thời điểm 55.

Khi ai đó muốn đặt chỗ, bạn trước tiên kiểm tra các lần đặt chỗ xung đột (tức là

các lần đặt chỗ cho cùng phòng với khoảng thời gian chồng lấp), và nếu không tìm thấy, bạn tạo

cuộc họp (xem Ví dụ 8-2).

Ví dụ 8-2. Hệ thống đặt phòng họp cố gắng tránh đặt chỗ trùng lặp (không an toàn dưới snapshot isolation)

BEGIN TRANSACTION; -- Check for any existing bookings that overlap with the period of noon-1pm SELECT COUNT(*) FROM bookings WHERE room_id = 123 AND end_time > '2025-01-01 12:00' AND start_time < '2025-01-01 13:00'; -- If the previous query returned zero: INSERT INTO bookings (room_id, start_time, end_time, user_id) VALUES (123, '2025-01-01 12:00', '2025-01-01 13:00', 666); COMMIT;Đáng tiếc là snapshot isolation không ngăn người dùng khác đồng thời chèn một cuộc họp xung đột. Để đảm bảo bạn sẽ không gặp xung đột lịch, bạn một lần nữa cần cô lập serializable.

- Trò chơi nhiều người

- Trong Ví dụ 8-1, chúng ta đã dùng khóa để ngăn chặn lost update (tức là đảm bảo rằng hai người chơi không thể di chuyển cùng một quân cờ vào cùng thời điểm). Tuy nhiên, khóa không ngăn người chơi di chuyển hai quân cờ khác nhau đến cùng một vị trí trên bàn cờ hoặc có thể thực hiện một nước đi nào đó vi phạm luật chơi. Tùy thuộc vào loại quy tắc bạn đang thực thi, bạn có thể sử dụng ràng buộc duy nhất, nhưng nếu không bạn dễ bị tổn thương bởi write skew.

- Đăng ký tên người dùng

- Trên một trang web nơi mỗi người dùng có tên người dùng duy nhất, hai người dùng có thể cố gắng tạo tài khoản với cùng tên người dùng vào cùng lúc. Bạn có thể sử dụng giao dịch để kiểm tra xem tên đã được lấy và nếu chưa, tạo tài khoản với tên đó. Tuy nhiên, như trong các ví dụ trước, điều đó không an toàn dưới snapshot isolation. May mắn là ràng buộc duy nhất là giải pháp đơn giản ở đây (giao dịch thứ hai cố gắng đăng ký tên người dùng sẽ bị hủy vì vi phạm ràng buộc).

- Ngăn chặn chi tiêu kép

- Một dịch vụ cho phép người dùng chi tiền hoặc điểm cần kiểm tra rằng người dùng không chi tiêu nhiều hơn số họ có. Bạn có thể cài đặt điều này bằng cách chèn một khoản chi tiêu tạm thời vào tài khoản người dùng, liệt kê tất cả các khoản trong tài khoản, và kiểm tra rằng tổng là dương. Với write skew, có thể xảy ra trường hợp hai khoản chi tiêu được chèn đồng thời mà cùng nhau khiến số dư âm, nhưng cả hai giao dịch đều không nhận ra giao dịch kia.

Phantom gây ra write skew

Tất cả các ví dụ này đều theo một mẫu tương tự:

Một truy vấn

SELECTkiểm tra xem một yêu cầu nào đó có được thỏa mãn hay không bằng cách tìm kiếm các hàng phù hợp với điều kiện tìm kiếm nào đó (có ít nhất hai bác sĩ trực, không có lần đặt chỗ nào hiện có cho phòng đó vào thời điểm đó, vị trí trên bàn cờ chưa có quân cờ khác, tên người dùng chưa được lấy, vẫn còn tiền trong tài khoản).Tùy thuộc vào kết quả của truy vấn đầu tiên, code ứng dụng quyết định cách tiếp tục (có thể tiến hành với thao tác, hoặc báo lỗi cho người dùng và hủy bỏ).

Nếu ứng dụng quyết định tiến hành, nó thực hiện một lần ghi (

INSERT,UPDATE, hoặcDELETE) vào cơ sở dữ liệu và commit giao dịch.Tác dụng của lần ghi này thay đổi điều kiện tiên quyết của quyết định ở bước 2. Nói cách khác, nếu bạn lặp lại truy vấn

SELECTtừ bước 1 sau khi commit lần ghi, bạn sẽ nhận được kết quả khác, vì lần ghi đã thay đổi tập hợp các hàng khớp với điều kiện tìm kiếm (bây giờ có một bác sĩ trực ít hơn, phòng họp hiện đã được đặt chỗ cho thời điểm đó, vị trí trên bàn cờ hiện đã bị chiếm bởi quân cờ đã được di chuyển, tên người dùng hiện đã bị lấy, hiện có ít tiền hơn trong tài khoản).

Các bước có thể xảy ra theo thứ tự khác nhau. Ví dụ, bạn có thể trước tiên thực hiện lần ghi, sau đó

truy vấn SELECT, và cuối cùng quyết định có hủy bỏ hay commit dựa trên kết quả của truy vấn.

Trong trường hợp ví dụ bác sĩ trực, hàng được sửa đổi ở bước 3 là một trong các hàng

được trả về ở bước 1, vì vậy chúng ta có thể làm cho giao dịch an toàn và tránh write skew bằng cách khóa các hàng

ở bước 1 (SELECT FOR UPDATE). Tuy nhiên, bốn ví dụ còn lại khác: chúng kiểm tra sự

vắng mặt của các hàng khớp với điều kiện tìm kiếm nào đó, và lần ghi thêm một hàng khớp với cùng

điều kiện. Nếu truy vấn ở bước 1 không trả về bất kỳ hàng nào, SELECT FOR UPDATE không thể gắn khóa vào

bất cứ thứ gì 56.

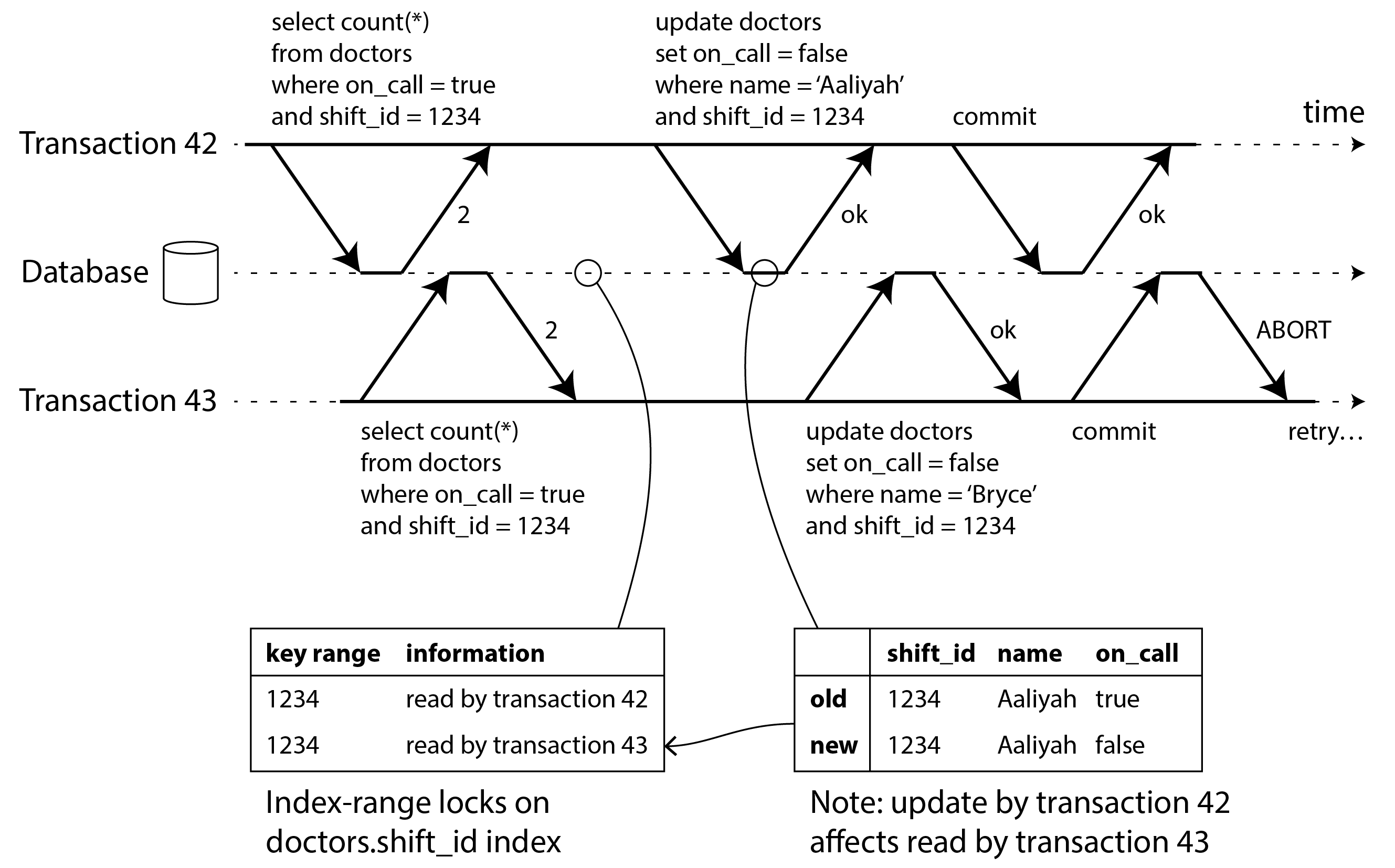

Hiệu ứng này, khi một lần ghi trong một giao dịch thay đổi kết quả của một truy vấn tìm kiếm trong giao dịch khác, được gọi là phantom (bóng ma) 4. Snapshot isolation tránh phantom trong các truy vấn chỉ đọc, nhưng trong các giao dịch đọc-ghi như các ví dụ chúng ta đã thảo luận, phantom có thể dẫn đến các trường hợp đặc biệt phức tạp của write skew. SQL được tạo ra bởi ORM cũng dễ bị write skew 50 51.

Vật chất hóa xung đột (Materializing conflicts)

Nếu vấn đề của phantom là không có đối tượng nào để chúng ta có thể gắn khóa vào, có lẽ chúng ta có thể giả tạo giới thiệu một đối tượng khóa vào cơ sở dữ liệu?

Ví dụ, trong trường hợp đặt phòng họp, bạn có thể tưởng tượng tạo một bảng các khe thời gian và phòng. Mỗi hàng trong bảng này tương ứng với một phòng cụ thể cho một khoảng thời gian cụ thể (giả sử 15 phút). Bạn tạo các hàng cho tất cả các kết hợp phòng và khoảng thời gian có thể trước, ví dụ cho sáu tháng tới.

Bây giờ một giao dịch muốn tạo một lần đặt chỗ có thể khóa (SELECT FOR UPDATE) các hàng trong

bảng tương ứng với phòng và khoảng thời gian mong muốn. Sau khi có được khóa, nó có thể

kiểm tra các lần đặt chỗ chồng lấp và chèn một lần đặt chỗ mới như trước. Lưu ý rằng bảng bổ sung

không được sử dụng để lưu trữ thông tin về lần đặt chỗ, mà hoàn toàn là một tập hợp khóa được dùng

để ngăn chặn các lần đặt chỗ trên cùng phòng và khoảng thời gian được sửa đổi đồng thời.

Cách tiếp cận này được gọi là materializing conflicts (vật chất hóa xung đột), vì nó lấy một phantom và biến nó thành một xung đột khóa trên một tập hợp hàng cụ thể tồn tại trong cơ sở dữ liệu 14. Đáng tiếc là có thể khó và dễ xảy ra lỗi khi tìm ra cách vật chất hóa xung đột, và thật xấu khi để cơ chế kiểm soát đồng thời lộ ra trong mô hình dữ liệu ứng dụng. Vì những lý do đó, materializing conflicts nên được coi là phương án cuối cùng khi không có lựa chọn nào khác. Mức cô lập serializable thì được ưa thích hơn nhiều trong hầu hết các trường hợp.

Serializability (Khả năng tuần tự hóa)

Trong chương này chúng ta đã thấy một số ví dụ về các giao dịch dễ bị race condition. Một số race condition được ngăn chặn bởi các mức cô lập read committed và snapshot isolation, nhưng các race condition khác thì không. Chúng ta đã gặp một số ví dụ đặc biệt phức tạp với write skew và phantom. Đây là tình huống đáng buồn:

- Các mức cô lập khó hiểu và được cài đặt không nhất quán trong các cơ sở dữ liệu khác nhau (ví dụ, ý nghĩa của “repeatable read” thay đổi đáng kể).

- Nếu bạn xem xét code ứng dụng của mình, thật khó để biết liệu nó có an toàn khi chạy ở một mức cô lập cụ thể hay không, đặc biệt là trong một ứng dụng lớn, nơi bạn có thể không biết tất cả những gì đang xảy ra đồng thời.

- Không có công cụ tốt nào giúp chúng ta phát hiện race condition. Về nguyên tắc, phân tích tĩnh có thể hữu ích 33, nhưng các kỹ thuật nghiên cứu vẫn chưa tìm được ứng dụng thực tiễn. Kiểm thử các vấn đề đồng thời rất khó, vì chúng là thường không mang tính xác định, các vấn đề chỉ xảy ra nếu bạn gặp đúng lúc không may.

Đây không phải vấn đề mới, nó đã tồn tại từ những năm 1970 khi các mức cô lập yếu lần đầu được giới thiệu 3. Suốt thời gian đó, câu trả lời từ các nhà nghiên cứu luôn đơn giản: hãy dùng cô lập serializable (tuần tự hóa)!

Cô lập serializable là mức cô lập mạnh nhất. Nó đảm bảo rằng dù các giao dịch có thể thực thi song song, kết quả cuối cùng vẫn giống như khi chúng thực thi lần lượt từng cái một, theo thứ tự tuần tự, không có bất kỳ sự đồng thời nào. Như vậy, cơ sở dữ liệu đảm bảo rằng nếu các giao dịch hoạt động đúng khi chạy riêng lẻ, chúng vẫn tiếp tục đúng khi chạy đồng thời, nói cách khác, cơ sở dữ liệu ngăn chặn tất cả các race condition (điều kiện tranh chấp) có thể xảy ra.

Nhưng nếu cô lập serializable tốt hơn nhiều so với mớ hỗn độn của các mức cô lập yếu, tại sao không phải ai cũng dùng nó? Để trả lời câu hỏi này, chúng ta cần xem xét các phương án triển khai serializability và hiệu năng của chúng. Hầu hết các cơ sở dữ liệu cung cấp serializability ngày nay dùng một trong ba kỹ thuật, mà chúng ta sẽ khám phá trong phần còn lại của chương này:

- Thực thi các giao dịch theo thứ tự tuần tự thực sự (xem “Actual Serial Execution”)

- Two-phase locking (khóa hai pha) (xem “Two-Phase Locking (2PL)”), vốn là lựa chọn khả thi duy nhất trong nhiều thập kỷ

- Các kỹ thuật kiểm soát đồng thời lạc quan như serializable snapshot isolation (xem “Serializable Snapshot Isolation (SSI)”)

Actual Serial Execution

Cách đơn giản nhất để tránh các vấn đề đồng thời là loại bỏ hoàn toàn sự đồng thời: chỉ thực thi một giao dịch tại một thời điểm, theo thứ tự tuần tự, trên một luồng đơn. Bằng cách đó, chúng ta hoàn toàn né tránh vấn đề phát hiện và ngăn chặn xung đột giữa các giao dịch: mức cô lập thu được theo định nghĩa là serializable.

Dù ý tưởng này có vẻ hiển nhiên, mãi đến những năm 2000 các nhà thiết kế cơ sở dữ liệu mới quyết định rằng một vòng lặp đơn luồng để thực thi giao dịch là khả thi 57. Nếu đồng thời đa luồng được xem là thiết yếu để đạt hiệu năng tốt trong suốt 30 năm trước đó, thì điều gì đã thay đổi để thực thi đơn luồng trở nên khả thi?

Hai bước phát triển đã tạo ra sự thay đổi tư duy này:

- RAM trở nên đủ rẻ để trong nhiều trường hợp sử dụng, toàn bộ tập dữ liệu đang hoạt động có thể được lưu trong bộ nhớ (xem “Keeping everything in memory”). Khi tất cả dữ liệu mà một giao dịch cần truy cập đều có trong bộ nhớ, giao dịch có thể thực thi nhanh hơn nhiều so với khi phải chờ dữ liệu được nạp từ đĩa.

- Các nhà thiết kế cơ sở dữ liệu nhận ra rằng các giao dịch OLTP thường ngắn và chỉ thực hiện một số lượng nhỏ các thao tác đọc và ghi (xem “Analytical versus Operational Systems”). Ngược lại, các truy vấn phân tích chạy dài thường chỉ đọc, do đó chúng có thể chạy trên một snapshot nhất quán (dùng snapshot isolation) bên ngoài vòng lặp thực thi tuần tự.

Phương pháp thực thi giao dịch tuần tự được triển khai trong VoltDB/H-Store, Redis và Datomic, chẳng hạn 58 59 60. Một hệ thống được thiết kế cho thực thi đơn luồng đôi khi có thể hoạt động tốt hơn hệ thống hỗ trợ đồng thời, vì nó tránh được chi phí điều phối của việc khóa. Tuy nhiên, thông lượng của nó bị giới hạn ở tốc độ của một lõi CPU duy nhất. Để tận dụng tối đa luồng đơn đó, các giao dịch cần được cấu trúc khác với dạng truyền thống.

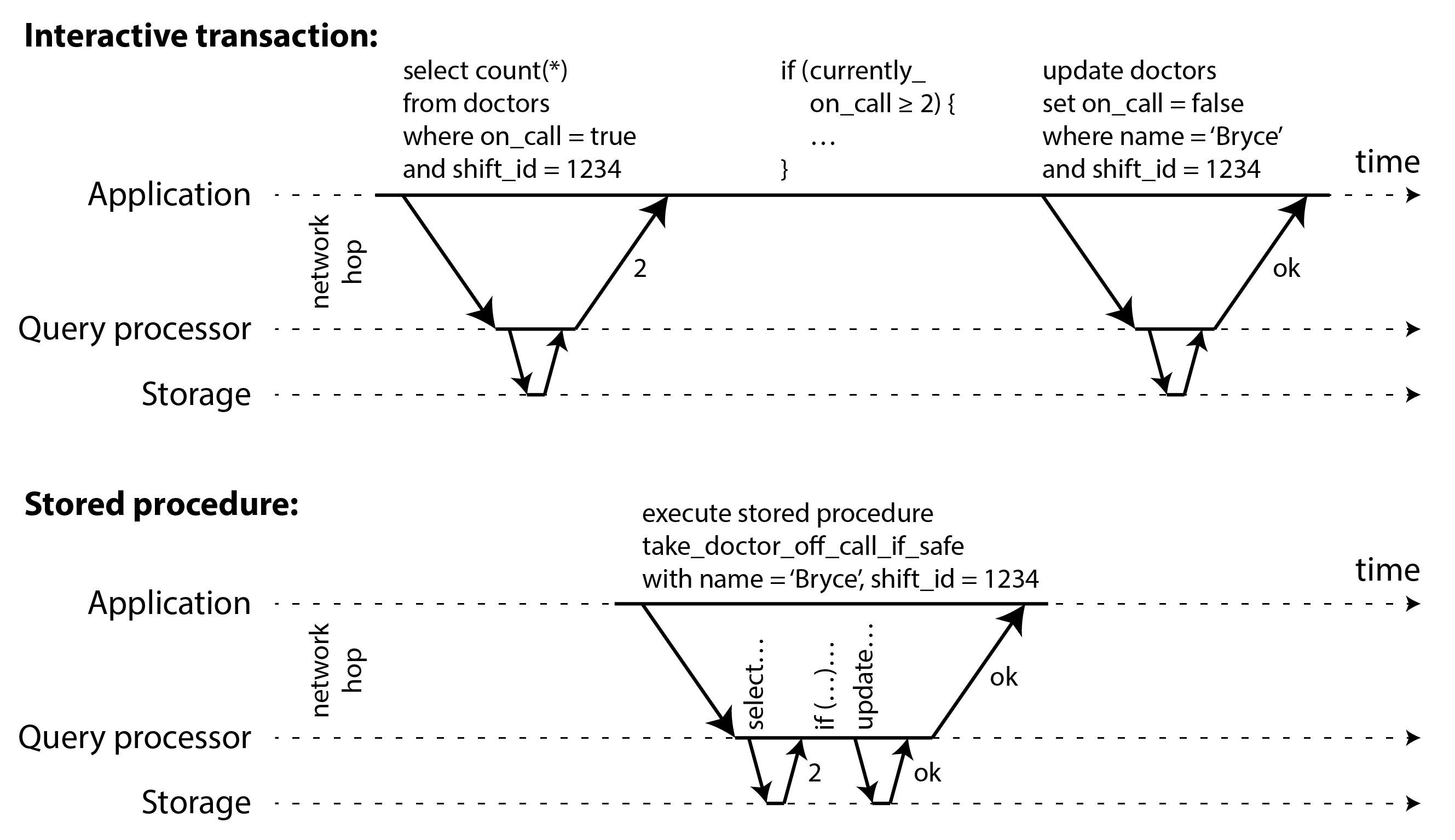

Đóng gói giao dịch trong stored procedure

Trong những ngày đầu của cơ sở dữ liệu, ý định là một giao dịch cơ sở dữ liệu có thể bao gồm toàn bộ luồng hoạt động của người dùng. Ví dụ, đặt vé máy bay là một quy trình nhiều bước (tìm kiếm tuyến đường, giá vé và chỗ trống; quyết định hành trình; đặt chỗ trên từng chuyến bay của hành trình; nhập thông tin hành khách; thanh toán). Các nhà thiết kế cơ sở dữ liệu cho rằng sẽ gọn gàng nếu toàn bộ quy trình đó là một giao dịch để có thể được commit một cách atomic.