12. Stream Processing

Một hệ thống phức tạp hoạt động được thì hầu như đều được phát triển từ một hệ thống đơn giản đã hoạt động. Mệnh đề ngược lại dường như cũng đúng: Một hệ thống phức tạp được thiết kế từ đầu thì không bao giờ hoạt động được và cũng không thể khiến nó hoạt động được.

John Gall, Systemantics (1975)

A NOTE FOR EARLY RELEASE READERS

With Early Release ebooks, you get books in their earliest form—the author’s raw and unedited content as they write—so you can take advantage of these technologies long before the official release of these titles.

This will be the 12th chapter of the final book. The GitHub repo for this book is https://github.com/ept/ddia2-feedback.

If you’d like to be actively involved in reviewing and commenting on this draft, please reach out on GitHub.

Trong Chương 11 chúng ta đã thảo luận về xử lý theo lô (batch processing), tức là các kỹ thuật đọc một tập hợp tệp đầu vào và tạo ra một tập hợp tệp đầu ra mới. Đầu ra là một dạng dữ liệu dẫn xuất (derived data): đó là tập dữ liệu có thể được tạo lại bằng cách chạy lại quá trình batch nếu cần. Chúng ta đã thấy cách ý tưởng đơn giản nhưng mạnh mẽ này có thể được dùng để tạo chỉ mục tìm kiếm, hệ thống gợi ý, phân tích dữ liệu và nhiều thứ khác.

Tuy nhiên, trong suốt Chương 11 có một giả định lớn vẫn còn tồn tại: đầu vào là hữu hạn (bounded), tức là có kích thước đã biết và cố định, nên quá trình batch biết khi nào nó đã đọc hết đầu vào. Ví dụ, phép sắp xếp vốn là trung tâm của MapReduce phải đọc toàn bộ đầu vào trước khi có thể bắt đầu tạo ra đầu ra: có thể bản ghi đầu vào cuối cùng lại chính là bản ghi có khóa nhỏ nhất, do đó phải là bản ghi đầu ra đầu tiên, vì vậy không thể xuất kết quả sớm hơn.

Trên thực tế, rất nhiều dữ liệu là vô hạn (unbounded) vì nó đến dần dần theo thời gian: người dùng của bạn tạo ra dữ liệu hôm qua và hôm nay, và họ sẽ tiếp tục tạo ra thêm dữ liệu vào ngày mai. Trừ khi doanh nghiệp của bạn đóng cửa, quá trình này không bao giờ kết thúc, và do đó tập dữ liệu không bao giờ “hoàn chỉnh” theo bất kỳ nghĩa nào có ý nghĩa 1. Vì vậy, các bộ xử lý batch phải nhân tạo chia dữ liệu thành các khối với thời lượng cố định: ví dụ, xử lý dữ liệu của một ngày vào cuối mỗi ngày, hoặc xử lý dữ liệu của một giờ vào cuối mỗi giờ.

Vấn đề với các quá trình batch chạy mỗi ngày là những thay đổi trong đầu vào chỉ được phản ánh trong đầu ra sau một ngày, điều này quá chậm đối với nhiều người dùng thiếu kiên nhẫn. Để giảm độ trễ, chúng ta có thể chạy xử lý thường xuyên hơn, chẳng hạn xử lý dữ liệu của một giây vào cuối mỗi giây, hoặc thậm chí liên tục, hoàn toàn bỏ qua các khoảng thời gian cố định và đơn giản là xử lý mọi sự kiện ngay khi nó xảy ra. Đó là ý tưởng đằng sau xử lý luồng (stream processing).

Nói chung, một “luồng” (stream) là dữ liệu được cung cấp tăng dần theo thời gian. Khái niệm này xuất hiện ở nhiều nơi: trong stdin và stdout của Unix, các ngôn ngữ lập trình (lazy lists, tức danh sách lười biếng) 2, API hệ thống tệp (chẳng hạn FileInputStream của Java), kết nối TCP, phát âm thanh và video qua internet, v.v.

Trong chương này chúng ta sẽ xem xét các luồng sự kiện (event streams) như một cơ chế quản lý dữ liệu: phiên bản vô hạn và được xử lý tăng dần tương ứng với dữ liệu batch mà chúng ta đã thấy trong chương trước. Đầu tiên chúng ta sẽ thảo luận về cách các luồng được biểu diễn, lưu trữ và truyền qua mạng. Trong “Cơ sở dữ liệu và Luồng” chúng ta sẽ tìm hiểu mối quan hệ giữa luồng và cơ sở dữ liệu. Cuối cùng, trong “Xử lý Luồng” chúng ta sẽ khám phá các phương pháp và công cụ để xử lý liên tục các luồng đó, cũng như cách chúng có thể được dùng để xây dựng ứng dụng.

Truyền Luồng Sự Kiện

Trong thế giới xử lý batch, đầu vào và đầu ra của một job là các tệp (có thể trên một hệ thống tệp phân tán). Phiên bản tương đương với streaming trông như thế nào?

Khi đầu vào là một tệp (một chuỗi byte), bước xử lý đầu tiên thường là phân tích cú pháp nó thành một chuỗi các bản ghi. Trong ngữ cảnh xử lý luồng, một bản ghi thường được gọi là một sự kiện (event), nhưng về bản chất là cùng một thứ: một đối tượng nhỏ, tự chứa, bất biến, chứa thông tin chi tiết về một điều gì đó đã xảy ra tại một thời điểm nào đó. Một sự kiện thường chứa một dấu thời gian cho biết nó đã xảy ra khi nào theo đồng hồ thực (xem “Monotonic Versus Time-of-Day Clocks”).

Ví dụ, điều đã xảy ra có thể là một hành động mà người dùng thực hiện, chẳng hạn xem một trang hoặc thực hiện một giao dịch mua. Nó cũng có thể xuất phát từ máy móc, chẳng hạn một phép đo định kỳ từ cảm biến nhiệt độ, hoặc một chỉ số sử dụng CPU. Trong ví dụ về “Batch Processing with Unix Tools”, mỗi dòng của log máy chủ web là một sự kiện.

Một sự kiện có thể được mã hóa dưới dạng chuỗi văn bản, hoặc JSON, hoặc có thể ở dạng nhị phân, như đã thảo luận trong Chương 5. Cách mã hóa này cho phép bạn lưu trữ một sự kiện, ví dụ bằng cách nối thêm nó vào một tệp, chèn vào một bảng quan hệ, hoặc ghi vào một cơ sở dữ liệu tài liệu. Nó cũng cho phép bạn gửi sự kiện qua mạng đến một nút khác để xử lý.

Trong xử lý batch, một tệp được ghi một lần và sau đó có thể được đọc bởi nhiều job. Tương tự, trong thuật ngữ streaming, một sự kiện được tạo ra một lần bởi một producer (còn gọi là publisher hoặc sender, tức nhà sản xuất), và sau đó có thể được xử lý bởi nhiều consumer (subscriber hoặc recipient, tức người tiêu dùng) 3. Trong hệ thống tệp, một tên tệp xác định một tập hợp các bản ghi liên quan; trong hệ thống streaming, các sự kiện liên quan thường được nhóm lại thành một topic (chủ đề) hoặc stream (luồng).

Về nguyên tắc, một tệp hoặc cơ sở dữ liệu là đủ để kết nối producer và consumer: một producer ghi mọi sự kiện nó tạo ra vào kho dữ liệu, và mỗi consumer định kỳ thăm dò kho dữ liệu để kiểm tra các sự kiện đã xuất hiện kể từ lần chạy trước. Đây về cơ bản là điều mà một quá trình batch làm khi nó xử lý dữ liệu của một ngày vào cuối mỗi ngày.

Tuy nhiên, khi chuyển sang xử lý liên tục với độ trễ thấp, việc thăm dò (polling) trở nên tốn kém nếu kho dữ liệu không được thiết kế cho loại sử dụng này. Bạn thăm dò càng thường xuyên, tỷ lệ phần trăm yêu cầu trả về sự kiện mới càng thấp, và do đó chi phí overhead càng cao. Thay vào đó, tốt hơn là để consumer được thông báo khi có sự kiện mới xuất hiện.

Theo truyền thống, cơ sở dữ liệu không hỗ trợ cơ chế thông báo loại này rất tốt: cơ sở dữ liệu quan hệ thường có trigger (trình kích hoạt), có thể phản ứng với một thay đổi (ví dụ, một hàng được chèn vào bảng), nhưng chúng rất hạn chế về những gì chúng có thể làm và đã phần nào là một tính năng phụ trong thiết kế cơ sở dữ liệu 4. Thay vào đó, các công cụ chuyên dụng đã được phát triển cho mục đích cung cấp thông báo sự kiện.

Hệ Thống Nhắn Tin

Một phương pháp phổ biến để thông báo cho consumer về các sự kiện mới là sử dụng hệ thống nhắn tin (messaging system): một producer gửi một tin nhắn chứa sự kiện, sau đó được đẩy đến các consumer. Chúng ta đã đề cập đến các hệ thống này trước đây trong “Event-Driven Architectures”, nhưng bây giờ chúng ta sẽ đi sâu hơn vào chi tiết.

Một kênh truyền thông trực tiếp như Unix pipe hoặc kết nối TCP giữa producer và consumer sẽ là một cách đơn giản để triển khai hệ thống nhắn tin. Tuy nhiên, hầu hết các hệ thống nhắn tin mở rộng trên mô hình cơ bản này. Đặc biệt, Unix pipe và TCP kết nối chính xác một người gửi với một người nhận, trong khi một hệ thống nhắn tin cho phép nhiều nút producer gửi tin nhắn đến cùng một topic và cho phép nhiều nút consumer nhận tin nhắn trong một topic.

Trong mô hình publish/subscribe này, các hệ thống khác nhau áp dụng nhiều cách tiếp cận khác nhau, và không có một câu trả lời đúng duy nhất cho mọi mục đích. Để phân biệt các hệ thống, đặc biệt hữu ích khi đặt ra hai câu hỏi sau:

Điều gì xảy ra nếu producer gửi tin nhắn nhanh hơn consumer có thể xử lý? Nói chung, có ba tùy chọn: hệ thống có thể loại bỏ tin nhắn, lưu đệm tin nhắn trong một hàng đợi, hoặc áp dụng backpressure (áp lực ngược, còn gọi là flow control, kiểm soát luồng; tức là chặn producer không gửi thêm tin nhắn). Ví dụ, Unix pipe và TCP sử dụng backpressure: chúng có một bộ đệm nhỏ có kích thước cố định, và nếu đầy, người gửi bị chặn cho đến khi người nhận lấy dữ liệu ra khỏi bộ đệm (xem “Network congestion and queueing”).

Nếu tin nhắn được đệm trong một hàng đợi, điều quan trọng là phải hiểu điều gì xảy ra khi hàng đợi đó phát triển. Hệ thống có bị sập nếu hàng đợi không còn vừa trong bộ nhớ, hay nó ghi tin nhắn ra đĩa? Trong trường hợp sau, việc truy cập đĩa ảnh hưởng đến hiệu năng của hệ thống nhắn tin như thế nào 5, và điều gì xảy ra khi đĩa đầy 6?

Điều gì xảy ra nếu các nút bị sập hoặc tạm thời ngoại tuyến, có tin nhắn nào bị mất không? Như với cơ sở dữ liệu, tính bền vững (durability) có thể yêu cầu một số kết hợp giữa ghi ra đĩa và/hoặc sao chép (xem thanh bên “Replication and Durability”), điều này có chi phí nhất định. Nếu bạn có thể chấp nhận đôi khi mất tin nhắn, bạn có thể đạt được thông lượng cao hơn và độ trễ thấp hơn trên cùng phần cứng.

Việc mất tin nhắn có chấp nhận được hay không phụ thuộc rất nhiều vào ứng dụng. Ví dụ, với các số đo cảm biến và chỉ số được truyền định kỳ, một điểm dữ liệu bị thiếu đôi khi có thể không quan trọng, vì một giá trị cập nhật sẽ được gửi sau một thời gian ngắn nữa. Tuy nhiên, hãy cẩn thận rằng nếu một số lượng lớn tin nhắn bị loại bỏ, có thể không rõ ràng ngay lập tức rằng các chỉ số là không chính xác 7. Nếu bạn đang đếm các sự kiện, điều quan trọng hơn là chúng được cung cấp đáng tin cậy, vì mỗi tin nhắn bị mất đồng nghĩa với bộ đếm không chính xác.

Một tính chất tốt của các hệ thống xử lý batch mà chúng ta đã khám phá trong Chương 11 là chúng cung cấp đảm bảo độ tin cậy mạnh: các tác vụ thất bại được tự động thử lại, và đầu ra một phần từ các tác vụ thất bại tự động bị loại bỏ. Điều này có nghĩa là đầu ra giống như thể không có lỗi nào xảy ra, điều này giúp đơn giản hóa mô hình lập trình. Ở phần sau của chương này chúng ta sẽ xem xét cách chúng ta có thể cung cấp các đảm bảo tương tự trong ngữ cảnh streaming.

Nhắn tin trực tiếp từ producer đến consumer

Một số hệ thống nhắn tin sử dụng giao tiếp mạng trực tiếp giữa producer và consumer mà không đi qua các nút trung gian:

UDP multicast được sử dụng rộng rãi trong ngành tài chính cho các luồng như feed thị trường chứng khoán, nơi độ trễ thấp là quan trọng 8. Mặc dù bản thân UDP là không đáng tin cậy, các giao thức ở tầng ứng dụng có thể khôi phục các gói tin bị mất (producer phải nhớ các gói tin nó đã gửi để có thể truyền lại chúng theo yêu cầu).

Các thư viện nhắn tin không có broker như ZeroMQ và nanomsg có cách tiếp cận tương tự, triển khai nhắn tin publish/subscribe qua TCP hoặc IP multicast.

Một số agent thu thập chỉ số, chẳng hạn StatsD 9 sử dụng nhắn tin UDP không đáng tin cậy để thu thập chỉ số từ tất cả các máy trên mạng và giám sát chúng. (Trong giao thức StatsD, các chỉ số bộ đếm chỉ chính xác nếu tất cả tin nhắn đều được nhận; sử dụng UDP làm cho các chỉ số tốt nhất là gần đúng 10. Xem thêm “TCP Versus UDP”.)

Nếu consumer cung cấp một dịch vụ trên mạng, producer có thể thực hiện yêu cầu HTTP hoặc RPC trực tiếp (xem “Dataflow Through Services: REST and RPC”) để đẩy tin nhắn đến consumer. Đây là ý tưởng đằng sau webhook 11, một mẫu trong đó URL callback của một dịch vụ được đăng ký với dịch vụ khác, và dịch vụ đó gửi yêu cầu đến URL đó bất cứ khi nào có sự kiện xảy ra.

Mặc dù các hệ thống nhắn tin trực tiếp này hoạt động tốt trong các tình huống mà chúng được thiết kế, chúng nói chung yêu cầu mã ứng dụng phải nhận thức về khả năng mất tin nhắn. Các lỗi mà chúng có thể chịu đựng khá hạn chế: ngay cả khi các giao thức phát hiện và truyền lại các gói tin bị mất trong mạng, chúng nói chung giả định rằng producer và consumer luôn trực tuyến.

Nếu một consumer ngoại tuyến, nó có thể bỏ lỡ các tin nhắn được gửi trong khi nó không thể truy cập. Một số giao thức cho phép producer thử lại việc giao tin nhắn thất bại, nhưng cách tiếp cận này có thể thất bại nếu producer bị sập, mất bộ đệm các tin nhắn mà nó được cho là phải thử lại.

Message broker

Một lựa chọn thay thế được sử dụng rộng rãi là gửi tin nhắn qua một message broker (còn gọi là message queue, hàng đợi tin nhắn), về cơ bản là một loại cơ sở dữ liệu được tối ưu hóa để xử lý các luồng tin nhắn 12. Nó chạy như một máy chủ, với producer và consumer kết nối đến nó như các client. Producer ghi tin nhắn vào broker, và consumer nhận chúng bằng cách đọc từ broker.

Bằng cách tập trung hóa dữ liệu trong broker, các hệ thống này có thể dễ dàng chịu đựng các client đến và đi (kết nối, ngắt kết nối và bị sập), và câu hỏi về tính bền vững được chuyển sang broker. Một số message broker chỉ giữ tin nhắn trong bộ nhớ, trong khi các broker khác (tùy thuộc vào cấu hình) ghi chúng ra đĩa để chúng không bị mất trong trường hợp broker bị sập. Khi gặp consumer chậm, chúng nói chung cho phép xếp hàng không giới hạn (trái ngược với việc loại bỏ tin nhắn hoặc backpressure), mặc dù lựa chọn này cũng có thể phụ thuộc vào cấu hình.

Một hệ quả của việc xếp hàng là consumer nói chung là bất đồng bộ (asynchronous): khi producer gửi một tin nhắn, nó thường chỉ chờ broker xác nhận rằng nó đã lưu đệm tin nhắn và không chờ tin nhắn được xử lý bởi consumer. Việc giao tin nhắn cho consumer sẽ xảy ra tại một thời điểm không xác định trong tương lai, thường trong một phần nhỏ của giây, nhưng đôi khi lâu hơn đáng kể nếu có tồn đọng trong hàng đợi.

So sánh message broker và cơ sở dữ liệu

Một số message broker thậm chí có thể tham gia vào các giao thức two-phase commit sử dụng XA hoặc JTA (xem “Distributed Transactions Across Different Systems”). Tính năng này làm cho chúng khá giống với cơ sở dữ liệu về bản chất, mặc dù vẫn có những sự khác biệt thực tế quan trọng giữa message broker và cơ sở dữ liệu:

Cơ sở dữ liệu thường giữ dữ liệu cho đến khi nó được xóa một cách rõ ràng, trong khi một số message broker tự động xóa một tin nhắn khi nó đã được giao thành công đến consumer. Các message broker như vậy không phù hợp cho lưu trữ dữ liệu lâu dài.

Vì chúng nhanh chóng xóa tin nhắn, hầu hết message broker giả định rằng tập làm việc của chúng khá nhỏ, tức là các hàng đợi ngắn. Nếu broker cần đệm nhiều tin nhắn vì consumer chậm (có thể tràn tin nhắn ra đĩa nếu chúng không còn vừa trong bộ nhớ), mỗi tin nhắn riêng lẻ mất nhiều thời gian hơn để xử lý, và thông lượng tổng thể có thể giảm sút 5.

Cơ sở dữ liệu thường hỗ trợ chỉ mục thứ cấp và nhiều cách tìm kiếm dữ liệu bằng ngôn ngữ truy vấn, trong khi message broker thường hỗ trợ một số cách đăng ký một tập hợp con các topic phù hợp với một mẫu nào đó. Cả hai đều là cách để client chọn phần dữ liệu mà nó muốn biết, nhưng cơ sở dữ liệu thường cung cấp chức năng truy vấn nâng cao hơn nhiều.

Khi truy vấn một cơ sở dữ liệu, kết quả thường dựa trên một ảnh chụp (snapshot) tại một thời điểm của dữ liệu; nếu một client khác sau đó ghi gì đó vào cơ sở dữ liệu làm thay đổi kết quả truy vấn, client đầu tiên không biết rằng kết quả trước đó của nó hiện đã lỗi thời (trừ khi nó lặp lại truy vấn, hoặc thăm dò các thay đổi). Ngược lại, message broker không hỗ trợ các truy vấn tùy ý và không cho phép cập nhật tin nhắn sau khi chúng được gửi, nhưng chúng thông báo cho client khi dữ liệu thay đổi (tức là khi có tin nhắn mới).

Đây là quan điểm truyền thống về message broker, được đóng gói trong các tiêu chuẩn như JMS 13 và AMQP 14 và được triển khai trong phần mềm như RabbitMQ, ActiveMQ, HornetQ, Qpid, TIBCO Enterprise Message Service, IBM MQ, Azure Service Bus, và Google Cloud Pub/Sub 15. Mặc dù có thể sử dụng cơ sở dữ liệu như hàng đợi, việc tinh chỉnh chúng để có hiệu năng tốt không đơn giản 16.

Nhiều consumer

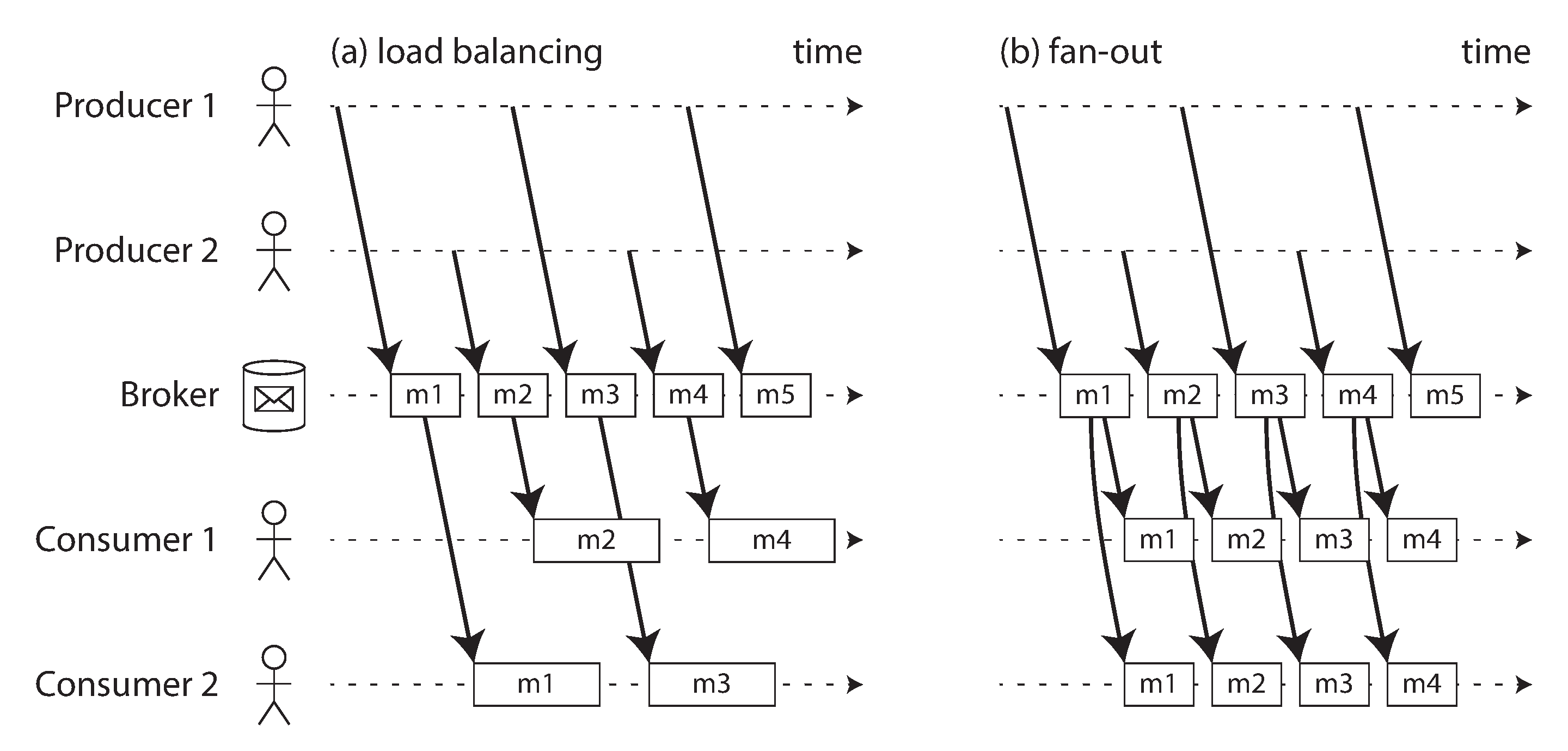

Khi nhiều consumer đọc tin nhắn trong cùng một topic, hai mẫu chính của nhắn tin được sử dụng, như minh họa trong Hình 12-1:

- Cân bằng tải (Load balancing)

Mỗi tin nhắn được giao đến một trong số các consumer, vì vậy các consumer có thể chia sẻ công việc xử lý tin nhắn trong topic. Broker có thể phân công tin nhắn cho các consumer một cách tùy ý. Mẫu này hữu ích khi các tin nhắn tốn kém để xử lý, và do đó bạn muốn có thể thêm consumer để song song hóa việc xử lý. (Trong AMQP, bạn có thể triển khai cân bằng tải bằng cách có nhiều client tiêu thụ từ cùng một hàng đợi, và trong JMS nó được gọi là shared subscription, đăng ký chia sẻ.)

- Fan-out (Phát rộng)

Mỗi tin nhắn được giao đến tất cả các consumer. Fan-out cho phép nhiều consumer độc lập cùng “theo dõi” cùng một luồng phát sóng tin nhắn mà không ảnh hưởng đến nhau, tương đương với streaming của việc có nhiều job batch khác nhau đọc cùng một tệp đầu vào. (Tính năng này được cung cấp bởi topic subscription trong JMS, và exchange binding trong AMQP.)

Hai mẫu có thể được kết hợp, ví dụ sử dụng tính năng consumer groups (nhóm consumer) của Kafka. Khi một consumer group đăng ký một topic, mỗi tin nhắn trong topic được gửi đến một trong các consumer trong nhóm (cân bằng tải giữa các consumer trong nhóm). Nếu hai consumer group riêng biệt đăng ký cùng một topic, mỗi tin nhắn được gửi đến một consumer trong mỗi nhóm (cung cấp fan-out giữa các consumer group).

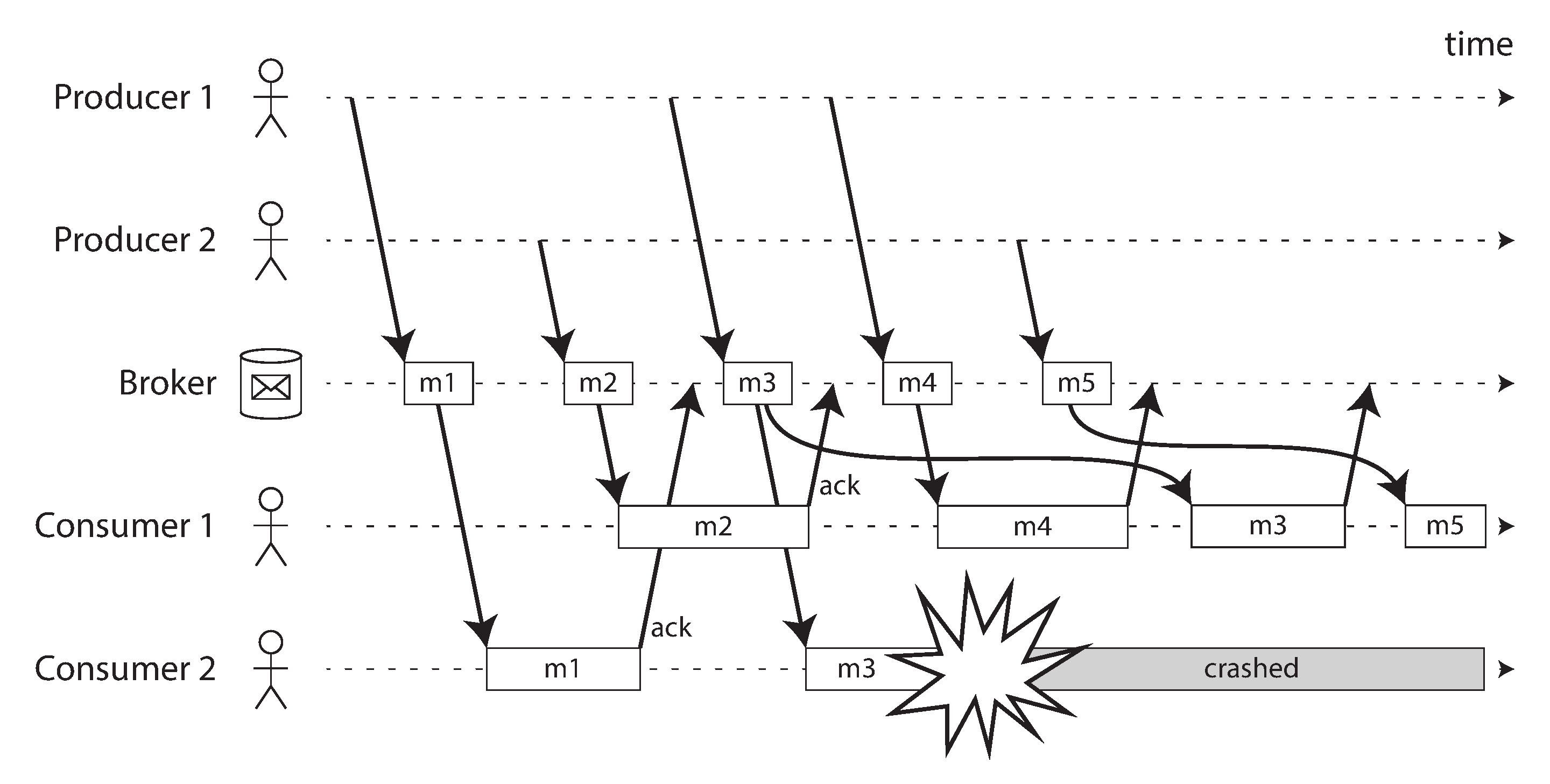

Acknowledgment và tái giao tin nhắn

Consumer có thể bị sập bất cứ lúc nào, vì vậy có thể xảy ra trường hợp broker giao một tin nhắn đến consumer nhưng consumer không bao giờ xử lý nó, hoặc chỉ xử lý một phần trước khi bị sập. Để đảm bảo rằng tin nhắn không bị mất, message broker sử dụng acknowledgment (xác nhận): client phải thông báo rõ ràng cho broker khi nó đã hoàn thành xử lý một tin nhắn để broker có thể xóa nó khỏi hàng đợi.

Nếu kết nối đến một client bị đóng hoặc hết thời gian chờ mà không có broker nhận được acknowledgment, broker giả định rằng tin nhắn chưa được xử lý, và do đó nó giao tin nhắn một lần nữa cho một consumer khác. (Lưu ý rằng có thể xảy ra trường hợp tin nhắn thực sự đã được xử lý đầy đủ, nhưng acknowledgment bị mất trong mạng. Xử lý trường hợp này yêu cầu giao thức atomic commit, như đã thảo luận trong “Exactly-once message processing”, trừ khi thao tác là idempotent hoặc ngữ nghĩa exactly-once không được yêu cầu.)

Khi kết hợp với cân bằng tải, hành vi tái giao tin nhắn này có một hiệu ứng thú vị đối với thứ tự tin nhắn. Trong Hình 12-2, các consumer nói chung xử lý tin nhắn theo thứ tự chúng được producer gửi. Tuy nhiên, consumer 2 bị sập trong khi xử lý tin nhắn m3, cùng lúc consumer 1 đang xử lý tin nhắn m4. Tin nhắn m3 chưa được xác nhận sau đó được tái giao cho consumer 1, với kết quả là consumer 1 xử lý các tin nhắn theo thứ tự m4, m3, m5. Vì vậy, m3 và m4 không được giao theo thứ tự như khi chúng được producer 1 gửi.

Ngay cả khi message broker cố gắng bảo toàn thứ tự tin nhắn (theo yêu cầu của cả tiêu chuẩn JMS và AMQP), sự kết hợp của cân bằng tải với tái giao tin nhắn chắc chắn dẫn đến việc tin nhắn bị sắp xếp lại. Để tránh vấn đề này, bạn có thể sử dụng một hàng đợi riêng biệt cho mỗi consumer (tức là không sử dụng tính năng cân bằng tải). Việc sắp xếp lại tin nhắn không phải là vấn đề nếu các tin nhắn hoàn toàn độc lập với nhau, nhưng có thể quan trọng nếu có các phụ thuộc nhân quả giữa các tin nhắn, như chúng ta sẽ thấy ở phần sau của chương.

Tái giao tin nhắn cũng có thể dẫn đến lãng phí tài nguyên, cạn kiệt tài nguyên, hoặc tắc nghẽn vĩnh viễn trong một luồng. Một kịch bản phổ biến là producer serialize một tin nhắn không đúng cách; ví dụ, bỏ qua một khóa bắt buộc trong đối tượng được mã hóa JSON. Bất kỳ consumer nào đọc tin nhắn sẽ kỳ vọng có khóa đó, và thất bại nếu thiếu nó. Không có acknowledgment nào được gửi, vì vậy broker sẽ gửi lại tin nhắn, điều này sẽ khiến một consumer khác thất bại. Vòng lặp này lặp lại vô thời hạn. Nếu broker đảm bảo thứ tự mạnh, không thể tiến thêm. Các broker cho phép sắp xếp lại tin nhắn có thể tiếp tục tiến triển, nhưng sẽ lãng phí tài nguyên vào các tin nhắn sẽ không bao giờ được xác nhận.

Dead letter queue (DLQ, hàng đợi thư chết) được sử dụng để xử lý vấn đề này. Thay vì giữ tin nhắn trong hàng đợi hiện tại và thử lại mãi mãi, tin nhắn được chuyển sang một hàng đợi khác để bỏ chặn consumer 17, 18. Việc giám sát thường được thiết lập trên dead letter queue, bất kỳ tin nhắn nào trong hàng đợi đều là lỗi. Khi một tin nhắn mới được phát hiện, người vận hành có thể quyết định xóa vĩnh viễn nó, chỉnh sửa thủ công và tái sản xuất tin nhắn, hoặc sửa mã consumer để xử lý tin nhắn một cách phù hợp. DLQ phổ biến trong hầu hết các hệ thống xếp hàng, nhưng các hệ thống nhắn tin dựa trên log như Apache Pulsar và các hệ thống xử lý luồng như Kafka Streams hiện cũng hỗ trợ chúng 19.

Message Broker Dựa Trên Log

Gửi một gói tin qua mạng hoặc thực hiện yêu cầu đến một dịch vụ mạng thường là một thao tác tạm thời không để lại dấu vết vĩnh cửu. Mặc dù có thể ghi lại nó vĩnh viễn (bằng cách chụp gói tin và ghi log), chúng ta thường không nghĩ theo cách đó. Các message broker theo phong cách AMQP/JMS kế thừa tư duy nhắn tin tạm thời này: mặc dù chúng có thể ghi tin nhắn ra đĩa, chúng nhanh chóng xóa tin nhắn sau khi chúng đã được giao đến consumer.

Cơ sở dữ liệu và hệ thống tệp có cách tiếp cận ngược lại: mọi thứ được ghi vào cơ sở dữ liệu hoặc tệp thường được kỳ vọng là được ghi lại vĩnh viễn, ít nhất là cho đến khi ai đó chọn rõ ràng để xóa nó.

Sự khác biệt trong tư duy này có ảnh hưởng lớn đến cách tạo ra dữ liệu dẫn xuất. Một tính năng quan trọng của các quá trình batch, như đã thảo luận trong Chương 11, là bạn có thể chạy chúng nhiều lần, thử nghiệm các bước xử lý, mà không có nguy cơ làm hỏng đầu vào (vì đầu vào là chỉ đọc). Điều này không đúng với nhắn tin theo phong cách AMQP/JMS: nhận một tin nhắn là mang tính hủy hoại nếu acknowledgment khiến nó bị xóa khỏi broker, vì vậy bạn không thể chạy lại cùng một consumer và kỳ vọng nhận được cùng kết quả.

Nếu bạn thêm một consumer mới vào hệ thống nhắn tin, nó thường chỉ bắt đầu nhận các tin nhắn được gửi sau khi nó được đăng ký; bất kỳ tin nhắn nào trước đó đều đã biến mất và không thể khôi phục. Hãy so sánh điều này với tệp và cơ sở dữ liệu, nơi bạn có thể thêm một client mới bất cứ lúc nào, và nó có thể đọc dữ liệu được ghi từ rất lâu trong quá khứ (miễn là nó chưa bị ghi đè hoặc xóa rõ ràng bởi ứng dụng).

Tại sao chúng ta không thể có một phiên bản kết hợp, kết hợp cách tiếp cận lưu trữ bền vững của cơ sở dữ liệu với cơ sở hạ tầng thông báo độ trễ thấp của nhắn tin? Đó là ý tưởng đằng sau message broker dựa trên log (log-based message broker), đã trở nên rất phổ biến trong những năm gần đây.

Sử dụng log để lưu trữ tin nhắn

Một log đơn giản là một chuỗi bản ghi chỉ nối thêm (append-only) trên đĩa. Chúng ta đã thảo luận về log trong ngữ cảnh của các engine lưu trữ có cấu trúc log và write-ahead log trong Chương 4, trong ngữ cảnh của sao chép trong Chương 6, và như một hình thức đồng thuận trong Chương 10.

Cùng một cấu trúc có thể được sử dụng để triển khai một message broker: một producer gửi một tin nhắn bằng cách nối thêm nó vào cuối log, và một consumer nhận tin nhắn bằng cách đọc log tuần tự. Nếu consumer đạt đến cuối log, nó chờ thông báo rằng một tin nhắn mới đã được nối thêm. Công cụ Unix tail -f, theo dõi một tệp để phát hiện dữ liệu được nối thêm, về cơ bản hoạt động như thế này.

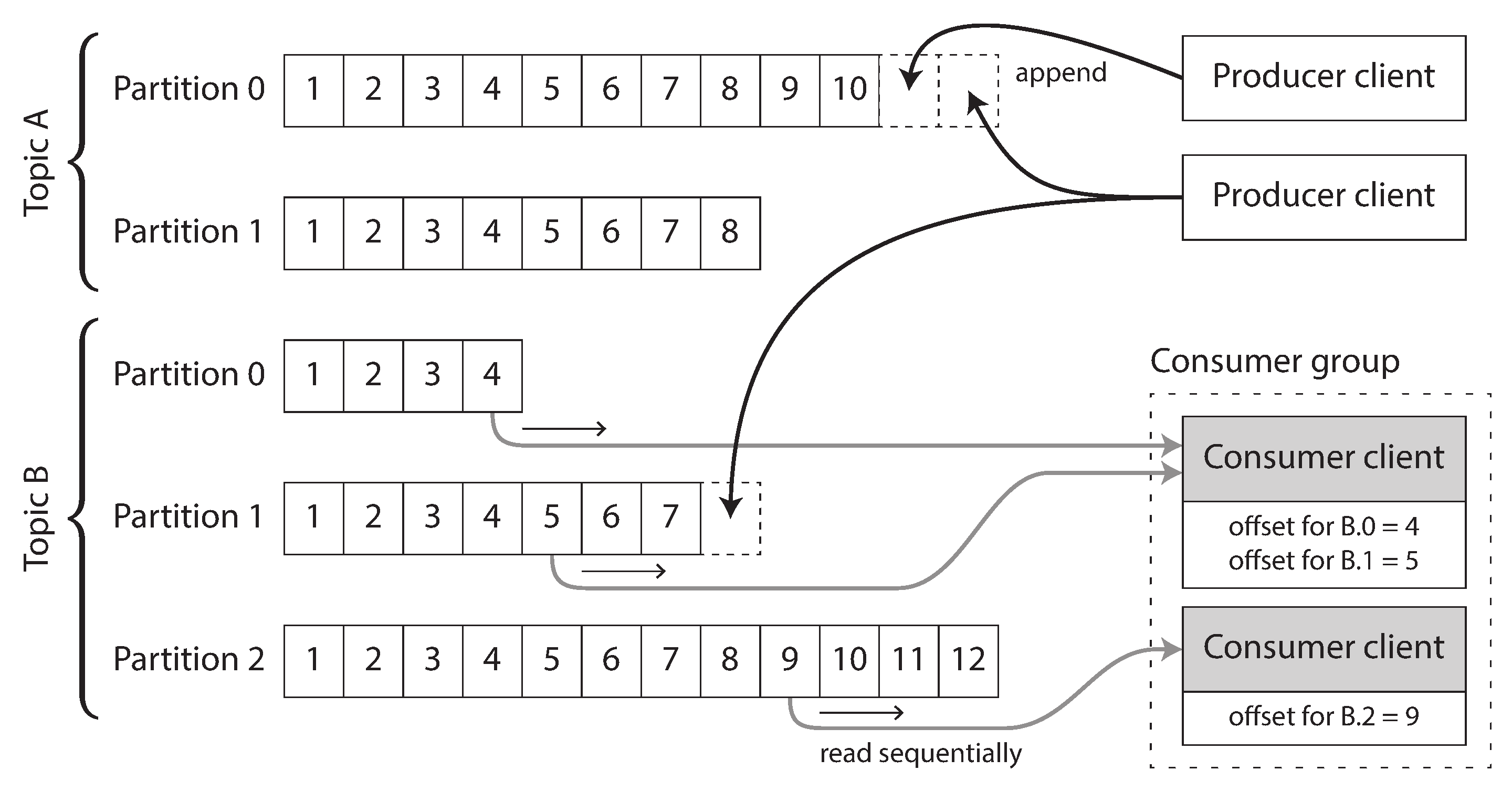

Để mở rộng đến thông lượng cao hơn so với một đĩa đơn có thể cung cấp, log có thể được sharded (chia mảnh, theo nghĩa của Chương 7). Các shard khác nhau sau đó có thể được lưu trữ trên các máy khác nhau, làm cho mỗi shard trở thành một log riêng biệt có thể được đọc và ghi độc lập với các shard khác. Sau đó một topic có thể được định nghĩa là một nhóm các shard đều mang tin nhắn cùng loại. Cách tiếp cận này được minh họa trong Hình 12-3.

Trong mỗi shard, mà Kafka gọi là một partition (phân vùng), broker gán một số thứ tự tăng đơn điệu (monotonically increasing), hay còn gọi là offset (độ lệch), cho mọi tin nhắn (trong Hình 12-3, các số trong hộp là offset của tin nhắn). Số thứ tự như vậy có ý nghĩa vì một partition (shard) là chỉ nối thêm, do đó các tin nhắn trong một partition được sắp xếp hoàn toàn. Không có đảm bảo thứ tự nào giữa các partition khác nhau.

Apache Kafka 20 và Amazon Kinesis Streams là các message broker dựa trên log hoạt động như thế này. Google Cloud Pub/Sub có kiến trúc tương tự nhưng cung cấp API theo phong cách JMS thay vì trừu tượng log 15. Mặc dù các message broker này ghi tất cả tin nhắn ra đĩa, chúng có thể đạt thông lượng hàng triệu tin nhắn mỗi giây bằng cách chia mảnh trên nhiều máy, và chịu lỗi bằng cách sao chép tin nhắn 21, 22.

So sánh log với nhắn tin truyền thống

Cách tiếp cận dựa trên log hỗ trợ nhắn tin fan-out một cách dễ dàng, vì nhiều consumer có thể đọc log độc lập mà không ảnh hưởng đến nhau, đọc một tin nhắn không xóa nó khỏi log. Để đạt cân bằng tải trên một nhóm consumer, thay vì phân công các tin nhắn riêng lẻ cho các client consumer, broker có thể phân công toàn bộ shard cho các nút trong consumer group.

Mỗi client sau đó tiêu thụ tất cả tin nhắn trong các shard được giao cho nó. Thông thường, khi một consumer được giao một shard log, nó đọc các tin nhắn trong shard đó tuần tự, theo cách đơn luồng đơn giản. Cách tiếp cận cân bằng tải thô này có một số nhược điểm:

Số lượng nút chia sẻ công việc tiêu thụ một topic có thể tối đa bằng số lượng shard log trong topic đó, vì các tin nhắn trong cùng một shard được giao đến cùng một nút. (Có thể tạo một cơ chế cân bằng tải trong đó hai consumer chia sẻ công việc xử lý một shard bằng cách cả hai đều đọc toàn bộ tập tin nhắn, nhưng một trong số chúng chỉ xem xét các tin nhắn có offset chẵn trong khi cái còn lại xử lý các offset lẻ. Ngoài ra, bạn có thể phân phối xử lý tin nhắn qua một thread pool, nhưng cách đó làm phức tạp việc quản lý offset consumer. Nói chung, xử lý đơn luồng của một shard là tốt hơn, và tính song song có thể được tăng lên bằng cách sử dụng nhiều shard hơn.)

Nếu một tin nhắn đơn lẻ chậm xử lý, nó sẽ giữ lại việc xử lý các tin nhắn tiếp theo trong shard đó (một dạng head-of-line blocking, tắc nghẽn đầu hàng; xem “Describing Performance”).

Vì vậy, trong các tình huống mà tin nhắn có thể tốn kém để xử lý và bạn muốn song song hóa xử lý trên cơ sở từng tin nhắn, và khi thứ tự tin nhắn không quan trọng lắm, phong cách JMS/AMQP của message broker là tốt hơn. Mặt khác, trong các tình huống với thông lượng tin nhắn cao, nơi mỗi tin nhắn nhanh để xử lý và thứ tự tin nhắn quan trọng, cách tiếp cận dựa trên log hoạt động rất tốt 23, 24. Tuy nhiên, sự phân biệt giữa hai kiến trúc đang bị mờ đi khi các hệ thống nhắn tin dựa trên log như Kafka hiện hỗ trợ các consumer group theo phong cách JMS/AMQP, cho phép nhiều consumer nhận tin nhắn từ cùng một partition 25, 26.

Vì các log được chia mảnh thường chỉ bảo toàn thứ tự tin nhắn trong một shard đơn, tất cả các tin nhắn cần được sắp xếp nhất quán phải được định tuyến đến cùng một shard. Ví dụ, một ứng dụng có thể yêu cầu rằng các sự kiện liên quan đến một người dùng cụ thể xuất hiện theo thứ tự cố định. Điều này có thể đạt được bằng cách chọn shard cho một sự kiện dựa trên ID người dùng của sự kiện đó (nói cách khác, làm cho ID người dùng trở thành partition key, khóa phân vùng).

Consumer offset

Tiêu thụ một shard tuần tự giúp dễ dàng biết tin nhắn nào đã được xử lý: tất cả các tin nhắn có offset nhỏ hơn offset hiện tại của consumer đã được xử lý, và tất cả các tin nhắn có offset lớn hơn chưa được nhìn thấy. Vì vậy, broker không cần theo dõi acknowledgment cho từng tin nhắn riêng lẻ, nó chỉ cần định kỳ ghi lại các offset consumer. Chi phí bookkeeping (quản lý sổ sách) giảm và các cơ hội cho việc batching và pipelining trong cách tiếp cận này giúp tăng thông lượng của các hệ thống dựa trên log. Tuy nhiên, nếu một consumer thất bại, nó sẽ tiếp tục từ offset được ghi lại lần cuối thay vì offset gần đây nhất mà nó đã thấy. Điều này có thể khiến consumer thấy một số tin nhắn hai lần.

Offset này thực sự rất giống với log sequence number (số thứ tự log) thường thấy trong sao chép cơ sở dữ liệu single-leader, mà chúng ta đã thảo luận trong “Setting Up New Followers”. Trong sao chép cơ sở dữ liệu, log sequence number cho phép một follower kết nối lại với leader sau khi nó bị ngắt kết nối, và tiếp tục sao chép mà không bỏ qua bất kỳ lần ghi nào. Chính xác cùng nguyên tắc được sử dụng ở đây: message broker hoạt động như một cơ sở dữ liệu leader, và consumer như một follower.

Nếu một nút consumer thất bại, một nút khác trong consumer group được giao các shard của consumer thất bại, và nó bắt đầu tiêu thụ tin nhắn tại offset được ghi lại lần cuối. Nếu consumer đã xử lý các tin nhắn tiếp theo nhưng chưa ghi lại offset của chúng, những tin nhắn đó sẽ được xử lý lần thứ hai khi khởi động lại. Chúng ta sẽ thảo luận về cách xử lý vấn đề này ở phần sau của chương.

Sử dụng không gian đĩa

Nếu bạn chỉ nối thêm vào log, cuối cùng bạn sẽ hết dung lượng đĩa. Để thu hồi không gian đĩa, log thực sự được chia thành các segment, và theo thời gian các segment cũ được xóa hoặc chuyển sang lưu trữ lưu trữ. (Chúng ta sẽ thảo luận về một cách tinh vi hơn để giải phóng không gian đĩa trong “Log compaction”.)

Điều này có nghĩa là nếu một consumer chậm không thể theo kịp tốc độ tin nhắn, và nó tụt hậu đến mức offset consumer của nó trỏ đến một segment đã bị xóa, nó sẽ bỏ lỡ một số tin nhắn. Về mặt hiệu quả, log triển khai một bộ đệm có kích thước giới hạn loại bỏ các tin nhắn cũ khi đầy, còn gọi là circular buffer (bộ đệm vòng) hoặc ring buffer (bộ đệm vành). Tuy nhiên, vì bộ đệm đó nằm trên đĩa, nó có thể khá lớn.

Hãy thực hiện một phép tính tính nhanh. Tại thời điểm viết, một ổ đĩa cứng lớn điển hình có dung lượng 20 TB và thông lượng ghi tuần tự 250 MB/s. Nếu bạn đang ghi tin nhắn ở tốc độ nhanh nhất có thể, phải mất khoảng 22 giờ cho đến khi ổ đĩa đầy và bạn cần bắt đầu xóa các tin nhắn cũ nhất. Điều đó có nghĩa là một log dựa trên đĩa luôn có thể đệm ít nhất 22 giờ tin nhắn, ngay cả khi bạn có nhiều đĩa với nhiều máy (có nhiều đĩa hơn tăng cả dung lượng có sẵn và tổng băng thông ghi). Trong thực tế, các triển khai hiếm khi sử dụng toàn bộ băng thông ghi của đĩa, vì vậy log thường có thể giữ bộ đệm tin nhắn trong vài ngày hoặc thậm chí vài tuần.

Nhiều message broker dựa trên log hiện lưu trữ tin nhắn trong object storage để tăng dung lượng lưu trữ, tương tự như cơ sở dữ liệu như chúng ta đã thấy trong “Databases Backed by Object Storage”. Các message broker như Apache Kafka và Redpanda phục vụ các tin nhắn cũ hơn từ object storage như một phần của tiered storage (lưu trữ phân tầng). Các broker khác, như WarpStream, Confluent Freight, và Bufstream lưu tất cả dữ liệu của chúng trong object store. Ngoài hiệu quả chi phí, kiến trúc này cũng giúp tích hợp dữ liệu dễ dàng hơn: các tin nhắn trong object storage được lưu trữ dưới dạng bảng Iceberg, cho phép thực thi job batch và data warehouse trực tiếp trên dữ liệu mà không cần sao chép nó vào hệ thống khác.

Khi consumer không thể theo kịp producer

Ở đầu “Hệ Thống Nhắn Tin” chúng ta đã thảo luận về ba lựa chọn phải làm gì nếu consumer không thể theo kịp tốc độ mà producer gửi tin nhắn: loại bỏ tin nhắn, đệm, hoặc áp dụng backpressure. Trong phân loại này, cách tiếp cận dựa trên log là một dạng đệm với bộ đệm lớn nhưng kích thước cố định (bị giới hạn bởi không gian đĩa có sẵn).

Nếu consumer tụt hậu đến mức các tin nhắn nó yêu cầu cũ hơn những gì được giữ lại trên đĩa, nó sẽ không thể đọc các tin nhắn đó, vì vậy broker thực sự loại bỏ các tin nhắn cũ vượt quá kích thước bộ đệm có thể chứa. Bạn có thể theo dõi consumer tụt hậu bao xa so với đầu log, và đưa ra cảnh báo nếu nó tụt hậu đáng kể. Vì bộ đệm lớn, có đủ thời gian để người vận hành sửa consumer chậm và cho phép nó bắt kịp trước khi nó bắt đầu bỏ lỡ tin nhắn.

Ngay cả khi một consumer tụt hậu quá xa và bắt đầu bỏ lỡ tin nhắn, chỉ có consumer đó bị ảnh hưởng; nó không gây gián đoạn dịch vụ cho các consumer khác. Thực tế này là một lợi thế vận hành lớn: bạn có thể thử nghiệm tiêu thụ một log sản xuất để phát triển, kiểm thử, hoặc gỡ lỗi, mà không phải lo lắng nhiều về việc gây gián đoạn các dịch vụ sản xuất. Khi một consumer bị tắt hoặc bị sập, nó ngừng tiêu thụ tài nguyên, điều duy nhất còn lại là offset consumer của nó.

Hành vi này cũng tương phản với các message broker truyền thống, nơi bạn cần cẩn thận để xóa bất kỳ hàng đợi nào mà consumer của chúng đã bị tắt, nếu không chúng tiếp tục tích lũy tin nhắn một cách không cần thiết và chiếm bộ nhớ của các consumer vẫn còn hoạt động.

Phát lại tin nhắn cũ

Chúng ta đã lưu ý trước đây rằng với các message broker theo phong cách AMQP và JMS, xử lý và xác nhận tin nhắn là một thao tác mang tính hủy hoại, vì nó khiến các tin nhắn bị xóa trên broker. Mặt khác, trong một message broker dựa trên log, tiêu thụ tin nhắn giống như đọc từ một tệp hơn: đó là một thao tác chỉ đọc không thay đổi log.

Tác dụng phụ duy nhất của việc xử lý, ngoài bất kỳ đầu ra nào của consumer, là offset consumer tiến về phía trước. Nhưng offset nằm dưới quyền kiểm soát của consumer, vì vậy nó có thể dễ dàng được thao tác nếu cần thiết: ví dụ, bạn có thể khởi động một bản sao của consumer với offset của ngày hôm qua và ghi đầu ra ra một vị trí khác, để xử lý lại tin nhắn của ngày cuối cùng. Bạn có thể lặp lại điều này bất kỳ số lần nào, thay đổi mã xử lý.

Khía cạnh này làm cho nhắn tin dựa trên log giống với các quá trình batch của chương trước hơn, nơi dữ liệu dẫn xuất được tách biệt rõ ràng khỏi dữ liệu đầu vào thông qua một quá trình biến đổi có thể lặp lại. Nó cho phép thử nghiệm nhiều hơn và phục hồi dễ dàng hơn từ các lỗi và bug, làm cho nó trở thành một công cụ tốt để tích hợp dataflow trong một tổ chức 27.

Cơ Sở Dữ Liệu và Luồng

Chúng ta đã so sánh một số điểm giữa message broker và cơ sở dữ liệu. Mặc dù theo truyền thống chúng được coi là các danh mục công cụ riêng biệt, chúng ta đã thấy rằng các message broker dựa trên log đã thành công trong việc lấy ý tưởng từ cơ sở dữ liệu và áp dụng chúng vào nhắn tin. Chúng ta cũng có thể đi theo chiều ngược lại: lấy ý tưởng từ nhắn tin và luồng, và áp dụng chúng vào cơ sở dữ liệu.

Một cách tiếp cận là sử dụng một event stream làm system of record (hệ thống lưu trữ chính) để lưu dữ liệu (xem “Systems of Record and Derived Data”). Đây là điều xảy ra trong event sourcing (lấy nguồn từ sự kiện), mà chúng ta đã thảo luận trong “Event Sourcing and CQRS”: thay vì lưu trữ dữ liệu trong một mô hình dữ liệu bị biến đổi bằng cách cập nhật và xóa, bạn có thể mô hình hóa mọi thay đổi trạng thái như một sự kiện bất biến, và ghi nó vào log chỉ nối thêm. Bất kỳ materialized view nào được tối ưu hóa để đọc đều được dẫn xuất từ các sự kiện này. Các message broker dựa trên log (được cấu hình để không bao giờ xóa các sự kiện cũ) rất phù hợp cho event sourcing vì chúng sử dụng lưu trữ chỉ nối thêm, và chúng có thể thông báo cho consumer về các sự kiện mới với độ trễ thấp.

Nhưng bạn không nhất thiết phải đi xa đến mức áp dụng event sourcing; ngay cả với các mô hình dữ liệu có thể thay đổi, các event stream vẫn hữu ích cho cơ sở dữ liệu. Thực tế, mọi lần ghi vào cơ sở dữ liệu đều là một sự kiện có thể được nắm bắt, lưu trữ và xử lý. Mối liên hệ giữa cơ sở dữ liệu và luồng sâu sắc hơn chỉ là lưu trữ vật lý của các log trên đĩa, nó khá cơ bản.

Ví dụ, một replication log (log sao chép, xem “Implementation of Replication Logs”) là một luồng các sự kiện ghi cơ sở dữ liệu, được tạo ra bởi leader khi nó xử lý các transaction. Các follower áp dụng luồng ghi đó vào bản sao của cơ sở dữ liệu của chính họ và do đó kết thúc với một bản sao chính xác của cùng dữ liệu. Các sự kiện trong replication log mô tả các thay đổi dữ liệu đã xảy ra.

Chúng ta cũng đã gặp nguyên tắc state machine replication (sao chép máy trạng thái) trong “Using shared logs”, nguyên tắc này nói rằng: nếu mỗi sự kiện đại diện cho một lần ghi vào cơ sở dữ liệu, và mỗi bản sao xử lý các sự kiện giống nhau theo cùng thứ tự, thì các bản sao sẽ đều kết thúc ở cùng trạng thái cuối cùng. (Xử lý một sự kiện được giả định là một thao tác xác định.) Đó chỉ là một trường hợp khác của event stream!

Trong phần này chúng ta trước tiên sẽ xem xét một vấn đề phát sinh trong các hệ thống dữ liệu không đồng nhất, sau đó khám phá cách chúng ta có thể giải quyết nó bằng cách đưa ý tưởng từ event stream vào cơ sở dữ liệu.

Giữ Các Hệ Thống Đồng Bộ

Như chúng ta đã thấy trong suốt cuốn sách này, không có hệ thống đơn lẻ nào có thể đáp ứng tất cả nhu cầu lưu trữ, truy vấn và xử lý dữ liệu. Trong thực tế, hầu hết các ứng dụng không tầm thường cần kết hợp nhiều công nghệ khác nhau để đáp ứng yêu cầu của chúng: ví dụ, sử dụng cơ sở dữ liệu OLTP để phục vụ yêu cầu người dùng, cache để tăng tốc các yêu cầu phổ biến, chỉ mục full-text để xử lý các truy vấn tìm kiếm, và data warehouse để phân tích. Mỗi trong số này có bản sao dữ liệu của riêng nó, được lưu trữ trong biểu diễn riêng của nó được tối ưu hóa cho mục đích riêng.

Khi cùng dữ liệu hoặc dữ liệu liên quan xuất hiện ở nhiều nơi khác nhau, chúng cần được giữ đồng bộ với nhau: nếu một mục được cập nhật trong cơ sở dữ liệu, nó cũng cần được cập nhật trong cache, chỉ mục tìm kiếm và data warehouse. Với data warehouse, đồng bộ hóa này thường được thực hiện bởi các quá trình ETL (xem “Data Warehousing”), thường bằng cách lấy một bản sao đầy đủ của cơ sở dữ liệu, chuyển đổi nó, và tải hàng loạt vào data warehouse, nói cách khác là một quá trình batch. Tương tự, chúng ta đã thấy trong “Batch Use Cases” cách các chỉ mục tìm kiếm, hệ thống gợi ý, và các hệ thống dữ liệu dẫn xuất khác có thể được tạo bằng các quá trình batch.

Nếu các bản dump cơ sở dữ liệu đầy đủ định kỳ quá chậm, một giải pháp thay thế đôi khi được sử dụng là dual writes (ghi kép), trong đó mã ứng dụng ghi rõ ràng vào mỗi hệ thống khi dữ liệu thay đổi: ví dụ, trước tiên ghi vào cơ sở dữ liệu, sau đó cập nhật chỉ mục tìm kiếm, sau đó vô hiệu hóa các mục cache (hoặc thậm chí thực hiện các lần ghi đó đồng thời).

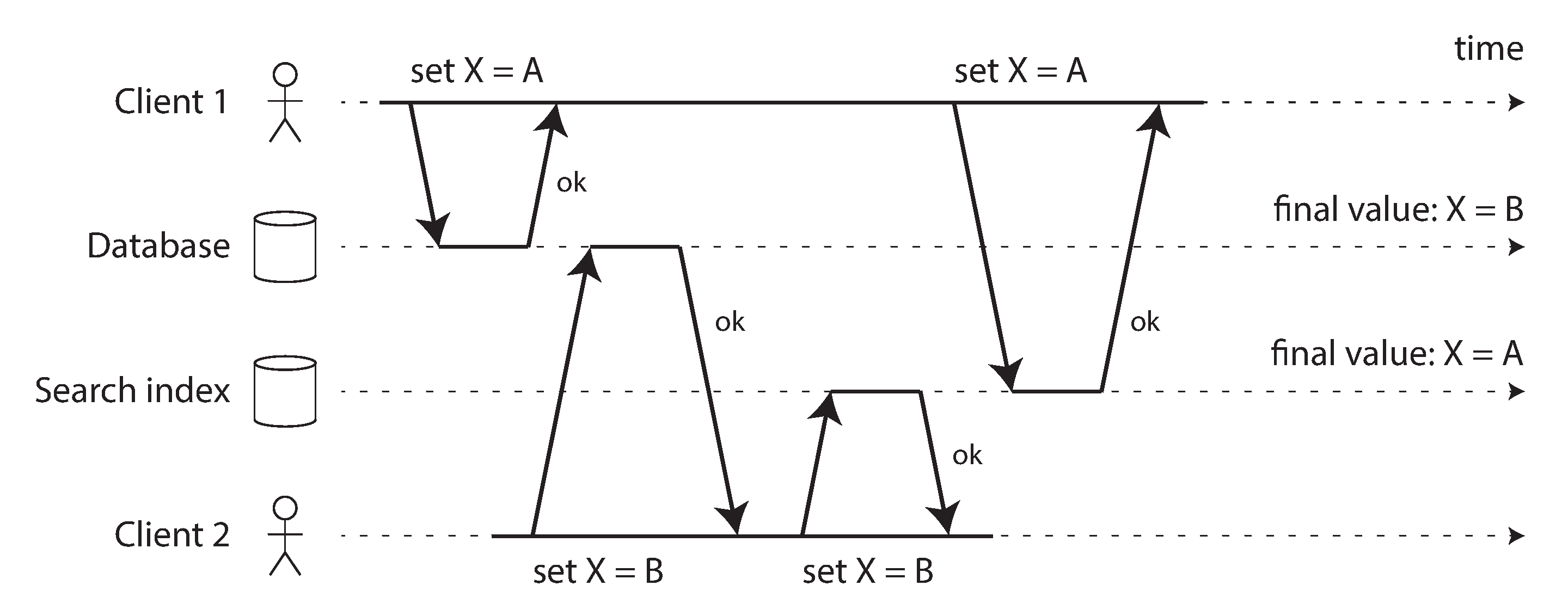

Tuy nhiên, dual writes có một số vấn đề nghiêm trọng, một trong đó là điều kiện race condition được minh họa trong Hình 12-4. Trong ví dụ này, hai client đồng thời muốn cập nhật một mục X: client 1 muốn đặt giá trị thành A, và client 2 muốn đặt nó thành B. Cả hai client đầu tiên ghi giá trị mới vào cơ sở dữ liệu, sau đó ghi vào chỉ mục tìm kiếm. Do thời gian không may, các yêu cầu bị xen kẽ: cơ sở dữ liệu đầu tiên thấy lần ghi từ client 1 đặt giá trị thành A, sau đó lần ghi từ client 2 đặt giá trị thành B, vì vậy giá trị cuối cùng trong cơ sở dữ liệu là B. Chỉ mục tìm kiếm đầu tiên thấy lần ghi từ client 2, sau đó client 1, vì vậy giá trị cuối cùng trong chỉ mục tìm kiếm là A. Hai hệ thống hiện không nhất quán vĩnh viễn với nhau, mặc dù không có lỗi nào xảy ra.

Trừ khi bạn có một số cơ chế phát hiện tính đồng thời bổ sung, chẳng hạn như các version vector mà chúng ta đã thảo luận trong “Detecting Concurrent Writes”, bạn thậm chí sẽ không nhận ra rằng các lần ghi đồng thời đã xảy ra, một giá trị sẽ đơn giản ghi đè im lặng lên giá trị khác.

Một vấn đề khác với dual writes là một trong các lần ghi có thể thất bại trong khi cái kia thành công. Đây là vấn đề chịu lỗi chứ không phải vấn đề đồng thời, nhưng nó cũng có tác dụng khiến hai hệ thống trở nên không nhất quán với nhau. Đảm bảo rằng cả hai đều thành công hoặc đều thất bại là trường hợp của vấn đề atomic commit (cam kết nguyên tử), tốn kém để giải quyết (xem “Two-Phase Commit (2PC)”).

Nếu bạn chỉ có một cơ sở dữ liệu được sao chép với một single leader, thì leader đó xác định thứ tự ghi, vì vậy cách tiếp cận state machine replication hoạt động giữa các bản sao của cơ sở dữ liệu. Tuy nhiên, trong Hình 12-4 không có một single leader: cơ sở dữ liệu có thể có một leader và chỉ mục tìm kiếm có thể có một leader, nhưng không cái nào theo cái kia, và vì vậy xung đột có thể xảy ra (xem “Multi-Leader Replication”).

Tình huống sẽ tốt hơn nếu thực sự chỉ có một leader, ví dụ cơ sở dữ liệu, và nếu chúng ta có thể làm cho chỉ mục tìm kiếm trở thành follower của cơ sở dữ liệu. Nhưng điều này có khả thi trong thực tế không?

Change Data Capture

Vấn đề với replication log của hầu hết các cơ sở dữ liệu là chúng từ lâu đã được coi là chi tiết triển khai nội bộ của cơ sở dữ liệu, không phải là một API công khai. Client được cho là truy vấn cơ sở dữ liệu thông qua mô hình dữ liệu và ngôn ngữ truy vấn của nó, không phải phân tích cú pháp replication log và cố gắng trích xuất dữ liệu từ chúng.

Trong nhiều thập kỷ, nhiều cơ sở dữ liệu đơn giản không có cách được ghi lại để lấy log các thay đổi được ghi vào chúng. Vì lý do này, rất khó để lấy tất cả các thay đổi được thực hiện trong một cơ sở dữ liệu và sao chép chúng sang một công nghệ lưu trữ khác như chỉ mục tìm kiếm, cache, hoặc data warehouse.

Gần đây hơn, đã có sự quan tâm ngày càng tăng đối với change data capture (CDC, nắm bắt dữ liệu thay đổi), đó là quá trình quan sát tất cả các thay đổi dữ liệu được ghi vào cơ sở dữ liệu và trích xuất chúng ở dạng có thể được sao chép sang các hệ thống khác 28. CDC đặc biệt thú vị nếu các thay đổi được cung cấp như một luồng, ngay lập tức khi chúng được ghi.

Ví dụ, bạn có thể nắm bắt các thay đổi trong một cơ sở dữ liệu và liên tục áp dụng các thay đổi tương tự vào một chỉ mục tìm kiếm. Nếu log thay đổi được áp dụng theo cùng thứ tự, bạn có thể kỳ vọng dữ liệu trong chỉ mục tìm kiếm khớp với dữ liệu trong cơ sở dữ liệu. Chỉ mục tìm kiếm và bất kỳ hệ thống dữ liệu dẫn xuất nào khác chỉ là consumer của luồng thay đổi.

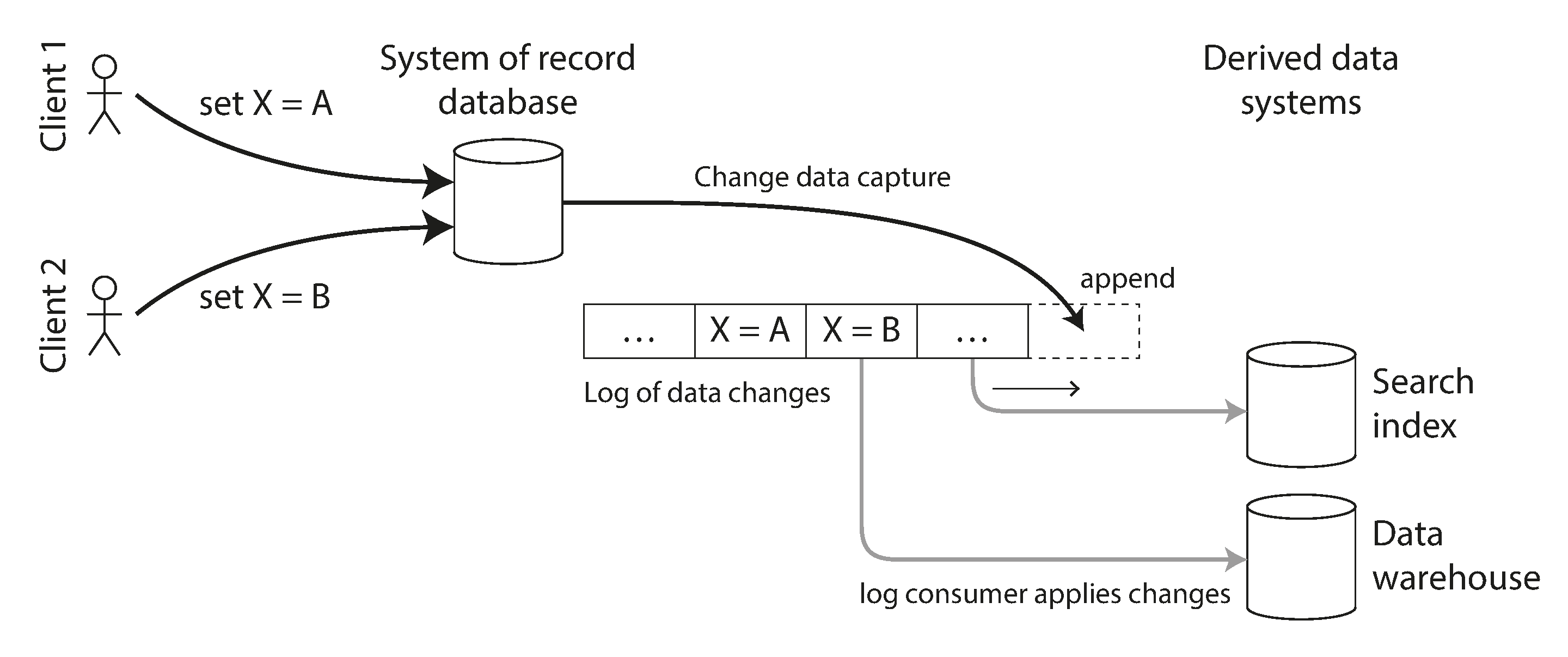

Hình 12-5 cho thấy cách vấn đề đồng thời trong Hình 12-4 được giải quyết với CDC. Mặc dù hai yêu cầu đặt X thành A và B tương ứng đến đồng thời tại cơ sở dữ liệu, cơ sở dữ liệu quyết định một thứ tự để thực thi chúng, và ghi chúng vào replication log của nó theo thứ tự đó. Chỉ mục tìm kiếm chọn chúng và áp dụng chúng theo cùng thứ tự. Nếu bạn cần dữ liệu trong một hệ thống khác, chẳng hạn data warehouse, bạn có thể đơn giản thêm nó như một consumer khác của CDC event stream.

Triển khai change data capture

Chúng ta có thể gọi các log consumer là các hệ thống dữ liệu dẫn xuất (derived data systems), như đã thảo luận trong “Systems of Record and Derived Data”: dữ liệu được lưu trữ trong chỉ mục tìm kiếm và data warehouse chỉ là một cái nhìn khác về dữ liệu trong system of record. Change data capture là một cơ chế để đảm bảo rằng tất cả các thay đổi được thực hiện đối với system of record cũng được phản ánh trong các hệ thống dữ liệu dẫn xuất để các hệ thống dẫn xuất có một bản sao chính xác của dữ liệu.

Về cơ bản, change data capture làm cho một cơ sở dữ liệu trở thành leader (cơ sở dữ liệu mà các thay đổi được nắm bắt từ đó), và biến các cơ sở dữ liệu khác thành follower. Một message broker dựa trên log rất phù hợp để vận chuyển các sự kiện thay đổi từ cơ sở dữ liệu nguồn đến các hệ thống dẫn xuất, vì nó bảo toàn thứ tự của tin nhắn (tránh vấn đề sắp xếp lại của Hình 12-2).

Các logical replication log có thể được sử dụng để triển khai change data capture (xem “Logical (row-based) log replication”), mặc dù nó đi kèm với những thách thức, chẳng hạn xử lý các thay đổi schema và mô hình hóa đúng các cập nhật. Dự án mã nguồn mở Debezium giải quyết những thách thức này. Dự án chứa các source connector (kết nối nguồn) cho MySQL, PostgreSQL, Oracle, SQL Server, Db2, Cassandra, và nhiều cơ sở dữ liệu khác. Các connector này gắn vào replication log của cơ sở dữ liệu và cung cấp các thay đổi theo một schema sự kiện chuẩn. Các tin nhắn có thể được chuyển đổi và ghi vào các cơ sở dữ liệu downstream. Framework Kafka Connect cũng cung cấp thêm các CDC connector cho các cơ sở dữ liệu khác nhau. Maxwell làm điều tương tự cho MySQL bằng cách phân tích binlog 29, GoldenGate cung cấp các cơ sở hạ tầng tương tự cho Oracle, và pgcapture làm điều tương tự cho PostgreSQL.

Như với message broker, change data capture thường là bất đồng bộ: cơ sở dữ liệu system of record không chờ thay đổi được áp dụng cho consumer trước khi commit nó. Thiết kế này có lợi thế vận hành là thêm một consumer chậm không ảnh hưởng quá nhiều đến system of record, nhưng nó có nhược điểm là tất cả các vấn đề về replication lag áp dụng (xem “Problems with Replication Lag”).

Snapshot ban đầu

Nếu bạn có log của tất cả các thay đổi từng được thực hiện đối với một cơ sở dữ liệu, bạn có thể tái tạo toàn bộ trạng thái của cơ sở dữ liệu bằng cách phát lại log. Tuy nhiên, trong nhiều trường hợp, giữ tất cả các thay đổi mãi mãi sẽ đòi hỏi quá nhiều dung lượng đĩa, và phát lại nó sẽ mất quá nhiều thời gian, vì vậy log cần được cắt ngắn.

Ví dụ, xây dựng một chỉ mục full-text mới yêu cầu một bản sao đầy đủ của toàn bộ cơ sở dữ liệu, không đủ để chỉ áp dụng log của các thay đổi gần đây, vì nó sẽ thiếu các mục không được cập nhật gần đây. Vì vậy, nếu bạn không có toàn bộ lịch sử log, bạn cần bắt đầu với một snapshot nhất quán, như đã thảo luận trước đây trong “Setting Up New Followers”.

Snapshot của cơ sở dữ liệu phải tương ứng với một vị trí hoặc offset đã biết trong change log, để bạn biết tại điểm nào phải bắt đầu áp dụng các thay đổi sau khi snapshot đã được xử lý. Một số công cụ CDC tích hợp tiện ích snapshot này, trong khi các công cụ khác để nó như một thao tác thủ công. Debezium sử dụng thuật toán watermarking DBLog của Netflix để cung cấp các snapshot tăng dần 30, 31.

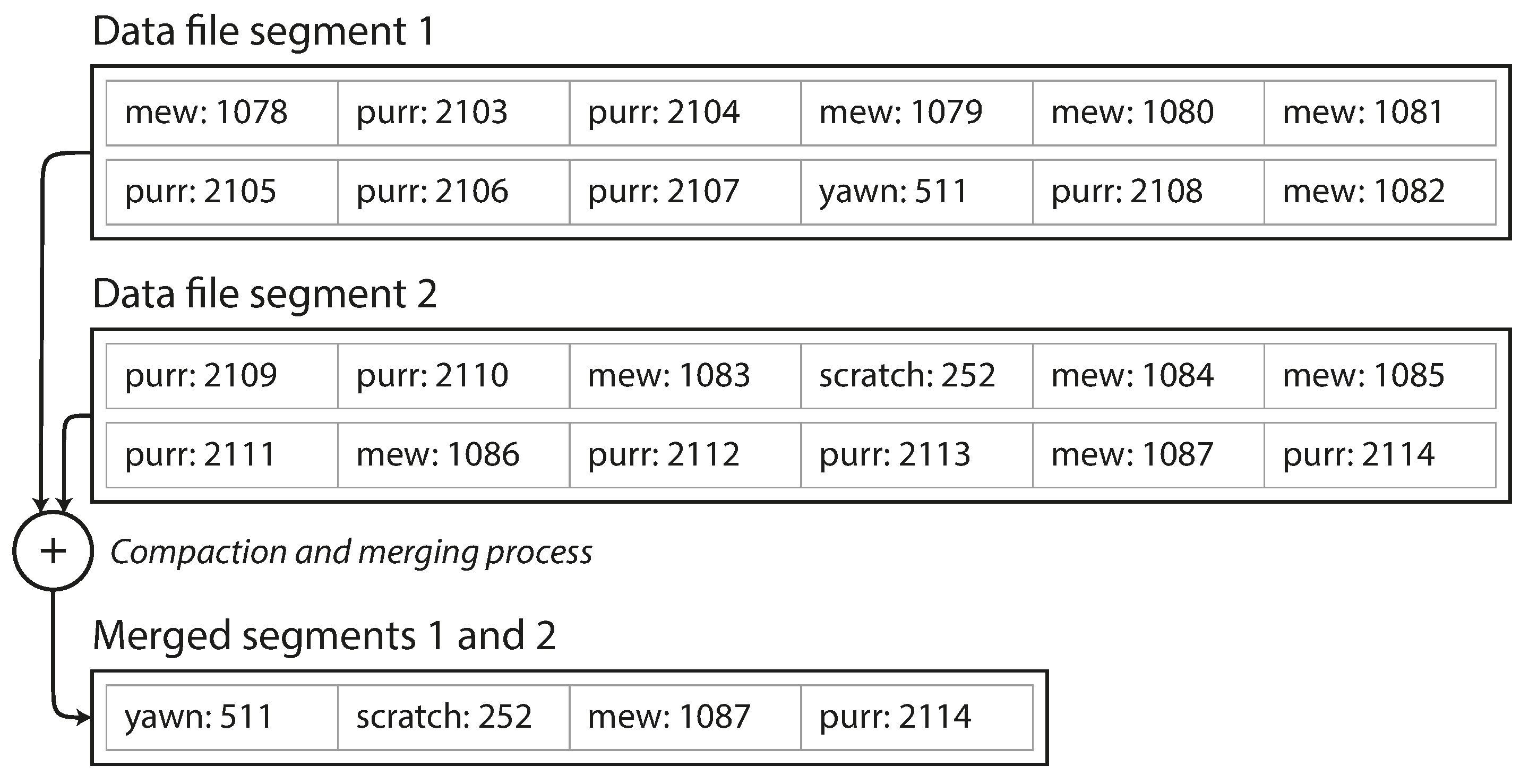

Log compaction

Nếu bạn chỉ có thể giữ một lượng lịch sử log giới hạn, bạn cần phải trải qua quá trình snapshot mỗi khi bạn muốn thêm một hệ thống dữ liệu dẫn xuất mới. Tuy nhiên, log compaction (nén log) cung cấp một giải pháp thay thế tốt.

Chúng ta đã thảo luận về log compaction trước đây trong “Log-Structured Storage”, trong ngữ cảnh của các engine lưu trữ có cấu trúc log (xem Hình 4-3 để có ví dụ). Nguyên tắc rất đơn giản: engine lưu trữ định kỳ tìm kiếm các bản ghi log có cùng khóa, loại bỏ bất kỳ bản sao nào, và chỉ giữ bản cập nhật gần đây nhất cho mỗi khóa. Điều này có thể làm cho các segment log nhỏ hơn nhiều, vì vậy các segment cũng có thể được hợp nhất như một phần của quá trình compaction, như được hiển thị trong Hình 12-6. Quá trình này chạy trong nền.

Trong một engine lưu trữ có cấu trúc log, một cập nhật với giá trị null đặc biệt (một tombstone, dấu bia mộ) chỉ ra rằng một khóa đã bị xóa, và làm cho nó bị xóa trong quá trình log compaction. Nhưng miễn là một khóa không bị ghi đè hoặc xóa, nó vẫn trong log mãi mãi. Dung lượng đĩa cần thiết cho một log đã được nén như vậy chỉ phụ thuộc vào nội dung hiện tại của cơ sở dữ liệu, không phải số lần ghi từng xảy ra trong cơ sở dữ liệu. Nếu cùng một khóa thường xuyên bị ghi đè, các giá trị trước đó cuối cùng sẽ bị thu gom rác, và chỉ giá trị mới nhất sẽ được giữ lại.

Ý tưởng tương tự hoạt động trong ngữ cảnh của message broker dựa trên log và change data capture. Nếu hệ thống CDC được thiết lập sao cho mỗi thay đổi có một primary key, và mỗi cập nhật cho một khóa thay thế giá trị trước đó cho khóa đó, thì đủ để chỉ giữ lần ghi gần đây nhất cho một khóa cụ thể.

Bây giờ, bất cứ khi nào bạn muốn xây dựng lại một hệ thống dữ liệu dẫn xuất như chỉ mục tìm kiếm, bạn có thể khởi động một consumer mới từ offset 0 của topic đã được nén log, và quét tuần tự qua tất cả các tin nhắn trong log. Log được đảm bảo chứa giá trị gần đây nhất cho mỗi khóa trong cơ sở dữ liệu (và có thể một số giá trị cũ hơn), nói cách khác, bạn có thể sử dụng nó để lấy một bản sao đầy đủ nội dung cơ sở dữ liệu mà không cần phải lấy một snapshot khác của cơ sở dữ liệu nguồn CDC.

Tính năng log compaction này được hỗ trợ bởi Apache Kafka. Như chúng ta sẽ thấy ở phần sau trong chương này, nó cho phép message broker được sử dụng cho lưu trữ bền vững, không chỉ cho nhắn tin tạm thời.

Hỗ trợ API cho các luồng thay đổi

Hầu hết các cơ sở dữ liệu phổ biến hiện nay cung cấp các change stream như một giao diện first-class, thay vì những nỗ lực CDC được cải tiến và đảo ngược công nghệ (reverse-engineered) trong quá khứ. Các cơ sở dữ liệu quan hệ như MySQL và PostgreSQL thường gửi các thay đổi qua cùng replication log mà chúng sử dụng cho các bản sao của riêng chúng. Hầu hết các nhà cung cấp đám mây cũng cung cấp các giải pháp CDC cho sản phẩm của họ: ví dụ, Datastream cung cấp truy cập dữ liệu streaming cho các cơ sở dữ liệu quan hệ và data warehouse của Google Cloud.

Ngay cả các cơ sở dữ liệu consistent cuối cùng, dựa trên quorum như Cassandra hiện cũng hỗ trợ change data capture. Như chúng ta đã thấy trong “Linearizability and quorums”, client phải lưu các lần ghi đến đa số nút trước khi chúng được coi là hiển thị. Hỗ trợ CDC cho quorum write là thách thức vì không có một nguồn dữ liệu sự thật duy nhất để đăng ký. Việc dữ liệu có hiển thị hay không phụ thuộc vào sở thích nhất quán của mỗi người đọc. Cassandra vượt qua vấn đề này bằng cách cung cấp các segment log thô cho mỗi nút thay vì cung cấp một luồng đột biến duy nhất. Các hệ thống muốn tiêu thụ dữ liệu phải đọc các segment log thô cho mỗi nút và quyết định cách tốt nhất để hợp nhất chúng thành một luồng duy nhất (giống như một quorum reader làm) 32.

Kafka Connect 33 tích hợp các công cụ change data capture cho nhiều hệ thống cơ sở dữ liệu với Kafka. Khi luồng sự kiện thay đổi có trong Kafka, nó có thể được sử dụng để cập nhật các hệ thống dữ liệu dẫn xuất như chỉ mục tìm kiếm, và cũng cấp dữ liệu vào các hệ thống xử lý luồng như đã thảo luận ở phần sau của chương này.

So sánh change data capture và event sourcing

Hãy so sánh change data capture với event sourcing. Tương tự như change data capture, event sourcing liên quan đến việc lưu trữ tất cả các thay đổi đối với trạng thái ứng dụng như một log các sự kiện thay đổi. Sự khác biệt lớn nhất là event sourcing áp dụng ý tưởng ở một mức trừu tượng khác:

Trong change data capture, ứng dụng sử dụng cơ sở dữ liệu theo cách có thể thay đổi, cập nhật và xóa các bản ghi tùy ý. Log thay đổi được trích xuất từ cơ sở dữ liệu ở mức thấp (ví dụ, bằng cách phân tích replication log), điều này đảm bảo rằng thứ tự ghi được trích xuất từ cơ sở dữ liệu khớp với thứ tự chúng thực sự được ghi, tránh điều kiện race condition trong Hình 12-4.

Trong event sourcing, logic ứng dụng được xây dựng rõ ràng trên cơ sở các sự kiện bất biến được ghi vào một event log. Trong trường hợp này, event store là chỉ nối thêm, và cập nhật hoặc xóa các sự kiện không được khuyến khích hoặc bị cấm. Các sự kiện được thiết kế để phản ánh những điều đã xảy ra ở mức ứng dụng, thay vì các thay đổi trạng thái mức thấp.

Cái nào tốt hơn phụ thuộc vào tình huống của bạn. Áp dụng event sourcing là một thay đổi lớn đối với một ứng dụng chưa làm điều đó; nó có một số ưu và nhược điểm, mà chúng ta đã thảo luận trong “Event Sourcing and CQRS”. Ngược lại, CDC có thể được thêm vào cơ sở dữ liệu hiện có với những thay đổi tối thiểu, ứng dụng ghi vào cơ sở dữ liệu thậm chí có thể không biết rằng CDC đang xảy ra.

CHANGE DATA CAPTURE AND DATABASE SCHEMAS

Though change data capture appears easier to adopt than event sourcing, it comes with its own set of challenges.

In a microservices architecture, a database is typically only accessed from one service. Other services interact with it through that service’s public API, but they don’t normally access the database directly. This makes the database an internal implementation detail of the service, allowing the developers to change its database schema without affecting the public API.

However, CDC systems typically use the upstream database’s schema when replicating its data, which turns these schemas into public APIs that must be managed much like the public API of the service. A developer who removes a table column in their database table will break downstream consumers that depend on this field. Such challenges have always existed with data pipelines, but they typically only impacted data warehouse ETL. Since CDC is often implemented as a data stream, other production services might be consumers. Breaking such consumers can cause a customer-facing outage 34. Data contracts are often used to prevent these breakages.

A common way to decouple internal from external schemas is to use the outbox pattern. Outboxes are tables with their own schemas, which are exposed to the CDC system rather than the internal domain model in the database 35, 36. Developers can then modify their internal schemas as they see fit while leaving their outbox tables untouched. This might look like a dual write—it is. However, outboxes avoid the challenges we discussed in “Keeping Systems in Sync” by keeping both writes in the same system (the database). This design allows both writes to appear in a single transaction.

Outboxes present a few tradeoffs, though. Developers must still maintain the transformation between their internal and outbox schemas, which can be challenging. An outbox also increases the amount of data that the database has to write to its underlying storage, which might trigger performance problems.

Cũng như với change data capture, phát lại event log cho phép bạn tái tạo trạng thái hiện tại của hệ thống. Tuy nhiên, log compaction cần được xử lý khác nhau:

Một CDC event cho việc cập nhật một bản ghi thường chứa toàn bộ phiên bản mới của bản ghi, vì vậy giá trị hiện tại cho một primary key hoàn toàn được xác định bởi sự kiện gần đây nhất cho primary key đó, và log compaction có thể loại bỏ các sự kiện trước đó cho cùng khóa.

Mặt khác, với event sourcing, các sự kiện được mô hình hóa ở mức cao hơn: một sự kiện thường thể hiện ý định của một hành động người dùng, không phải cơ chế cập nhật trạng thái xảy ra do hành động đó. Trong trường hợp này, các sự kiện sau thường không ghi đè lên các sự kiện trước, và vì vậy bạn cần toàn bộ lịch sử sự kiện để tái tạo trạng thái cuối cùng. Log compaction không thể thực hiện theo cách tương tự.

Các ứng dụng sử dụng event sourcing thường có một số cơ chế để lưu trữ snapshot của trạng thái hiện tại được dẫn xuất từ log sự kiện, để chúng không cần phải xử lý lại toàn bộ log nhiều lần. Tuy nhiên, đây chỉ là một tối ưu hóa hiệu năng để tăng tốc việc đọc và phục hồi từ sự cố; ý định là hệ thống có thể lưu trữ tất cả các sự kiện thô mãi mãi và xử lý lại toàn bộ event log bất cứ khi nào được yêu cầu. Chúng ta thảo luận giả định này trong “Limitations of immutability”.

Trạng Thái, Luồng và Tính Bất Biến

Chúng ta đã thấy trong Chương 11 rằng xử lý batch được hưởng lợi từ tính bất biến của các tệp đầu vào, vì vậy bạn có thể chạy các job xử lý thử nghiệm trên các tệp đầu vào hiện có mà không sợ làm hỏng chúng. Nguyên tắc bất biến này cũng là điều làm cho event sourcing và change data capture trở nên mạnh mẽ.

Chúng ta thường nghĩ về cơ sở dữ liệu như lưu trữ trạng thái hiện tại của ứng dụng, biểu diễn này được tối ưu hóa để đọc, và thường là thuận tiện nhất để phục vụ các truy vấn. Bản chất của trạng thái là nó thay đổi, vì vậy cơ sở dữ liệu hỗ trợ cập nhật và xóa dữ liệu cũng như chèn nó. Điều này phù hợp với tính bất biến như thế nào?

Bất cứ khi nào bạn có trạng thái thay đổi, trạng thái đó là kết quả của các sự kiện đã biến đổi nó theo thời gian. Ví dụ, danh sách chỗ ngồi hiện có của bạn là kết quả của các đặt chỗ bạn đã xử lý, số dư tài khoản hiện tại là kết quả của các khoản ghi có và ghi nợ trên tài khoản, và biểu đồ thời gian phản hồi cho máy chủ web của bạn là tổng hợp của các thời gian phản hồi riêng lẻ của tất cả các yêu cầu web đã xảy ra.

Dù trạng thái thay đổi như thế nào, luôn có một chuỗi sự kiện gây ra những thay đổi đó. Ngay cả khi mọi thứ được thực hiện và hoàn tác, thực tế vẫn đúng rằng những sự kiện đó đã xảy ra. Ý tưởng chính là trạng thái có thể thay đổi và một log chỉ nối thêm của các sự kiện bất biến không mâu thuẫn với nhau: chúng là hai mặt của cùng một đồng xu. Log của tất cả các thay đổi, changelog, đại diện cho sự tiến hóa của trạng thái theo thời gian.

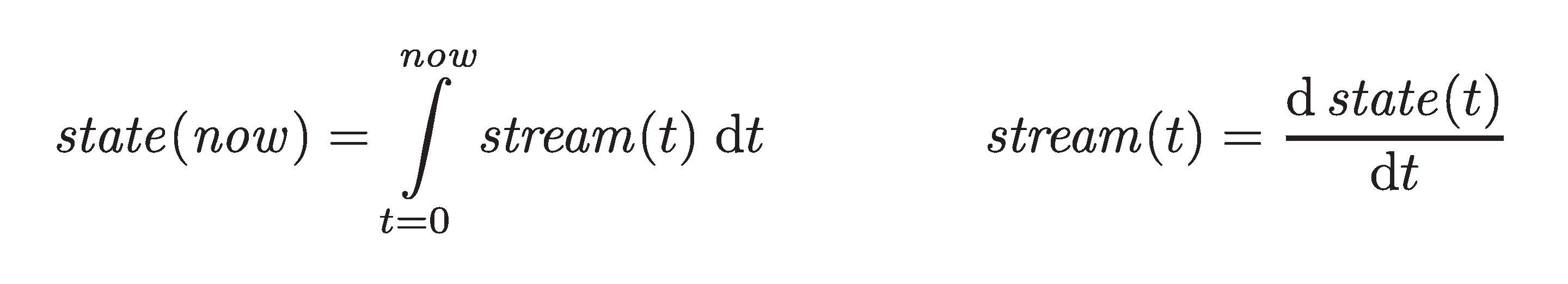

Nếu bạn có khuynh hướng toán học, bạn có thể nói rằng trạng thái ứng dụng là những gì bạn nhận được khi bạn tích phân một event stream theo thời gian, và một change stream là những gì bạn nhận được khi bạn vi phân trạng thái theo thời gian, như được hiển thị trong Hình 12-7 37, 38. Phép tương tự có những hạn chế (ví dụ, đạo hàm bậc hai của trạng thái dường như không có ý nghĩa), nhưng đó là một điểm xuất phát hữu ích để suy nghĩ về dữ liệu.

Nếu bạn lưu trữ changelog một cách bền vững, điều đó đơn giản có tác dụng làm cho trạng thái có thể tái tạo. Nếu bạn coi log sự kiện là system of record của bạn, và bất kỳ trạng thái có thể thay đổi nào đều được dẫn xuất từ nó, thì việc lý luận về luồng dữ liệu qua một hệ thống trở nên dễ dàng hơn. Như Jim Gray và Andreas Reuter đã nói vào năm 1992 39:

here is no fundamental need to keep a database at all; the log contains all the information there is. The only reason for storing the database (i.e., the current end-of-the-log) is performance of retrieval operations.

Log compaction là một cách để thu hẹp sự phân biệt giữa log và trạng thái cơ sở dữ liệu: nó chỉ giữ lại phiên bản mới nhất của mỗi bản ghi, và loại bỏ các phiên bản bị ghi đè.

Lợi thế của các sự kiện bất biến

Tính bất biến trong cơ sở dữ liệu là một ý tưởng cũ. Ví dụ, kế toán đã sử dụng tính bất biến trong nhiều thế kỷ trong việc ghi sổ tài chính. Khi một giao dịch xảy ra, nó được ghi lại trong một sổ cái (ledger) chỉ nối thêm, về cơ bản là một log các sự kiện mô tả tiền, hàng hóa hoặc dịch vụ đã đổi chủ. Các tài khoản, chẳng hạn lãi lỗ hoặc bảng cân đối kế toán, được dẫn xuất từ các giao dịch trong sổ cái bằng cách cộng chúng lại 40.

Nếu một sai lầm được thực hiện, kế toán không xóa hoặc thay đổi giao dịch không chính xác trong sổ cái, thay vào đó, họ thêm một giao dịch khác bù đắp cho sai lầm, ví dụ hoàn tiền một khoản phí không chính xác. Giao dịch không chính xác vẫn còn trong sổ cái mãi mãi, vì nó có thể quan trọng cho mục đích kiểm toán. Nếu các số liệu không chính xác, được dẫn xuất từ sổ cái không chính xác, đã được công bố, thì các số liệu cho kỳ kế toán tiếp theo bao gồm một khoản điều chỉnh. Quá trình này hoàn toàn bình thường trong kế toán 41.

Mặc dù khả năng kiểm toán như vậy đặc biệt quan trọng trong các hệ thống tài chính, nó cũng có lợi cho nhiều hệ thống khác không phải chịu các quy định nghiêm ngặt như vậy. Nếu bạn vô tình triển khai mã lỗi ghi dữ liệu xấu vào cơ sở dữ liệu, việc phục hồi sẽ khó hơn nhiều nếu mã có thể ghi đè phá hủy dữ liệu. Với log chỉ nối thêm của các sự kiện bất biến, việc chẩn đoán những gì đã xảy ra và phục hồi từ vấn đề dễ dàng hơn nhiều. Tương tự, dịch vụ khách hàng có thể sử dụng audit log (log kiểm toán) để chẩn đoán các yêu cầu và khiếu nại của khách hàng.

Các sự kiện bất biến cũng nắm bắt nhiều thông tin hơn so với chỉ trạng thái hiện tại. Ví dụ, trên một trang web mua sắm, một khách hàng có thể thêm một mục vào giỏ hàng và sau đó xóa nó. Mặc dù sự kiện thứ hai hủy bỏ sự kiện đầu tiên từ quan điểm thực hiện đơn hàng, có thể hữu ích để biết cho mục đích phân tích rằng khách hàng đã cân nhắc một mục cụ thể nhưng sau đó quyết định không mua. Có lẽ họ sẽ chọn mua nó trong tương lai, hoặc có lẽ họ đã tìm thấy một thứ thay thế. Thông tin này được ghi lại trong event log, nhưng sẽ bị mất trong cơ sở dữ liệu xóa các mục khi chúng bị xóa khỏi giỏ hàng.

Dẫn xuất nhiều view từ cùng một event log

Hơn nữa, bằng cách tách biệt trạng thái có thể thay đổi khỏi immutable event log, bạn có thể dẫn xuất nhiều biểu diễn khác nhau hướng đến đọc từ cùng một log sự kiện. Điều này hoạt động giống như có nhiều consumer của một luồng (Hình 12-5): ví dụ, cơ sở dữ liệu phân tích Druid nhập trực tiếp từ Kafka bằng cách tiếp cận này, và các Kafka Connect sink có thể xuất dữ liệu từ Kafka sang nhiều cơ sở dữ liệu và chỉ mục khác nhau 33.

Có một bước dịch rõ ràng từ event log sang cơ sở dữ liệu giúp dễ dàng phát triển ứng dụng của bạn theo thời gian: nếu bạn muốn giới thiệu một tính năng mới trình bày dữ liệu hiện có của bạn theo một cách mới, bạn có thể sử dụng event log để xây dựng một view hướng đến đọc riêng biệt được tối ưu hóa cho tính năng mới, và chạy nó cùng với các hệ thống hiện có mà không cần sửa đổi chúng. Chạy các hệ thống cũ và mới song song thường dễ hơn so với thực hiện di cư schema phức tạp trong một hệ thống hiện có. Khi người đọc đã chuyển sang hệ thống mới và hệ thống cũ không còn cần thiết nữa, bạn có thể đơn giản tắt nó và thu hồi tài nguyên của nó 42, 43.

Ý tưởng ghi dữ liệu ở một dạng được tối ưu hóa cho ghi, và sau đó dịch nó sang các biểu diễn khác nhau được tối ưu hóa cho đọc khi cần, là mẫu command query responsibility segregation (CQRS, phân tách trách nhiệm lệnh truy vấn) mà chúng ta đã gặp trong “Event Sourcing and CQRS”. Nó không nhất thiết yêu cầu event sourcing: bạn cũng có thể xây dựng nhiều materialized view từ một luồng CDC event 44.

Cách tiếp cận truyền thống đối với thiết kế cơ sở dữ liệu và schema dựa trên sự ngộ nhận rằng dữ liệu phải được ghi ở cùng dạng như nó sẽ được truy vấn. Các cuộc tranh luận về chuẩn hóa và phi chuẩn hóa (xem “Normalization, Denormalization, and Joins”) trở nên phần lớn không liên quan nếu bạn có thể dịch dữ liệu từ event log được tối ưu hóa cho ghi sang trạng thái ứng dụng được tối ưu hóa cho đọc: hoàn toàn hợp lý để phi chuẩn hóa dữ liệu trong các view được tối ưu hóa cho đọc, vì quá trình dịch cung cấp cho bạn một cơ chế để giữ nó nhất quán với event log.

Trong “Case Study: Social Network Home Timelines” chúng ta đã thảo luận về home timeline của mạng xã hội, một cache của các bài đăng gần đây của những người mà một người dùng cụ thể đang theo dõi (như một hộp thư). Đây là một ví dụ khác về trạng thái được tối ưu hóa cho đọc: home timeline được phi chuẩn hóa cao, vì các bài đăng của bạn được nhân đôi trong tất cả các timeline của những người đang theo dõi bạn. Tuy nhiên, dịch vụ fan-out giữ trạng thái nhân đôi này đồng bộ với các bài đăng mới và những người following relationships, which keeps the duplication manageable.

Kiểm soát đồng thời

Nhược điểm lớn nhất của CQRS là các consumer của event log thường hoạt động bất đồng bộ, nên có khả năng một người dùng thực hiện ghi vào log, sau đó đọc từ derived view (khung nhìn dẫn xuất) và thấy rằng lần ghi đó chưa được phản ánh vào view. Chúng ta đã thảo luận về vấn đề này và các giải pháp tiềm năng trong “Reading Your Own Writes”.

Một giải pháp là thực hiện cập nhật read view đồng bộ với việc nối thêm sự kiện vào log. Điều này đòi hỏi một distributed transaction (giao dịch phân tán) qua event log và derived view, hoặc một cách nào đó để chờ đến khi sự kiện được phản ánh vào view. Cả hai cách tiếp cận thường không khả thi, nên views thường được cập nhật bất đồng bộ.

Mặt khác, việc dẫn xuất trạng thái hiện tại từ event log cũng đơn giản hóa một số khía cạnh của kiểm soát đồng thời. Phần lớn nhu cầu dùng multi-object transaction (giao dịch đa đối tượng, xem “Single-Object and Multi-Object Operations”) xuất phát từ việc một hành động người dùng yêu cầu thay đổi dữ liệu ở nhiều nơi khác nhau. Với event sourcing, bạn có thể thiết kế một sự kiện sao cho nó là mô tả tự đầy đủ về một hành động người dùng. Hành động người dùng sau đó chỉ cần một lần ghi duy nhất tại một chỗ, cụ thể là nối thêm sự kiện vào log, điều này dễ thực hiện nguyên tử.

Nếu event log và application state được phân mảnh theo cùng một cách (ví dụ, xử lý một sự kiện của khách hàng ở shard 3 chỉ yêu cầu cập nhật shard 3 của application state), thì một log consumer đơn luồng đơn giản không cần kiểm soát đồng thời khi ghi, vì theo thiết kế, nó chỉ xử lý một sự kiện tại một thời điểm (xem thêm “Actual Serial Execution”). Log loại bỏ tính không xác định của đồng thời bằng cách xác định thứ tự tuần tự của các sự kiện trong một shard 27. Nếu một sự kiện chạm đến nhiều state shard, cần thêm một chút công sức, điều này chúng ta sẽ thảo luận trong Chương 13.

Nhiều hệ thống không dùng mô hình event-sourced vẫn dựa vào tính bất biến để kiểm soát đồng thời: nhiều cơ sở dữ liệu nội bộ sử dụng cấu trúc dữ liệu bất biến hoặc dữ liệu đa phiên bản để hỗ trợ point-in-time snapshot (ảnh chụp tại thời điểm cụ thể, xem “Indexes and snapshot isolation”). Các hệ thống quản lý phiên bản như Git, Mercurial và Fossil cũng dựa vào dữ liệu bất biến để lưu giữ lịch sử phiên bản của các tệp.

Giới hạn của tính bất biến

Đến mức độ nào thì việc lưu giữ lịch sử bất biến của tất cả các thay đổi mãi mãi là khả thi? Câu trả lời phụ thuộc vào mức độ biến động của tập dữ liệu. Một số workload chủ yếu thêm dữ liệu và hiếm khi cập nhật hoặc xóa; chúng dễ dàng được làm bất biến. Các workload khác có tỷ lệ cập nhật và xóa cao trên một tập dữ liệu tương đối nhỏ; trong những trường hợp này, lịch sử bất biến có thể phát triển quá lớn, phân mảnh có thể trở thành vấn đề, và hiệu năng của compaction (nén) và garbage collection (thu gom rác) trở nên cực kỳ quan trọng cho tính ổn định vận hành 45, 46.

Ngoài lý do hiệu năng, còn có thể có những trường hợp bạn cần xóa dữ liệu vì lý do quản trị hoặc pháp lý, bất chấp tính bất biến. Ví dụ, các quy định về quyền riêng tư như Quy định Bảo vệ Dữ liệu Chung châu Âu (GDPR) yêu cầu thông tin cá nhân của người dùng phải được xóa và thông tin sai lệch phải được loại bỏ theo yêu cầu, hoặc một rò rỉ thông tin nhạy cảm tình cờ có thể cần được kiểm soát.

Trong những trường hợp này, chỉ nối thêm một sự kiện vào log để chỉ ra rằng dữ liệu trước đó nên được coi là đã xóa là chưa đủ, bạn thực sự muốn viết lại lịch sử và giả vờ rằng dữ liệu chưa bao giờ được ghi. Ví dụ, Datomic gọi tính năng này là excision (trích xuất cưỡng bức) 47, và hệ thống quản lý phiên bản Fossil có một khái niệm tương tự gọi là shunning (tẩy chay) 48.

Việc thực sự xóa dữ liệu đáng ngạc nhiên là khó 49, vì các bản sao có thể tồn tại ở nhiều nơi: ví dụ, storage engine, filesystem và SSD thường ghi vào vị trí mới thay vì ghi đè tại chỗ 41, và backup thường được cố ý làm bất biến để ngăn việc xóa hoặc hỏng dữ liệu tình cờ.

Một cách để cho phép xóa dữ liệu bất biến là crypto-shredding (băm nhỏ bằng mã hóa) 50: dữ liệu mà bạn có thể muốn xóa trong tương lai được lưu trữ dưới dạng mã hóa, và khi bạn muốn loại bỏ nó, bạn quên đi khóa mã hóa. Dữ liệu đã mã hóa vẫn còn đó, nhưng không ai có thể sử dụng được. Theo một nghĩa nào đó, cách này chỉ chuyển vấn đề sang chỗ khác: dữ liệu thực sự bây giờ là bất biến, nhưng bộ lưu trữ khóa của bạn thì có thể thay đổi.

Hơn nữa, bạn phải quyết định trước dữ liệu nào sẽ được mã hóa bằng cùng một khóa, và khi nào bạn sẽ dùng khóa khác, đây là một quyết định quan trọng, vì sau này bạn có thể crypto-shred toàn bộ hoặc không dữ liệu nào được mã hóa bằng một khóa cụ thể, nhưng không thể chỉ một phần. Lưu trữ một khóa riêng cho mỗi mục dữ liệu sẽ trở nên quá cồng kềnh, vì bộ lưu trữ khóa sẽ có kích thước bằng với bộ lưu trữ dữ liệu chính. Các phương pháp phức tạp hơn như puncturable encryption (mã hóa có thể thu hồi chọn lọc) 51 cho phép thu hồi chọn lọc khả năng giải mã của một khóa, nhưng chúng không được sử dụng rộng rãi.

Nhìn chung, việc xóa phần lớn là vấn đề của “làm cho việc truy xuất dữ liệu khó hơn” thay vì thực sự “làm cho việc truy xuất dữ liệu là không thể.” Tuy nhiên, đôi khi bạn vẫn phải cố thử, như chúng ta sẽ thấy trong “Legislation and Self-Regulation”.

Xử lý Streams

Cho đến nay trong chương này, chúng ta đã nói về nguồn gốc của stream (sự kiện hoạt động người dùng, cảm biến và ghi vào cơ sở dữ liệu), và chúng ta đã nói về cách stream được truyền tải (qua messaging trực tiếp, qua message broker và trong event log).

Điều còn lại là thảo luận về những gì bạn có thể làm với stream khi đã có nó, cụ thể là bạn có thể xử lý nó. Nhìn chung, có ba lựa chọn:

Bạn có thể lấy dữ liệu trong các sự kiện và ghi vào cơ sở dữ liệu, cache, search index hoặc hệ thống lưu trữ tương tự, từ đó các client khác có thể truy vấn. Như được hiển thị trong Hình 12-5, đây là cách tốt để giữ cơ sở dữ liệu đồng bộ với các thay đổi xảy ra ở các phần khác của hệ thống, đặc biệt nếu stream consumer là client duy nhất ghi vào cơ sở dữ liệu. Ghi vào hệ thống lưu trữ là tương đương streaming của những gì chúng ta đã thảo luận trong “Batch Use Cases”.

Bạn có thể đẩy các sự kiện đến người dùng theo một cách nào đó, ví dụ bằng cách gửi email cảnh báo hoặc push notification, hoặc stream các sự kiện đến một real-time dashboard để chúng được trực quan hóa. Trong trường hợp này, con người là consumer cuối cùng của stream.

Bạn có thể xử lý một hoặc nhiều input stream để tạo ra một hoặc nhiều output stream. Stream có thể đi qua một pipeline bao gồm nhiều giai đoạn xử lý như vậy trước khi cuối cùng kết thúc tại một output (lựa chọn 1 hoặc 2).

Trong phần còn lại của chương này, chúng ta sẽ thảo luận về lựa chọn 3: xử lý stream để tạo ra các stream dẫn xuất khác. Một đoạn mã xử lý stream như vậy được gọi là operator (bộ xử lý) hoặc job (công việc). Nó có liên quan chặt chẽ đến các Unix process và MapReduce job chúng ta đã thảo luận trong Chương 11, và mẫu dataflow tương tự nhau: một stream processor tiêu thụ input stream theo kiểu chỉ đọc và ghi output ra một vị trí khác theo kiểu chỉ nối thêm.

Các mẫu phân mảnh và song song hóa trong stream processor cũng rất giống với những mẫu trong MapReduce và các dataflow engine chúng ta đã thấy trong Chương 11, nên chúng ta sẽ không lặp lại những chủ đề đó ở đây. Các thao tác mapping cơ bản như biến đổi và lọc bản ghi cũng hoạt động tương tự.

Sự khác biệt quan trọng duy nhất so với batch job là stream không bao giờ kết thúc. Sự khác biệt này có nhiều hệ quả: như đã thảo luận ở đầu chương này, sắp xếp không có ý nghĩa với tập dữ liệu không giới hạn, và do đó sort-merge join (xem “JOIN and GROUP BY”) không thể được sử dụng. Các cơ chế fault-tolerance cũng phải thay đổi: với một batch job đã chạy được vài phút, một task thất bại có thể đơn giản được khởi động lại từ đầu, nhưng với một stream job đã chạy nhiều năm, khởi động lại từ đầu sau khi crash có thể không phải là lựa chọn khả thi.

Các Ứng dụng của Stream Processing

Stream processing từ lâu đã được sử dụng cho mục đích giám sát, nơi một tổ chức muốn được cảnh báo nếu một số điều nhất định xảy ra. Ví dụ:

Hệ thống phát hiện gian lận cần xác định xem mẫu sử dụng thẻ tín dụng có thay đổi bất ngờ không, và khóa thẻ nếu có khả năng bị đánh cắp.

Hệ thống giao dịch cần kiểm tra sự thay đổi giá trên thị trường tài chính và thực hiện giao dịch theo các quy tắc được chỉ định.

Hệ thống sản xuất cần giám sát trạng thái máy móc trong nhà máy, và nhanh chóng xác định vấn đề nếu có sự cố.

Hệ thống quân sự và tình báo cần theo dõi các hoạt động của đối thủ tiềm năng, và phát cảnh báo nếu có dấu hiệu tấn công.

Các loại ứng dụng này đòi hỏi pattern matching (khớp mẫu) và tương quan khá phức tạp. Tuy nhiên, theo thời gian cũng đã xuất hiện các ứng dụng khác của stream processing. Trong phần này, chúng ta sẽ so sánh ngắn gọn một số ứng dụng này.

Complex event processing

Complex event processing (CEP, xử lý sự kiện phức tạp) là một phương pháp được phát triển vào những năm 1990 để phân tích event stream, đặc biệt hướng đến loại ứng dụng yêu cầu tìm kiếm các mẫu sự kiện nhất định 52. Tương tự như cách biểu thức chính quy cho phép bạn tìm kiếm các mẫu ký tự nhất định trong chuỗi, CEP cho phép bạn chỉ định các quy tắc để tìm kiếm các mẫu sự kiện nhất định trong stream.

Các hệ thống CEP thường sử dụng ngôn ngữ truy vấn khai báo cấp cao như SQL, hoặc giao diện người dùng đồ họa, để mô tả các mẫu sự kiện cần được phát hiện. Các truy vấn này được gửi đến một processing engine tiêu thụ input stream và nội bộ duy trì một state machine thực hiện việc khớp yêu cầu. Khi tìm thấy khớp, engine phát ra một complex event (sự kiện phức tạp, do đó có tên gọi) với chi tiết về mẫu sự kiện được phát hiện 53.

Trong các hệ thống này, mối quan hệ giữa truy vấn và dữ liệu được đảo ngược so với cơ sở dữ liệu thông thường. Thông thường, cơ sở dữ liệu lưu trữ dữ liệu lâu dài và xử lý truy vấn như là tạm thời: khi một truy vấn đến, cơ sở dữ liệu tìm kiếm dữ liệu phù hợp với truy vấn, rồi quên đi truy vấn khi hoàn thành. CEP engine đảo ngược các vai trò này: các truy vấn được lưu trữ lâu dài; khi mỗi sự kiện đến, engine kiểm tra xem nó có thấy một mẫu sự kiện khớp với bất kỳ truy vấn thường trực nào của nó không 54.

Các triển khai CEP bao gồm Esper, Apama và TIBCO StreamBase. Các distributed stream processor như Flink và Spark Streaming cũng có hỗ trợ SQL cho các truy vấn khai báo trên stream.

Stream analytics

Một lĩnh vực khác mà stream processing được sử dụng là analytics trên stream. Ranh giới giữa CEP và stream analytics khá mờ nhạt, nhưng theo quy tắc chung, analytics thường ít quan tâm đến việc tìm các chuỗi sự kiện cụ thể và hướng nhiều hơn đến các tổng hợp và chỉ số thống kê trên một số lượng lớn sự kiện, ví dụ:

Đo tần suất của một loại sự kiện (tần suất xảy ra trên mỗi khoảng thời gian)

Tính trung bình động của một giá trị trong một khoảng thời gian

So sánh thống kê hiện tại với các khoảng thời gian trước đó (ví dụ, để phát hiện xu hướng hoặc cảnh báo về các chỉ số cao hoặc thấp bất thường so với cùng thời điểm tuần trước)

Các thống kê như vậy thường được tính trên các khoảng thời gian cố định, ví dụ bạn có thể muốn biết số lượng truy vấn trung bình mỗi giây đến một dịch vụ trong 5 phút vừa qua, và thời gian phản hồi ở phân vị thứ 99 trong khoảng thời gian đó. Lấy trung bình trong vài phút làm mịn các biến động không liên quan từ giây này sang giây khác, trong khi vẫn cho bạn bức tranh kịp thời về bất kỳ thay đổi nào trong mẫu lưu lượng. Khoảng thời gian mà bạn tổng hợp được gọi là window (cửa sổ thời gian), và chúng ta sẽ xem xét windowing chi tiết hơn trong “Reasoning About Time”.

Các hệ thống stream analytics đôi khi sử dụng thuật toán xác suất, chẳng hạn như Bloom filter (mà chúng ta đã gặp trong “Bloom filters”) để kiểm tra thành viên tập hợp, HyperLogLog 55 để ước tính cardinality (lực lượng tập hợp), và các thuật toán ước tính phân vị khác nhau (xem “Computing Percentiles”). Các thuật toán xác suất tạo ra kết quả gần đúng, nhưng có ưu điểm là yêu cầu bộ nhớ ít hơn đáng kể trong stream processor so với các thuật toán chính xác. Việc sử dụng thuật toán gần đúng này đôi khi khiến người ta tin rằng các hệ thống stream processing luôn có mất mát và không chính xác, nhưng điều đó là sai: không có gì vốn là gần đúng về stream processing, và việc sử dụng thuật toán xác suất chỉ đơn giản là một tối ưu hóa 56.

Nhiều framework stream processing phân tán mã nguồn mở được thiết kế với analytics trong đầu: ví dụ, Apache Storm, Spark Streaming, Flink, Samza, Apache Beam và Kafka Streams 57. Các dịch vụ được lưu trữ bao gồm Google Cloud Dataflow và Azure Stream Analytics.

Duy trì materialized view

Chúng ta đã thấy rằng một stream các thay đổi đến cơ sở dữ liệu có thể được sử dụng để giữ các hệ thống dữ liệu dẫn xuất, chẳng hạn như cache, search index và data warehouse, đồng bộ với cơ sở dữ liệu nguồn. Đây là các ví dụ về duy trì materialized view (khung nhìn vật chất hóa): dẫn xuất một khung nhìn thay thế trên một số tập dữ liệu để bạn có thể truy vấn hiệu quả, và cập nhật khung nhìn đó bất cứ khi nào dữ liệu cơ bản thay đổi 37.

Tương tự, trong event sourcing, trạng thái ứng dụng được duy trì bằng cách áp dụng một log các sự kiện; ở đây trạng thái ứng dụng cũng là một loại materialized view. Không giống như các kịch bản stream analytics, thường không đủ để chỉ xem xét các sự kiện trong một khoảng thời gian nhất định: việc xây dựng materialized view có thể yêu cầu tất cả các sự kiện trong một khoảng thời gian tùy ý, ngoại trừ bất kỳ sự kiện lỗi thời nào có thể bị loại bỏ bởi log compaction. Thực tế, bạn cần một window kéo dài tất cả về phía trước đến lúc ban đầu.

Về nguyên tắc, bất kỳ stream processor nào cũng có thể được sử dụng để duy trì materialized view, mặc dù nhu cầu lưu giữ sự kiện mãi mãi đi ngược lại các giả định của một số framework hướng analytics chủ yếu hoạt động trên các window có thời gian giới hạn. Kafka Streams và ksqlDB của Confluent hỗ trợ loại sử dụng này, dựa trên hỗ trợ log compaction của Kafka 58.

INCREMENTAL VIEW MAINTENANCE

Databases might seem well suited for materialized view maintenance; they are designed to keep full copies of a dataset, after all. Many also support materialized views. We saw in “Materialized Views and Data Cubes” that analytical queries typical of a data warehouse can be materialized into OLAP cubes.

Unfortunately, databases often refresh materialized view tables using batch jobs or on-demand

requests such as PostgreSQL’s REFRESH MATERIALIZED VIEW. Views are recalculated

periodically rather than as updates to souce data occurs. This approach has two significant

drawbacks that make it inappropriate for stream processing view maintenance:

Poor efficiency: All data is reprocessed every time the view is updated, though it’s likely that most of the data remains unchanged.

Data freshness: changes in source data are not reflected in a materialized view until its query is re-run during its next scheduled update.

It is possible to write database triggers that update materialized views efficiently in scenarios where the data is easily partitioned and the computation is naturally incremental. For example, if a materialized view maintains total sales revenue per-day, the row for the appropriate day can be updated every time a new sale occurs. Bespoke solutions work in a few cases, but many SQL queries can’t be easily or efficiently converted to incremental computation.

Incremental view maintenance (IVM) is a more general solution to the problems listed above. IVM techniques convert relational grammars such as SQL into operators capable of incremental computations. Rather than processing entire datasets, IVM algorithms recompute and update only data that has changed 38, 59, 60. View computation becomes far more efficient. Updates can then be run much more frequently, which dramatically increases data freshness.

Databases such as Materialize 61, RisingWave, ClickHouse, and Feldera all use IVM techniques to provide efficient incremental materialized views. These databases ingest streams of events to expose materialized views in realtime. Recent events are buffered in-memory and periodically used to update on-disk materialized views. Reads combine the recent events and the materialized data to provide a single realtime view. Since reads are often expressed in SQL and materialized views are often stored in OLAP-style formats, these systems also support large-scale data warehouse-style queries such as those disucssed in Chapter 11.

Tìm kiếm trên stream

Ngoài CEP, cho phép tìm kiếm các mẫu bao gồm nhiều sự kiện, đôi khi còn có nhu cầu tìm kiếm các sự kiện riêng lẻ dựa trên các tiêu chí phức tạp, chẳng hạn như các truy vấn tìm kiếm toàn văn.

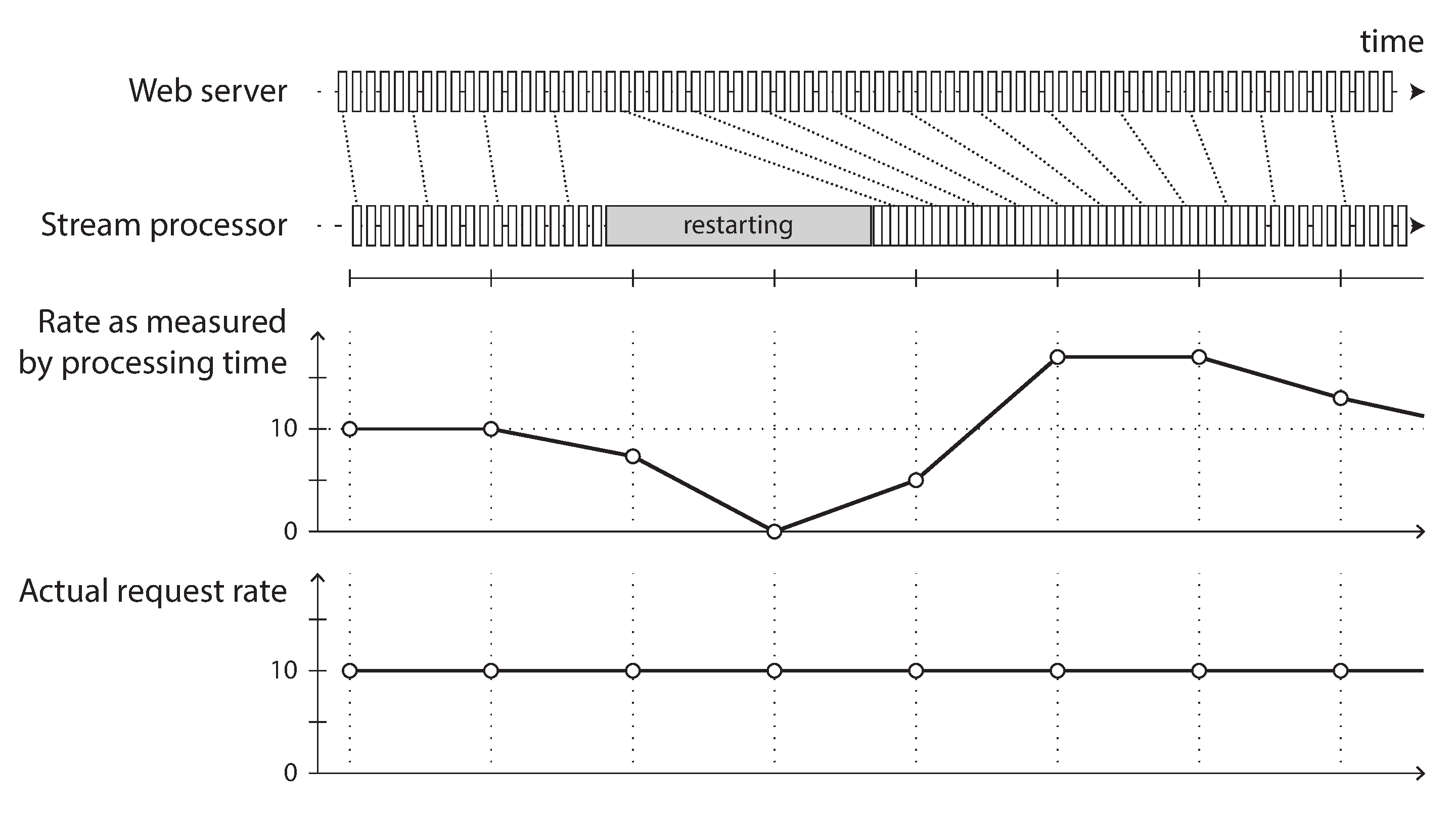

Ví dụ, các dịch vụ giám sát truyền thông đăng ký các nguồn cấp tin tức và chương trình phát sóng từ các cơ quan truyền thông, và tìm kiếm bất kỳ tin tức nào đề cập đến các công ty, sản phẩm hoặc chủ đề quan tâm. Điều này được thực hiện bằng cách xây dựng một truy vấn tìm kiếm trước, sau đó liên tục khớp stream tin tức với truy vấn này. Các tính năng tương tự tồn tại trên một số trang web: ví dụ, người dùng các trang web bất động sản có thể yêu cầu được thông báo khi một bất động sản mới khớp với tiêu chí tìm kiếm của họ xuất hiện trên thị trường. Tính năng percolator của Elasticsearch 62 là một lựa chọn để triển khai loại tìm kiếm stream này.